【よくあるSEO都市伝説】ドメイン名の登録期間が長いほど上位表示に有利

- 今週のピックアップ

- 日本語で読めるSEO/SEM情報

- 海外SEO情報ブログの掲載記事から

- 海外のSEO/SEM情報を日本語で

- SEO Japanからのピックアップはなし

海外のSEO/SEM情報を日本語でピックアップ

【よくあるSEO都市伝説】ドメイン名の登録期間が長いほど上位表示に有利

別のことにSEOの時間を費やそう (John Mueller on Twitter)

ドメイン名の登録期間はランキング要因である。

ドメイン名が古ければ古いほど検索エンジンの評価は高い。

こんなSEO都市伝説を聞いたことがあるだろうか?

グーグルが取得している特許には、そのように読み取れる部分がある。しかしドメイン名登録期間はランキング要因には使っていないと、あるグーグル社員は過去に明言したことがある。

グーグルのジョン・ミューラー氏は、次のようにも言っている。

私が知る限りでは、ほとんどのドメイン名登録事業者は、ドメイン名の登録期間を提供していない。そういったことに、SEOの時間を費やすべきではない。

@bill_slawski AFAIK most registrars don't provide registration length anyway. That's not what you want to spend your "SEO time" on.

— John Mueller (@JohnMu) 2016年11月3日

「長期契約はグーグル検索に有利です」と契約更新を勧めてくるドメイン名登録事業者の誘いがもしあったとしても、くれぐれも引っかからないようにしてほしい。

- 一応、全員が知っておく

グーグルの検索順位決定200以上の要因!(でもそれ本物? 意味あるの?)

グーグル社員が褒め殺し (John Mueller on Twitter)

グーグルは200以上もの検索アルゴリズムを利用していると言われる。これらのアルゴリズムについて、WebmasterWorldフォーラムでディスカッションが発生していた。

これを見たグーグルのジョン・ミューラー氏は、次のようにツイートした。

グーグル検索における200以上のランキング要因についての興味深いディスカッションだ。

Interesting discussion about Google's ">200 factors" in search (h/t threadwatch): https://t.co/deQjWpAHQb

— John Mueller (@JohnMu) 2016年11月2日

これは文字どおり「興味深い」とポジティブな意味で投稿したコメントではないだろう。「200以上のランキング要因」を論じる人たちを皮肉っているのだと思われる。

その証拠に、著名なSEOコンサルタントであるビル・スロースキ氏による次のようなツイートにミューラー氏は「いいね」している。

私が今までに見てきた「200のランキング要因」系リストのほとんどは、適当に引用されたり、よく考えもせずに選ばれたりしたものばかりだ。リンクを集めるためだけに作られたゴミのようなものだ。

@JohnMu most lists of 200 Ranking Factors I've seen are poorly cited and recklessly chosen, created as link bait, and are complete rubbish.

— Bill Slawski (@bill_slawski) 2016年11月2日

好奇心を満たす目的で、ランキング要因をまとめあげることには別段問題はないだろう。しかし、ビジネス(=サイト運営)の一環としてランキング要因をリスト化しても、何かの役に立つとは思えない。

またウェブ担当者のあなたが、「グーグルの200のランキング要因」的なコンテンツに出会っても、それを仕事に活かそうとは思わないほうがいい。好奇心を満たしたり、純粋に楽しんだりする“読み物”としてとらえるのが適切だろう。

- 必見とまではいかないが、すべてのWeb担当者に知っておいてほしい

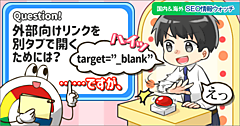

重複コンテンツの防止にrobots.txtは適さない

Googlebotにクロールさせて処理してもらう (John Mueller on Twitter)

重複コンテンツの防止策に関して、グーグルのジョン・ミューラー氏が次のようにツイートした。

重複コンテンツの処理にrobots.txtを使うなら、それはかなり慎重に行うべきだ。

「クロールを減らすこと」は、必ずしもサイトにとって良いことだとは限らない。

@danny_taywitter I'd be careful with handling duplicate content via robots.txt -- less crawling isn't always better for the site.

— John Mueller (@JohnMu) 2016年11月4日

重複コンテンツの発生を防ぐ手段としてグーグルはrobots.txtの利用を勧めていない。ヘルプ記事ではこのように説明している(読みやすいように編集部で改行や読点を追加)。

Google は、ウェブサイト上の重複コンテンツに対するクローラ アクセスを禁止することは、robots.txt ファイルかその他の手段かにかかわらず、おすすめしていません。

重複コンテンツを含むページをクロールできないと、検索エンジンではそれらの URL が同じコンテンツを指していることを自動検出できないため、このような URL を独立した個別のページとして効率的に処理する必要があります。

それよりも、重複コンテンツの URL について、検索エンジンによるクロールを許可する一方で、rel="canonical" リンク要素、URL パラメータ処理ツール、または 301 リダイレクトを使用して重複としてマークする方が適切です。

グーグルは重複コンテンツのURLもクロールしたうえで、重複コンテンツを適切に処理したいのだ。

もしグーグルに任せるのではなく、自分で重複コンテンツを防止するのならば、原則として次に示す仕組みを利用するべきだ。

- 301リダイレクト

rel="canonical"- Search Consoleの「URLパラメータ」機能

また、そもそも余分なURLを発生させないURL構成も重要だ。

- 技術がわかる人に伝えましょう

絶対にハマってはいけない、悪いSEOのサイクルとは?

アルゴリズムの抜け穴をふさがれてグーグルに逆ギレ (Steve Hammer on Twitter)

筆者のツイッターのストリームに回ってきたツイートを紹介する。

悪いSEOのサイクルとは:

- (グーグルの)抜け穴を見つける

- 抜け穴を利用して(順位を上げ)利益を得る

- グーグルが抜け穴を修正する

- 「グーグルが収益源を奪った」と文句を言う

この繰り返し

Cycle of bad SEO:

— Steve Hammer (@armondhammer) 2016年11月3日

Find Exploit, Profit on Exploit, Google fixes exploit, complain that Google is taking away $$

Repeat.

同調した人が多いのだろう。いいね・RTを多く獲得している。

上位表示して成果を上げるときには不正あるいは裏技的な手段を使うくせに、グーグルがアルゴリズム更新して順位が下がると不満を口にする――そんなサイト管理者は、たしかにいそうだ。

わかってグーグルの裏をかこうとするのもどうかと思うし、逆に自分が何をやっているかわからずにSEO施策を行うというのも、おかしな話だ。

このコラムの読者は、たちの悪いSEOのサイクルにはまって逆ギレするようなことがないように、くれぐれも注意してほしい。

- すべてのWeb担当者 必見?

SEO Japanの

SEO Japanの

掲載記事からピックアップ

今週は、残念ながらピックアップ対象の更新なし。