SEO施策はAIにも有効? サーバーログが示すAIクローラーの挙動と、疑問に答えるAI×SEO一問一答

AI時代のSEOは不要か不可欠か。サーバーログで判明したAIクローラーの挙動と、施策の有効性について「AI×SEO」という観点で一問一答形式の解説をした。

4月23日 7:05

「結局、AIが出てきたらSEOは意味がなくなるのでは?」――と疑問を抱いている人もいるだろう。しかし、AI時代だからこそSEOの重要性は高まっていると「デジタルマーケターズサミット 2026 Winter」に登壇した、アユダンテの江沢氏は解く。

本記事では、「なぜAI時代にSEOの重要性が高まっているのか」の理由を、サーバーログが示すAIクローラーの挙動から深掘りしていく。なお本記事は、同イベントで開催された講演を前編・後編分けてお届けしている。前編は、高橋氏によるAI時代の検索ジャーニーの重要性やコンテンツの改善方法を紹介している。

AIにも効くテクニカルSEOとは

AIにも関係するテクニカルSEOについて、江沢氏が解説した。AI時代であっても、やるべきことは非常にシンプルで、検索エンジンとAIに情報を取得して理解してもらうことだという。具体的には「クロール最適化」と「レンダリングチェック」の2つだ。

クロール最適化

クロールとは、クローラーと呼ばれるbotがページを巡回して情報を取得することだ。改めて、Googleのクロールから検索結果に表示されるまでの流れをおさらいすると、まずURLが検出され、クロールされてレンダリングされてインデックスに登録されることで、検索結果に表示されるようになる。これら一連の行動を行うのが、「Googlebot」というクローラーだ。

AI OverviewsやAI モードもGoogle検索と共通のインデックスを使用している。他方、ChatGPTなどの生成AIにも「事前学習を行うためのクローラー」と、RAGが走ったときに外部参照先(たとえばGoogle)から返ってきたサイトを「その場でクロールするリアルタイムクローラー」の2つがある。

つまりSEOとAI観点で重要な主要クローラーはGooglebot、ChatGPTの事前学習用クローラー、ChatGPTのリアルタイムクローラーの3つになる。

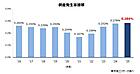

これらのクロールの動きを知るには、サーバーの生ログを分析するしかない。アユダンテでは自社サイトのサーバーの生ログを分析し、Looker Studioでダッシュボードを作成、どんなクローラーがいつ、どのページに来て、どんなファイルにアクセスしているのかをチェックしたという。このダッシュボードではさまざまなクローラーの動きが分析できるが、本講演では最重要のChatGPTの2つのクローラーについて解説した。

ChatGPT 事前学習用クローラー(GPTBot)

物事を理解するためのトレーニング用のクローラーでクローラーの名前(ユーザーエージェント)はGPTBotという。あらゆる情報をまんべんなくクロールしている一方で、クロール頻度は少なく、ほとんど来ないが特定日に大量クロールするといった傾向がある。また、トップページなどサイトの上位階層にあたる部分をクロールしており、コラムよりも会社情報やスタッフプロフィールなどをクロールしていたという。

ChatGPT リアルタイムクローラー(ChatGPT-User)

RAGが走って外部参照したときに返ってきたサイトをリアルタイムでクロールするものでクローラーの名前(ユーザーエージェント)はChatGPT-Userという。このクローラーが来ているページは今まさにChatGPTで引用されている可能性が高いということになる。

リアルタイムクローラーは、AIのニーズやよく引用されているページの傾向がわかるため、非常に有益ではないか(江沢氏)

アユダンテのサイトでも毎日500~600くらいのアクセスがあり、サイトの流入と同傾向の土日や年末年始が少ないという。また事前学習クローラーとは異なり、コラムへのクロールが多く、新旧にかかわらずクロールされているという。

ここで、クロールに関するよくある疑問を一問一答形式で挙げて解説していった。

Q. sitemap.xmlは、効果があるのか?

SEOではお馴染み、クローラー向けのURLリストを作成し、ルートディレクトリ(最上位階層)にアップロードしておくとクロール促進効果があると言われている。

- AIへの効果→「×」

- SEOへの効果→「△」

AIへの効果を「×」とした理由は、生ログを見るとChatGPTをはじめとする主要なAIクローラーはほぼsitemap.xmlファイルを見に来ておらず、ClaudeBotのみ、Googlebotと同レベルで参照があったという。AI関連の公式情報でもsitemap.xmlを参照しているという情報はない。つまり、AIのクローラーに対しては、内部リンクの整備や外部サイトへの露出などをしないと、クロール促進は進まないだろうと江沢氏。

一方、SEOでも「△」とした理由は、sitemap.xmlは万能ではなく、あくまで補助的な役割だからだ。あるサイトのsitemap.xmlでは、10万URLが記載されているものの、Google Search Consoleのインデックスレポートで確認すると、検出インデックス未登録URLが1万7000以上あった。昨今では、sitemap.xmlは、URLの発見にはつながるが、内部リンクがない、階層が深い、質が低いなどの理由からクロールされないことも多いという。sitemap.xmlは必ず自動更新にし、古いURLや404は掲載せず、更新日とURLを正確にするといったことを担保する必要がある。

Q. 新しいコラムはすぐにインデックスされるのか?

- AIでは→「〇」

- SEOでは→「〇」

記事公開後、数時間でGooglebotのみならず、AIのクローラーにもクロールされていた。素早くクロールされる理由として、事前学習クローラーは頻繁にトップページにアクセスしている。アユダンテではトップページに「新着コラム」という枠があるため、リンクの検出促進につながっているのではないか、と江沢氏。

Q. クロール制御はrobots.txtでできるの?

robots.txtとは、クローラーに「クロールさせない」という指示を出せるファイルを指す。

- AIでは→「〇」

- SEOでは→「〇」

AIクローラーのブロック実験をしたところ、主要なAIクローラーはrobots.txtが記載されている間、クロールがほぼストップし、ChatGPTやGeminiといった生成AIの回答でも引用されなかったという。

SEOでもrobots.txtでクロール制御は可能だが、一部誤った使い方をしている場合もあるという。noindex、canonical、robots.txtの使い分けだ。

- noindex:クロール制御は「×」、インデックスの制御は「〇」

→質の低いページや検索結果に出したくない場合には有効 - canonical:クロール制御は「△」、インデックス制御は「〇」

→重複している商品ページやトラッキングURLなどの場合は有効 - robots.txt:クロール制御は「〇」、インデックス制御は「×」

→特に大規模サイトではrobots.txtを使わないとクロール制御に効果がない

また、robots.txtの内容は、ドメインの後に/robots.txtと打てば誰でも確認ができる。AIにコンテンツを渡すかは企業判断ではあるが、意図せずブロックされていないかチェックしてみることも有用だ。

Q. リダイレクトは有効か?

- AIでは→「△」

- SEOでは→「〇」

古いURLから新しいURLに転送する処理をリダイレクトというが、Googlebotは、リダイレクトされたら新しいURLをインデックスして情報取得する。一方、AIのクローラーはリダイレクト自体は追うが、インデックスという概念がない。そのため、リダイレクトをやめてしまうと新しいURLへ辿れなくなるので永久的なリダイレクトが推奨される。さらにJavaScriptリダイレクトではAIが認識できないため、サーバーサイドリダイレクトが望ましい。

Q. 画像内のテキストは理解されるのか?

- AIでは→「△」

- SEOでは→「△」

OCR技術を使ってAIが個別画像のテキストを抜き出すといったことは可能だが、ページ内の画像解析は弱い。重要な内容は本文にテキストで記載するのがAIとSEOの両方で最も有効であり、画像のalt属性を入れることも大切。アユダンテのあるページ内画像にalt属性を追加する実験をしたところ、ChatGPTの生成結果で引用されるようになったらしい。

レンダリングチェック

クロールの話題からレンダリングへと移っていく。レンダリングとは、JavaScriptを実行して、ページの見た目や中身を完成させる処理のことだ。モーダル、ハンバーガーメニュー、アコーディオン、無限スクロールなどはすべてJavaScriptで実装されている。見た目ではわからない点が厄介だ。レンダリングされていない場合、該当箇所は「空」として扱われ、低品質なページと評価される可能性がある。

Q. JavaScriptはレンダリングしてくれる?

- AIでは→「×」

- SEOでは→「△」

AIがレンダリングする箇所は前述した「事前学習」と「リアルタイム」のクロールの2か所になる。事前学習クローラーはJavaScriptをレンダリングせず、リアルタイムクローラーもかなり解析能力が弱い。とにかくAIのクローラーはGooglebotほどレンダリングしないため、JavaScriptが無効でも重要情報を読めるようにしておくことが大切だ。SPA(Single Page Application)方式で作られたサイトは、AIが中身の情報を取得できないので、注意が必要。

一方、Googlebotもたとえば、クリック・スクロール後に出力するといったユーザーアクションを伴うものや、リンクがaタグではなくJavaScriptで記載されているものなど一部のJavaScriptはレンダリングできない。JavaScriptの影響はサイトリニューアルによって起こることが多いので、必ず確認しておきたい。

最後に江沢氏は、AI時代における生ログ分析の有用性について、次のように説いた。

流入に関してはGA4などで計測ができるが、生成AIの回答結果をユーザーがクリックしたときのみ。言い換えれば、クリックしなければ計測ができない。また、メンションや引用は第三者ツールのAhrefs(エイチレフス)やDemandSphere(ディマンドスフィア)などで計測はできるが、あくまでも推定値であり、ツールの利用には費用がかかる。

一方、生ログ分析はAIクローラーの正確な動きがわかるので、次の打ち手も見えやすくなる。

自社サイトに対するAIの影響を可視化したいというマーケターのニーズは高いが、生ログの分析環境を整えるのは、容易ではない。「そんなときはChatGPTのリアルタイムクローラーである『ChatGPT-Userというユーザーエージェントがアクセスしている上位URLのリストを出してほしい』とIT部門にリクエストするところから始めてみては」と江沢氏はアドバイスを送り、セッションを終えた。