「ChatGPT」で何が変わる? ELYZAが語る対話AIの歴史と活用法

2023年3月16日にAIスタートアップ・ELYZAが開催した「LLM(大規模言語モデル)の現状・課題・展望に関する勉強会」のレポートをお届けする。

2023年4月5日 7:00

テクノロジーの進化が目覚ましい昨今、AIは身近な存在になりつつある。2022年の春頃から画像生成AIが大きな話題となったのも記憶に新しいだろう。次のトレンドとして、近ごろ国内外で注目を集めているのが、対話AI「ChatGPT」だ。

国内の大規模言語モデルプレイヤーであり、AIを社会実装しビジネスパーソンの業務効率化、DX化を目指すAIスタートアップ「ELYZA」は、2023年3月16日に「LLM(大規模言語モデル)の現状・課題・展望に関する勉強会」を開催。同社代表取締役CEOの曽根岡侑也氏が、昨今のAIに何が起きているのか、「ChatGPT」周りで話されている通説とその検証、ELYZAの今後の展望について語った。

「Chat GTP」登場後、各社が大規模言語モデルを自社サービスに組み込み始めている

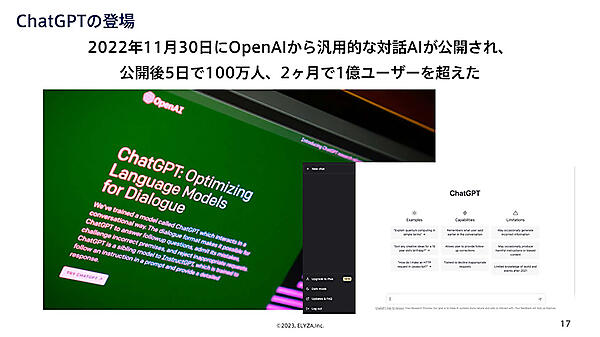

セッションは、AIの現状に関する解説からスタートした。勉強会のきっかけとなった「ChatGPT」は、2022年11月30日にOpenAIから公開された汎用的な対話AIで、高精度で使いやすいUIも影響したのか、公開後5日間で100万人が使用し、2ヶ月で1億ユーザーを超えるなど、大きな注目を集めている。

「ChatGPT」の注目を受けて、2019年からOpenAIに10億ドルの出資をしていたMicrosoftは、追加で数十億ドルの出資を行い「Azure」「Bing」といったOfficeソフトへの組み込みを進めている。こういった動きはMicrosoftにとどまらず、Googleも独自の大規模言語モデル「PaLM API」の提供を進め、今後もチューニングを行いつつGmail、Google ドキュメントなどに組み込み、実装を進めていく意向を示している。その他にも、AmazonやMetaも、大規模言語モデルを自社サービスに実装する動きを進めるなど「ChatGPT」をはじめとし、対話AIはIT業界に大きな影響を与えていると言っても過言ではない。

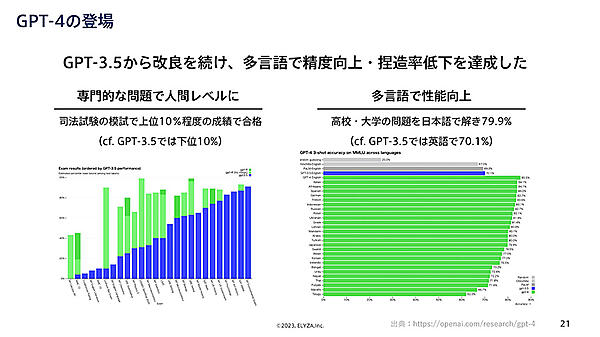

なお、「ChatGPT」は現在も進化しており、従来の「GPT-3.5」から改良を続け、多言語で精度向上、捏造率を低下させた「GPT-4」が3月14日に新しく発表された。

『GPT-4』の精度は、たとえば司法試験の模試を解かせたところ、上位10%程度の結果を出します。『GPT-3.5』では下位10%だったため、驚くべき数値です。

他にも、今まで『ChatGPT』は日本語と英語だと、後者のほうが精度が高いという通説がありましたが、『GPT-4』は高校・大学の問題を解くタスクで日本語でも79.9%の精度まできており、英語と比べても大きく遜色のない状態まできていると言って良いでしょう。多言語でも性能が上がっているのが大きな変化点です(曽根岡氏)

さらに、「GPT-4」はマルチモーダル技術によって、テキストだけでなく画像を入力として処理できるようになったのも大きな変化のひとつだ。つまり、AIが画像の情報を読み取り、テキストで説明を返してくれるのだ。

曽根岡氏は「AIを作るには一定のスキルが必要だったが、今後はAIエンジニアでなくとも、好みのAIを作ることができるようになるだろう」と話す。

「GPT-4」登場まで4年かかっていた? これまでの大規模言語モデルの歩み

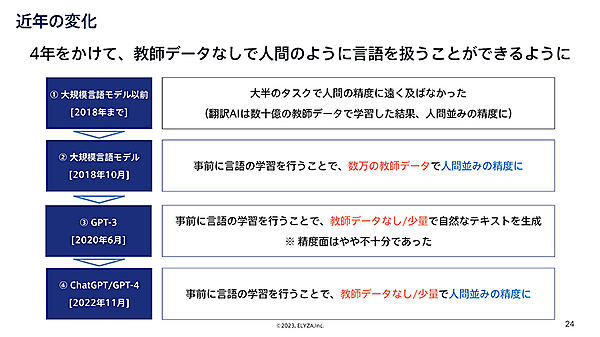

「ChatGPT」はここ数ヶ月で大きな話題となっているが、実は昨日今日という短いスパンで生まれたものではない。人間のように言語を扱うまでには、4年以上もの月日が費やされている。

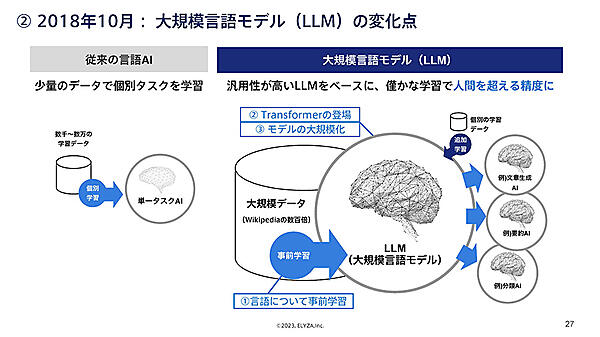

そもそも、大規模言語モデルが登場する2018年以前は、「AIに言語を扱わせるのは厳しいだろう」と言われていた。それは、従来の言語AIは少量のデータで個別タスクを学習させており、「知らない言語の大学入試問題をいきなり渡される」ような状態だったからだ。しかし、2018年10月大規模言語モデル(LLM)が登場した結果、数万件の教師データを集めて言語について事前学習させて、汎用性が高いLLMをベースにすれば、わずかな学習で言語AIは人間並みの精度に到達することがわかった。

この大規模言語モデル(LLM)の登場によって、AIの精度は急激に向上し、2020年には「GPT-3」が登場。教師データがない状態、もしくは少量だけで自然なテキストを生成できるようになったが、精度面はやや不十分だった。その後も改善を続けた結果、教師データがなくても、少量でも高精度で言語を扱えるAI「GPT-4」が誕生したのだという。

AI技術そのものではなくIT業界に目を向けると、最近では大企業の独占を危惧してオープンソース化の動きが出てきているのもおもしろいところだ。たとえば、「Facebook」を擁するMetaは、大規模言語モデルを一般公開している。曽根岡氏によると、言語モデルの大規模化競争が始まる中で、2021年頃からモデル自体の改良合戦も起きていたという。

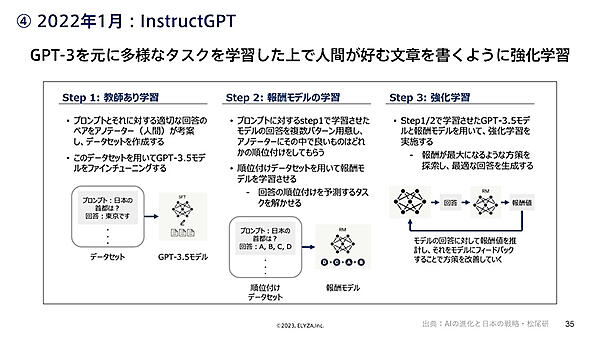

改良合戦の中でキーになったのが『Instruct GPT』です。『GPT-3』を元に多様なタスクを学習して人間が好む文章を書くように強化学習をさせるというもので、出力として望む結果を人の手で作って学習させ、AIから出力された文章にフィードバックをしてサイクルを回すことで精度を上げたのです(曽根岡氏)

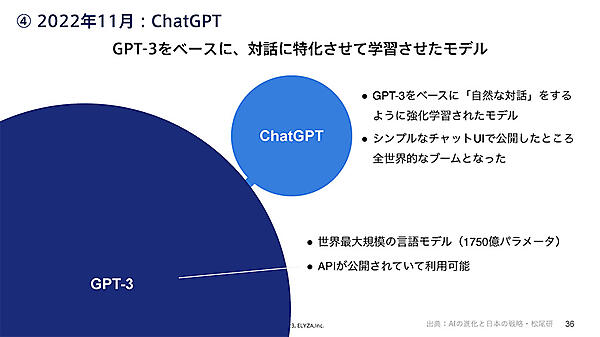

その結果生まれたのが「ChatGPT」だ。自然な対話をするように強化学習され、シンプルなチャットUIで公開したモデルは、全世界的にブームを巻き起こした。そして2023年3月に多言語で精度向上を達成した「GPT-4」が発表されることとなる。このように、対話AIは一朝一夕で生まれたものではなく、年月を重ねて進化を遂げていったものなのだ。

大規模言語モデル活用に関する通説と実態 ~人の仕事はなくなる?~

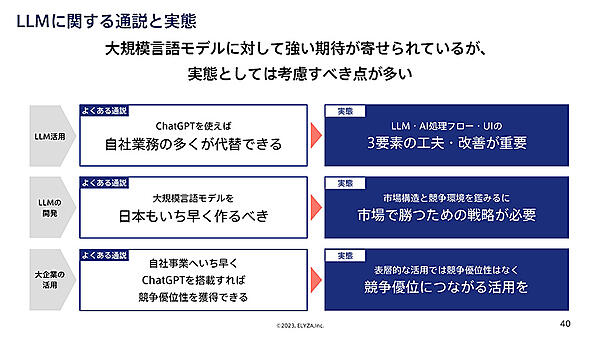

イベント中盤では「ChatGPT」周りの通説がどこまで正しいのか、ELYZA独自の視点で語られた。紹介する通説は以下の3つだ。

- ChatGPTを使えば自社業務の多くが代替できる

- 大規模言語モデルを日本もいち早く作るべき

- 自社事業へいち早くChatGPTを搭載すれば競争優位性を確保できる

通説①ChatGPTを使えば自社業務の多くが代替できる

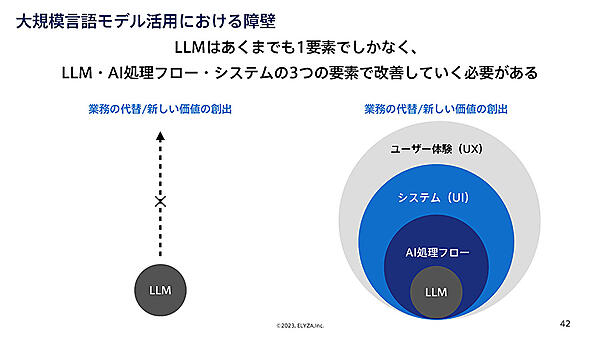

それぞれについて、ELYZAによる見解を紹介しよう。まず1つ目に「ChatGPTを使えば自社業務の多くが代替できる」という通説だ。これに対し曽根岡氏は「ただ導入すればいいだけではなく、周辺領域の設計が必要なため、大規模言語モデル・AI処理フロー・UIの3要素の工夫と改善が重要だ」と話す。

前提として、通説と我々が見えている世界で乖離している点がいくつかあると思っています。そのため、一つの意見として捉えていただきたいのですが、ただ闇雲に導入するだけでは望む結果は生まれにくいでしょう。

- どのようにAIを業務に連携させるか

- 社内ルールや慣例にどう適合させるか

- 現場のUIシステムにどう合致させるか

以上の点を整えて初めて業務の代替や新しい価値の創出ができるようになると考えます(曽根岡氏)

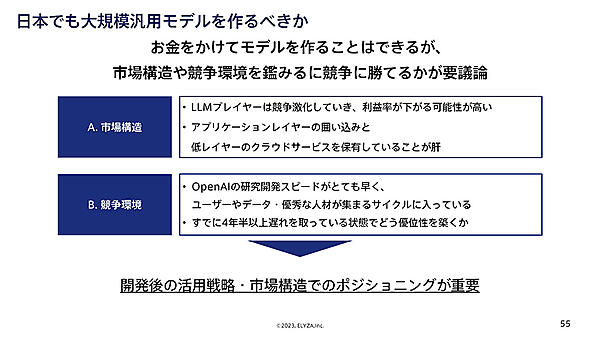

通説②大規模言語モデルを日本もいち早く作るべき

そして2つ目は「日本もいち早く大規模言語モデルを作るべき」という通説だ。曽根岡氏は「我々も絶望したところではある」と前置きをしつつ、戦略を立てることの重要性について語った。

仮に数百億円かけて作ることはできても、その後どういう活用戦略があってどう競争に勝つか、そこを考えなければ意味がありません。現在の市場のコスト構造や競争環境を見ても、OpenAIのようにMicrosoftが年間1000億ドル出資しているようなクラウドプラットフォームで同じ立場で戦えるかというと、そうではない。置かれている市場や競争環境を理解し、どのようにチューニングしていくのか、何を自分たちのドメインとして勝ち目を狙うのか、議論していく必要があるでしょう(曽根岡氏)

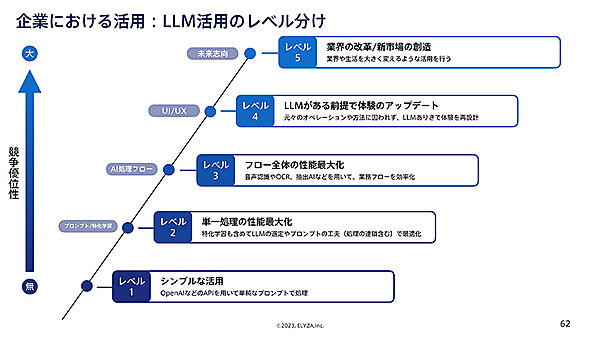

通説③自社事業へいち早くChatGPTを搭載すれば競争優位性を確保できる

最後は「自社事業へいち早くChatGPTを搭載すれば競争優位性を獲得できる」という通説についてだ。まず前提として、LLMの活用は以下のようなレベルがある。

- シンプルに単純なプロンプトで処理する活用

- 単一処理の性能の最大化

- 音声認識やOCRなどを用いつつフロー前全体の性能最大化

- 元々のオペレーションや方法に囚われない、大規模言語モデルを活用した体験アップデート

- 業界や生活を大きく変えるような活用

繰り返しになりますが、『ChatGPT』をただ導入すれば業務やUXが改善されるわけではありません。企業としてどのように学び、いかに高いレベルで活用できるかを考えなくてはいけないのではないでしょうか(曽根岡氏)

ELYZAのDXプラットフォーム「ELYZA App Platform」と質疑応答

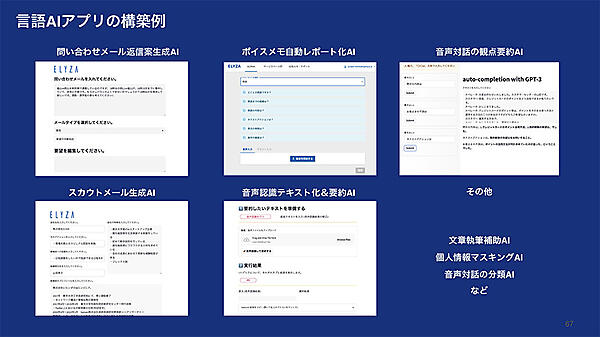

最後にELYZAが3月16日に公開した新サービス、言語AI活用プラットフォーム「ELYZA App Platform」の説明があった。これは言語AIシステムを「早く使って早く育てる」DXプラットフォームで、大規模言語モデルの高品質な活用をサポートするためのサービスだ。

活用の検討から最短1週間でAI処理フローとUIのセットが構築でき、さまざまな言語AIの使い分けができるようになるという。大企業での利用を前提としたセキュリティ環境も構築でき、実際の例として「問い合わせメール返信案生成AI」「ボイスメモ自動レポート化AI」などといったものが挙げられた。

さらに、最後に設けられた質疑応答の時間で興味深い質問があったので数個簡単に紹介する。質問への回答は取締役CMOの野⼝⻯司氏も行った。

- Q. LLMの個性は今後どうなっていく?

→特化プレイヤーと汎用プレイヤーにわかれていき、特化プレイヤーではタスクをこなすものやキャラクター生成に特化したものなどへさらに細分化していく。 - Q. 言語ごとの性能差は生まれる?

→どうやらAIの思考の部分は別にありそうだということがわかってきたので、言語は表面的な問題。思考による差は生まれるかもしれない。 - Q. 5年後、10年後のAIはどんな可能性がある?

→AIは非常に大きな可能性を秘めている。しかし、人間がAIをどう使いこなすかを学び、コントロールする必要は今後必ず出てくる。

対話AIのこれまでの歩みと、社会実装の現状について丁寧に語られた今回の勉強会。曽根岡氏によると、大企業へのAI導入が着々と進んでいるという。これからの時代を生き抜いていくためには、AIをどのように活用し、効率化を進めていくのかを考えていく必要がある。AIによってDXが活発化する未来を予期させる勉強会だった。