ウェブマスターツールのリンクレポートの更新が遅い理由

海外のSEO/SEM情報を日本語でピックアップ

ウェブマスターツールのリンクレポートの更新が遅い理由

リンク元ページのクロール頻度による (Google Webmaster Help Forum!)

グーグルウェブマスターツールの「サイトへのリンク」レポートでは、管理サイトに張られた外部リンク情報を確認できる。しかし、そのレポートに表示される情報は古いことがあり、すでに存在しないリンクがレポートに出てきたり反対に張られているはずのリンクが出て来なかったりする。

レポートの更新についてグーグルのジョン・ミューラー氏が英語版のウェブマスター向け公式ヘルプフォーラムで説明した。

ポイントをまとめると次のようになる。

- 更新は手動ではなく自動

- レポートへの反映タイミングは、URLが再クロール・再インデックスされる頻度に依存する

- クロール頻度が高ければすぐにレポートに反映されるし、クロール頻度が低ければ多少時間がかかる

レポート自体の更新間隔は2~3日おきくらいだとグーグルの社員に筆者は聞いたことがある。しかしリンク元ページを再クロールして最新の状態を取得していなければレポートに反映されるはずもない。

リンクレポートに出ている情報が古いとわかっていても自分が管理するサイトでなければどうすることもできないだろう。不自然リンク警告に対処するにはウェブマスターツールのリンクレポートが頼りなのだが最新のデータを手にできないのは削除作業をますます困難にしてしまう。

なお「最新のリンクをダウンロードする」というオプションが2~3週間前から提供されており、こちらを使えば今までよりは新しいバックリンクデータを入手できるようだ。

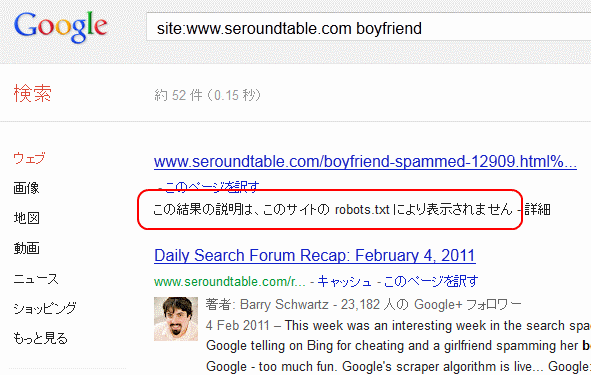

robots.txtでブロックしたページのスニペットを表示しない理由をスニペットで説明

スニペットのナイスな再利用 (Search Engine Roundtable)

robots.txtでブロックしたページがグーグルの検索結果に出てきたとき、その理由がスニペットに表示されるようになった。

「詳細」をクリックするとrobots.txtのヘルプページに移動する。そこには次のように書かれている。

robots.txt でブロックされているページのコンテンツがクロールまたはインデックス登録されることはありませんが、ウェブ上の他のページに表示されている URL はインデックスに登録される可能性があります。そのため、ページの URL、サイトへのリンクのアンカー テキスト、Open Directory Project のタイトルなどの公開情報が Google の検索結果に表示される可能性があります。

robots.txtでクロールを禁止していても「それは検索結果に表示しないようにすること」という指示にはならない(その目的ではnoindex metaタグを使う)。そのため、状況によっては検索結果に出ていることがあるのだ。しかしGooglebotはrobots.txtで指示されている「クロール禁止」を守って中身を見ることができないため、ページ内容を利用したスニペットを生成できない。

通常はそのサイトのURLがタイトルとして表示されるだけだが、そうした検索結果になっている理由をこのように示すのは、検索ユーザーに親切な良いアイデアだ。

スマホ&タブレットユーザーがウェブサイトに求めるのは「表示スピード」

ここでも高速化が要求される (Econsultancy)

米キーノート・システムズ社が5,000人のスマートフォンとタブレットの個人ユーザーを対象にウェブの閲覧状況に関する調査を実施しその結果を公開した。そのレポートのポイントを、Econsultancyブログが次のようにまとめている。

- スマホユーザーの3分の2が、「表示速度が遅いこと」に対して最も大きな不満を感じている。

- ページが5秒以内に表示されることを望んでいるのは、スマホユーザーのうち82%もいる。

- さらに厳しく4秒以内に表示されることを望んでいるユーザーも、スマホユーザーの64%いる。

- タブレットユーザーの60%は、3秒以内の表示を望んでいる。

- 満足のいく速さでなかったらサイトを離れて戻ってくることはないと16%のユーザーが回答。6%は同種の他のサイトに向かう。

米国での調査であるが日本ではどうであろうか。程度の差こそあれ、すばやく表示されるサイトをユーザーは好む傾向が日本でも見られるのではないかと筆者は想像する。

大規模サイトではクローラビリティ確保のために専用サーバー利用を推奨

共有サーバーで負荷が高くなるとクロールに悪影響あり (Dan Petrovic on Google+)

オーストラリアのSEOコンサルタント、ダン・ペトロヴィック氏がグーグルのジョン・ミューラー氏が開いたGoogle+でのハングアウト(ビデオチャット)でミューラー氏から得た情報を投稿した。

共用レンタルサーバーを借りている場合、同じサーバーを利用している他のサイトがスパムサイトばかりだと、悪影響が出ることもある。ただし、一般的な商用のサーバー会社でサイトを運用しているならば、十中八九はこうした心配をする必要はない。

とはいうものの、共用レンタルサーバーは同居している他のサイトの影響で重くなる場合がある。こうした場合、あなたのサイトのクロールに影響があるかもしれない。というのもGoogleは、サイトの反応状況に応じてクロールを調整しようとするからだ。

もし規模の大きなサイトを所有しているなら、共用レンタルサーバーではなく、専用レンタルサーバーに移すほうがいいかもしれない。

クロールするためのロボットアクセスが原因でサーバーがダウンしたり他のユーザーのアクセスが遅くなったりしないように、Googlebotはクロール頻度を自動で調整している。

だから、同じサーバーハードウェアを利用して開設している他のサイトを含めて普段から多くのアクセスがある場合は、クロールに支障をきたす可能性がある。そうした場合は、安定してアクセスをさばける専用サーバーを使ったほうがスムーズにクロールしてもらえる場合もあるということだ。

特に大規模サイトで大量のページをクロールしてもらう必要がある場合はなおさらだろう。

SEO Japanの

SEO Japanの

掲載記事からピックアップ

Webサイトの「ユーザビリティ」と「リーダビリティ」を高めるのに役立つ秘訣を説明した記事を今週はピックアップ。

- ウェブサイトのユーザビリティに関する最高の秘訣20か条

どれも今すぐ実践可能 - ウェブサイトのリーダビリティを改善するための5つの秘訣

読みやすい記事を書くコツ