Aggregator

国外における企業の取り組みを分かりやすく、タイムリーに発信したリリース

すでにニュースリリースで発表させていただきましたとおり、2014年1月の月間ベストリリース賞はヤマハ発動機株式会社様です。

2014年1月の月間ベストリリース賞、受賞リリースはこちら!

News2uリリース 2014年1月の月間ベストリリース賞

ヤマハ発動機株式会社

選定理由(審査委員長・神原弥生子のコメント)2014年1月のベストリリース賞は、ヤマハ発動機株式会社様のニュースリリースです。

本リリースは、このリリースが発表された前日に、引き渡し式が行われた点をあわせて、これまでの「ヤマハクリーンウォーターシステム」の実績と特徴をニュースリリースの本文でしっかり伝え、また、仕組みへのリンクとドキュメンタリー映像へのリンクを用意することで、関心をもってくださった方に、より深い情報を与えることができる構成になっています。

小型浄水装置「ヤマハクリーンウォーターシステム」は、新興国向けのローテクノロジーの浄水処理装置で、国内ではその存在を知っている人は多くはないと思います。

ヤマハ発動機株式会社では、このような自社のさまざまな取り組みを紹介するドキュメンタリー映像を現在Webサイトに公開しており、その動画を通じて、事業の意義を深く理解することができます。

国外での自社の取り組みを広く知らしめるきっかけとなるニュースリリースです。

選定のポイント

- 事実をタイムリーに発信している

- 周辺情報が整理されて提供されている

- 詳細情報を提供する自社サイトが充実している

「クリーンウォータービジネス」はBOPビジネスの好事例として一部では認知されていますが、まだまだヤマハ発動機が水??とびっくりされます。

世界中の人々を笑顔にする大好きな事業なので、事例を多く発信することでもっと広く認知されるようになれば、と改めて感じました。

水のビジネスに限らず、人の心を動かすような独自の取り組みを紹介するコンテンツとして、「Moving You」という少し長めの動画をウェブサイトで公開しています。

言葉では伝わらない笑顔や温度・空気感を、ぜひ合わせて見ていただきたく、本文中で紹介させて頂きました。今回、実は初めてリリースを書きまして、本当にビギナーズラックだと思っております。たくさんの方に手直しを(しかも迅速に!)していただきました。

また、実際にインドネシアに出張しており、写真も自前で撮影したため、タイムリーに発信することができたのでは、と思います。

今後もできるだけ出張先でネタを集め、世界でのさまざまな動き、そこで活躍する当社製品の様子を、広く発信していければ、と思います。

ありがとうございました。ヤマハ発動機株式会社 広報宣伝部 齋藤 真理子 様

ヤマハ発動機株式会社様、ご受賞おめでとうございます。

商品リスト広告をご利用のお客様へ:「ショッピング キャンペーン」が正式ローンチされました

昨年、一部の広告主様を対象に導入したショッピング キャンペーンは、Google で商品を管理、宣伝する小売業者向けの新たなツールです。このキャンペーンを利用すると、AdWords の管理画面で商品の在庫を直接確認し、商品リスト広告の運用、入札、レポート作成を効率的に行うことができます。

ベータ テストにご参加いただいた広告主の皆様からは、商品リスト広告の運用やトラフィックを増やす最適化作業が効率化され、時間の節約に役立っているとの評価をいただいています。以下では、お客様から寄せられたご意見の中から、ほんの一部ではありますがご紹介させていただきます。

- 「ショッピング キャンペーンの効果には本当に驚きました。広告の掲載先を以前より柔軟に管理することが可能で、小売業者が現在直面している多くの問題を解決できます。商品の管理、除外、優先度の設定も簡単で、商品リスト広告の投資収益率のさらなるアップを期待できます。」 - Todd Bowman 氏、RKG 社 プロダクト マネージャー

- 「ショッピング キャンペーンのおかげで、8,000 品目以上の商品カタログを適切に管理できるようになりました。インプレッション シェアやベンチマーク上限 CPC といった競合性に関する指標も便利で、入札単価を効率的に設定できます。」 - Nick Carter 氏、ValuePetSupplies 社 マーケティング/セールス ディレクター

- 「ショッピング キャンペーンへの移行は簡単でした。トップ ブランド別の商品グループ 25 個を手早く作成し、ベストセラーを売り込む簡単な戦略を設定しただけで、クリック単価が 6% 低減され、コンバージョン率は 13% 向上しました。この 2 つの数字が改善したことで、ショッピング キャンペーンの導入時よりコンバージョン単価が 20% も下がっています。」 - Rich Brown 氏、Farfetch 社 PPC 広告責任者

- 「当社クライアントである AllesRahmen.de のキャンペーンを新しいショッピング キャンペーンに切り替えたのは大正解でした。時間を節約できただけでなく、ベンチマーク CTR やベンチマーク上限 CPC などの指標を参考にキャンペーンを効率的に最適化できるようになり、コンバージョン単価が 88% 削減されました。」 - Melanie Lang 氏、Beyond Media 社 SEA 責任者

- 「ショッピング キャンペーンでは柔軟な入札管理が可能で、クリック率が前年比で 4 倍になりました。オーダー単価は 3 分の 2 に削減、コンバージョン率は 88% アップを実現しています。」 - Shira Reineking 氏、real 社 キャンペーン管理/オンライン ビジネス責任者

ベータ テスト中にいただいたご意見を参考に、ショッピング キャンペーンに新たに追加した一括編集機能では、複数の商品グループをまとめて編集することができます。API のサポートと入札単価のシミュレーション機能もまもなく追加予定です。ショッピング キャンペーンのサポートについては、今後も外部の代理店や検索広告の管理プラットフォームと連携して強化を図る方針です。

ショッピング キャンペーン導入の参考情報を得るには:

- ショッピング キャンペーンのチュートリアル動画を見る(英語のみ)

- ショッピング キャンペーンに関する Learn with Google ウェブ セミナーに参加する(3 月 27 日開催)

- AdWords フォーラムで質問する

セプテーニ、英国に現地法人を設立 欧州市場を開拓

電通役員人事を発表

分散するマーケティングデータを一元化する ~DMPツールを導入する前にやるべきこと~

DMPの導入はデータドリブンなマーケティングを実践するための必須条件となってきた。しかし、DMPツールを導入することがイコールDMPの導入実践ではない。

ツールを入れても、データを分析し、それを打ち手に活用している事業者やパブリッシャーは意外なほど少ない。それは、そもそも何のためにデータを分析するのか、そのためにはどのようにデータを構造化しておくか、という大前提となるやるべきことをしていないからだ。

一番重要なことはそこにある。

そして、今導入しているツールがありながら、データが分散化しているがために、DMP導入の前提を整備できていない企業が非常に多いのだ。

例えば、アクセス解析ツールと3PASを導入しているほとんどの企業は、それぞれのデータが分散している。

本格的なDMPを志向するなら、その前にアクセス解析と3PASに分散しているデータを統合することだ。その作業は必ずやっておくべきステップで、「分析環境の整備」という重要なステップである。

詳細は、デジタルインテリジェンスにコンサルを依頼して欲しいがw、DMPツールは案外ただの箱なので、中身をどうするか(どんなデータをどう分析するためにどう構造化するか、またどうクレンジングするか)が重要なのは言うまでもない。

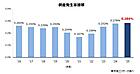

スマホ広告費、2013年は1,652億円

GoogleがSSL (HTTPS) をランキング要因に組み込む日は来るのか?

Googleの社員がこぞってウェブサイトの常時SSL化を推奨している。ひょっとしたら、HTTPSの利用がランキング要因に組み込まれる日がやってくるかもしれない。

- GoogleがSSL (HTTPS) をランキング要因に組み込む日は来るのか? -

Posted on: 海外SEO情報ブログ - SuzukiKenichi.COM

コンテンツ施策の貢献を証明する KPI 設計

コンテンツ施策の貢献を証明する KPI 設計

ヤフーとアドビ、広告制作管理で提携

モバイル動画広告バイヤーズガイド

ネスレ日本、東京マラソンEXPO2014にブース出展 ランナー応援する「ランチョコ」で盛り上がり

電通、「2013年日本の広告費」発表 総広告費は 2年連続で増加

共同PR、新東通信が筆頭株主に 創業者大橋氏から売却

グーグル、顧客にコムスコア「vCE」を提供

20万以上のURLを誤ってrobots.txtでブロック、対処策をマット・カッツがアドバイス

サイト全体を、誤ってrobots.txtでブロックしてしまったウェブマスターにGoogleのマット・カッツが対処方法をWebmasterWorldでアドバイスした。マット・カッツがWebmasterWorldに姿を見せるのは極めて珍しいこと。

- 20万以上のURLを誤ってrobots.txtでブロック、対処策をマット・カッツがアドバイス -

Posted on: 海外SEO情報ブログ - SuzukiKenichi.COM

Google アナリティクス解析講座(ゼミナール)の申込み(2014/5実施)を開始

内容詳細はこちらをご覧下さい。

[カリキュラム]

Google アナリティクスのデータ収集の仕組み、トラッキングコードのカスタマイズ、計測のための準備やアカウント設計、指標やディメンションの定義、レポートに共通の機能、各レポートの見方、レポートの各種カスタマイズ法など、Google アナリティクスの機能を最大限に引き出せる知識を学んで頂きます。

Part1:基本用語解説

Part2:データ収集の仕組み

Part3:主なレポートや機能

Part4:指標とディメンション、アドバンスセグメント

Part5:全体の設計と諸設定

Part6:その他のレポートや機能

Part7:トラッキングコードの各種カスタマイズ

Part8:カスタムレポート

[開催日時] 丸2日間、合計12時間のトレーニングプログラムです。

1日目 2014年5月16日 金曜日 (1日目) 10:00~17:00(昼休み1時間)

2日目 2014年5月23日 金曜日 (2日目) 10:00~17:00(昼休み1時間)

[開催場所] 新大宗ビル FORUM8、1103会議室

〒150-0043 東京都渋谷区道玄坂2−10−7 新大宗ビル11階

(JR、東京メトロ、田園都市線、京王井の頭線 渋谷駅 徒歩5分)

[費用]

[アクセス解析イニシアチブ 法人会員・個人会員] 78,840円(税込)

[一般申込・アクセス解析イニシアチブ 無料会員] 95,040円(税込)

早割があります。

アクセス解析講座(ゼミナール)の申込み(2014/4実施)を開始

内容詳細はこちらをご覧下さい。

[カリキュラム]

アクセス解析の仕組みや取得するデータの定義・意味、3大手法の特徴を知った上で、導入計画から実装、分析と運用までのプロセス、そして目的に応じた分析をするための手順と指標とその扱い方や見る頻度、各種データを解釈する上での留意点などを習得してもらいます。ツールに依存しない知識や分析手法を習得して頂きます。

Part1:訪問者の特性把握の演習とアクセス解析3手法

Part2:サイトの特徴を把握する演習とツール導入プロセス

Part3:サイトへの流入分析の講義と演習

Part4:サイト内の行動遷移分析の講義と演習

Part5:キャンペーン分析の講義と演習

Part6:KPIの設定方法、アクセス解析以外の定量・定性分析手法

[開催日時] 丸2日間、合計12時間のトレーニングプログラムです。

1日目 2014年4月15日 火曜日 (1日目) 10:00~17:00(昼休み1時間)

2日目 2014年4月22日 火曜日 (2日目) 10:00~17:00(昼休み1時間)

[開催場所] 新大宗ビル FORUM8、1103会議室

〒150-0043 東京都渋谷区道玄坂2−10−7 新大宗ビル11階

(JR、東京メトロ、田園都市線、京王井の頭線 渋谷駅 徒歩5分)

[費用]

[アクセス解析イニシアチブ 法人会員・個人会員] 78,840円(税込)

[アクセス解析イニシアチブ 無料会員・一般申込] 95,040円(税込)

早割があります。

CSS Nite LP31: Webデザイン行く年来る年(Shift7)フォローアップを公開します

2013年12月14日、ベルサール神田 イベントホール(2F)で開催したCSS Nite LP, Disk 31:Webデザイン行く年来る年(Shift7)のフォローアップを公開します。

- 基調講演: スクリーンの先、私たちの仕事の先/長谷川 恭久

- 新しいマークアップ環境にキャッチアップ!/益子 貴寛(サイバーガーデン)、小山田 晃浩(ピクセルグリッド)

- AccSellポッドキャスト公開録音「izuizuのアクセシビリティ(生)100本ノック!」/植木 真(インフォアクシア)、山本 和泉(#fc0)、中根 雅文(慶應義塾大学)

- ツールと制作環境2013-2014 /鷹野 雅弘 (スイッチ)、石嶋 未来(ザ・マーズナレッジ)

- スマートデバイス 2013 → 2014/たにぐち まこと(エイチツーオー・スペース)、矢野 りん、松田 直樹(まぼろし)

- スマホの検証が10倍はかどる!Remote TestKitの紹介/森本 恭平(NTTレゾナント)

- OSのフラットデザインを考えてみる/春日井 良隆(日本マイクロソフト)

- デザイントレンド: キャプチャで振り返る2013年/原 一浩(Greative)、矢野 りん、坂本 邦夫(フォルトゥナ)