Aggregator

特定のドメインに関するTwitterのつぶやきを見逃さない3つの方法

日本経済新聞社 「日本経済新聞 電子版」

バスキュール mixiアプリ「お宝ほりっくOTTIKI」

SEO Japanの今後 : 海外で人気のSEOブログ・サイトの記事が、日本語で読める!

Googleが中国撤退を発表

中国における事業展開について(GoogleJapanブログ)

Googleが中国での検索事業の撤退を発表しました。

中国政府の検閲とサイバー攻撃がその原因とのことです。

Googleの言い分、中国政府側の言い分というところに関しては、

ここで触れるべきことではないと思いますが、

中国本土の利用者の方は、Google.cn にアクセスすると、香港のサーバーで運営しているGoogle.com.hk を経由して、簡体字で検閲のない検索結果を見ることができます。ということで、香港を経由して見ることはできるそうです。

現在、(取り急ぎ日本では)http://www.google.cnにアクセスすると、

http://www.google.com.hk/にリダイレクトしました。

ちなみに、302のリダイレクトが2回入っていました。

(状況によって異なるかもしれませんが)

302を使用しているということは、「一時的なページの移動」なのか?

と勘ぐってしまいたくなりますが、そこは関係ないでしょう。

Googleは現状で、香港を経由して検索結果を提供しているわけですが、

こちらもYouTubeのようにブロックされていく可能性は高いのではないでしょうか?

そうなると、中国ではGoogleにアクセスできず、もちろん検索は使えないということになります。

これまでGoogleを使用していた中国のユーザーは非常に不便な思いをすることでしょう。

基本的に百度を使うことになるのかもしれませんが、UIも異なるし、検索結果も多少異なるので、ストレスを感じるユーザーも多いことでしょう。

中国政府とアメリカ企業との間で起こった対立に対して、ユーザーは完全に置いていかれた感じだと思います。

あと、当然Googleを扱っていた広告代理店の痛手は知る由もありません。

私も知っている代理店もありますので、心が痛みます。

これからの彼らのGoogleの広告以外の事業がうまくいことを願ってやみません。

bingは中国の法令に則った上で中国でのサービス提供に力を入れていくようです。

今後の中国でのbing(マイクロソフト)の動きには注目が必要ですね。

中国での動きが活発化すれば、マルチバイト対応などの精度も高まり、日本語にも影響が出てくる可能性はあると思われます。

今回はGoogleが撤退するという形になったわけですが、なんとなく釈然としない思いなのは、私だけではないと思います。

中国のユーザーや代理店等への被害が少ないことを祈りたいと思います。

【木村 賢】

これだけは知っておきたい中国 SEM 事情 Vol.6――中国 EC 激戦区での生き残り方

リッチ スニペットが microdata に対応しました

microdata はウェブページ内の構造化データを指定するためのマークアップ規格で、HTML5 の仕様書に説明が含まれています。HTML5 は、ウェブの基本言語である HLTML の 5 回目の大きな改訂版です。

以下は、「L' Amourita Pizza」というレストランのレビューが書かれている HTML の一部分です。

以下は、上の HTML において、レストラン、レビュー作成者、日にち、そして評価の情報を microdata でマークアップした状態です。

microdata は、情報量が豊かでありながらシンプルであるという特徴があります。ご覧のように、itemscope ( 新しいデータを指定する )、itemtype ( データの種類を指定する )、itemprop ( データのプロパティを指定する ) などの HTML 属性を追加するだけで、そのページのマークアップは完了です。マークアップが完了したら、Rich Snippets Testing Tool (英語) を使って Google がデータを適切に解釈できているか確認してみてください。

microformats や RDFa 同様、Google が対応している規格はリッチ スニペットについてのヘルプだけでなく data-vocabulary.org (英語) でもご確認いただけます。Google が解釈できるデータの種類やプロパティについても書かれています。コンテンツをマークアップすれば、必ず Google の検索結果でリッチ スニペットが表示されるとは限りません。Google は今後も microdata マークアップの対応を進め、ユーザーのみなさまに快適にご利用いただけるよう尽力します。

リッチ スニペットと microdata に関しては、以下のページもご参照ください。

- リッチ スニペット ( 構造化データ )

- Overview of microdata (英語)

- Official microdata specification (英語)

- Rich snippets testing tool (英語)

Google、中国における今後の方針を正式発表-検索事業、香港へ。

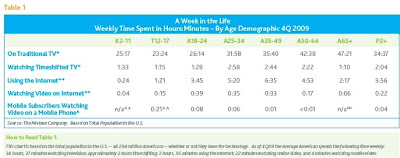

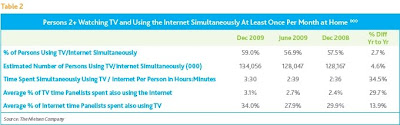

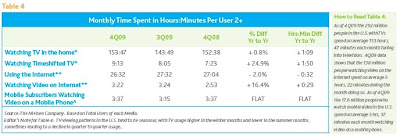

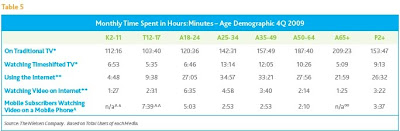

米35%の人がテレビとインターネットと同時に見ている

トライバルメディアハウスが満3歳になりました

皆さまのおかげで、本日、トライバルメディアハウスは満3歳の誕生日を迎えることができました。

わーパチパチパチ・・・。

ご愛顧、ご支援、本当に本当にありがとうございます。皆さまのおかげで、絶好調な一年となりました。

今年も、クライアント様にめぐまれ、いろいろなお仕事をさせて頂きました。

●Social Media Centers Of Excellence策定コンサルティング(マイクロソフト様)

●Limited Christmas;クリスマスキャンペーン(USJ様)

●コミュニケーションプラットフォーム:cal-feeの企画・プロモーション(ベネッセ様)

●スペース・ファンタジー・ザ・ライドローンチプロモーション(USJ様)

●現在、数件仕込み中・・・w

●あと、今年はブームリサーチのサービスも提供開始をした年でした

来年は、ソーシャルメディアマーケティングのコンサルティング含め、さらに案件の幅が拡がりそうな予感です。

まだまだピヨピヨですが、社員一丸となって頑張ってまいりますので、今後とも宜しくお願い致しますっ!

トライバルメディアハウス

池田紀行

トライバルメディアハウスが満3歳になりました

皆さまのおかげで、本日、トライバルメディアハウスは満3歳の誕生日を迎えることができました。

わーパチパチパチ・・・。

ご愛顧、ご支援、本当に本当にありがとうございます。皆さまのおかげで、絶好調な一年となりました。

今年も、クライアント様にめぐまれ、いろいろなお仕事をさせて頂きました。

●Social Media Centers Of Excellence策定コンサルティング(マイクロソフト様)

●Limited Christmas;クリスマスキャンペーン(USJ様)

●コミュニケーションプラットフォーム:cal-feeの企画・プロモーション(ベネッセ様)

●スペース・ファンタジー・ザ・ライドローンチプロモーション(USJ様)

●現在、数件仕込み中・・・w

●あと、今年はブームリサーチのサービスも提供開始をした年でした

来年は、ソーシャルメディアマーケティングのコンサルティング含め、さらに案件の幅が拡がりそうな予感です。

まだまだピヨピヨですが、社員一丸となって頑張ってまいりますので、今後とも宜しくお願い致しますっ!

トライバルメディアハウス

池田紀行

NHK 激動マスメディア~テレビ・新聞の未来~ がっかりの内容

NHKだからこういう番組ができるというスケダチくんの意見も確かにもっともだけど、いやはや、ガッカリしたな。

1年前の「テレビのこれから」より議論が後退している。佐々木さんだけ見識が際立って、あとの人は全くトンチンカンだった。去年と違うのはツイッターで大量の視聴者が参加したことか。新聞協会や民放連という立場での参加は、むしろ気の毒でもある。「マスメディア側」ということにしたければ、論客を別途用意すべきだった。

FIGARO Japon 20TH ANNIVERSARY

ソーシャルメディアマーケティングのトリセツ

smashmediaの河野さんが、日本マーケティング協会で実施した「ソーシャルメディアマーケティングのトリセツ」の講義テキストを公開してくれています。

すごくよくまとまっています!

やっぱり、実際に運用をされている方の資料は説得力が違います。

河野さんのブログエントリーはこちら。

感謝です。

ソーシャルメディアマーケティングのトリセツ

smashmediaの河野さんが、日本マーケティング協会で実施した「ソーシャルメディアマーケティングのトリセツ」の講義テキストを公開してくれています。

すごくよくまとまっています!

やっぱり、実際に運用をされている方の資料は説得力が違います。

河野さんのブログエントリーはこちら。

感謝です。

トヨタ passo ハナ女子大学

米メール・マーケティング、St. Patrick’s DayとEaster向けで上昇

バレンタイン前の静けさ、米メールプロモーション状況(The Retail Email Blog)

Google Analytics のトラッキング をオプトアウトできるブラウザのプラグインをまもなく公開します

Posted by Amy Chang, Group Product Manager, Google Analytics

Google Analytics はウェブサイトのトラフィック データとマーケティングの効率性をサイト所有者に提供するのと同様に、インターネット利用者のプライバシーの保護も重要だと認識しております。そのため、以前より Google Analytics によるトラッキングをインターネット利用者の意志で選択できる方法を模索してきました。

この度、その手段としてブラウザのプラグインを使用したトラッキングのオプトアウト機能を提供させていただくことになりました。インターネット利用者は、この機能を使用して Google Analytics によるトラッキングを無効にすることができます。現在、最終的な開発とテストを行っており、今後数週間の内に皆様にご利用いただける予定となっております。