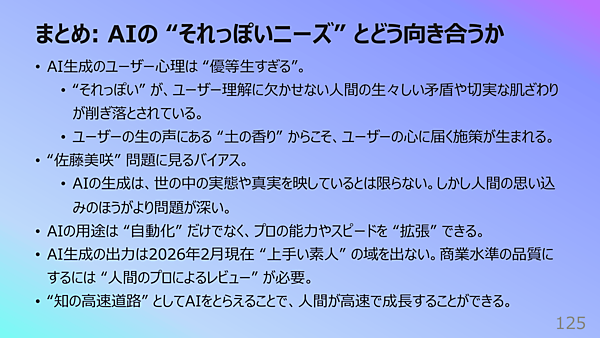

生成AIは、ユーザー心理をいかにも「それっぽく」言語化してくれる。だが、そのまま施策やプロダクトに落とし込もうとすると、どこか手応えが弱い——。

「デジタルマーケターズサミット 2026 Winter」では、日本ウェブデザインの羽山祥樹氏が登壇。AIが生成する「優等生すぎる」ユーザー像の落とし穴と、UX・マーケティング実務におけるAIの扱い方を解説した。

ポイントは、人間の行動や矛盾を含む「現場の生々しさ」を取り戻すこと。そしてAIを「自動化」としてだけでなく、人間の判断を前提にした「拡張」として使いこなすことだ。

(HCD-Net認定 人間中心設計専門家)

AIが出す“それっぽい”ユーザー心理、どこまで信じていい?

冒頭、羽山氏は講演のゴールを提示した。

AIが「ユーザー心理はこうだ」と、手軽にそれっぽい回答を出してくれる時代になりました。「これでいいじゃん」と思う一方で、「本当に信じていいのか?」という疑念も湧くはずです。本講演が、AIをどこまで信じ、何に気をつけるべきかのヒントになればと思います(羽山氏)

生成AIは、画像からテキスト、音楽、動画まで、実にそれっぽいものを生成する。人の心という、システム化しづらいと思われていた領域すら、AIに聞けばもっともらしい答えが返ってくる。問題は、その「それっぽさ」が、私たちの判断力を鈍らせていないかという点だ。

AI生成のユーザー心理「優等生すぎる」

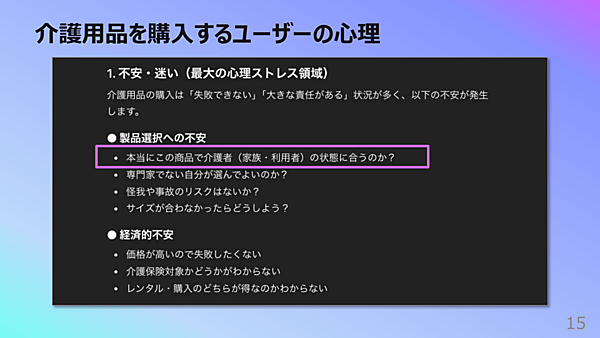

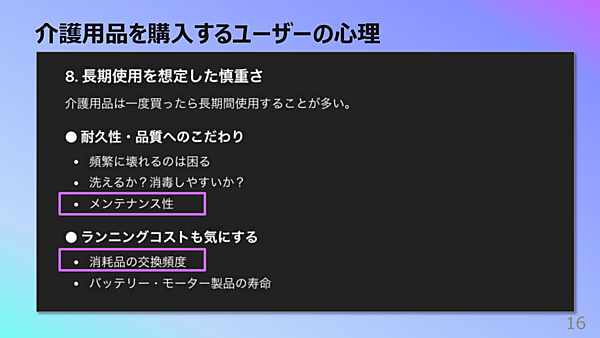

羽山氏は例として、ChatGPTに「介護用品を購入するときに、ユーザーが考えるであろう心理を洗い出してください」と問いかけた出力を示した。そこには、次のような項目が並ぶ:

- 【製品選択への不安】本当にこの商品で介護者(家族・利用者)の状態に合うのか?

- 【耐久性・品質へのこだわり】メンテナンス性

- 【ランニングコストも気にする】消耗品の交換頻度

- 【罪悪感・葛藤】もっと自分で介護すべきなのでは など

読む側は「それはそう」「そんな気がする」と頷ける。だが、そこから「具体的な施策を考えてみましょう」と進もうとすると、急に手が止まる。

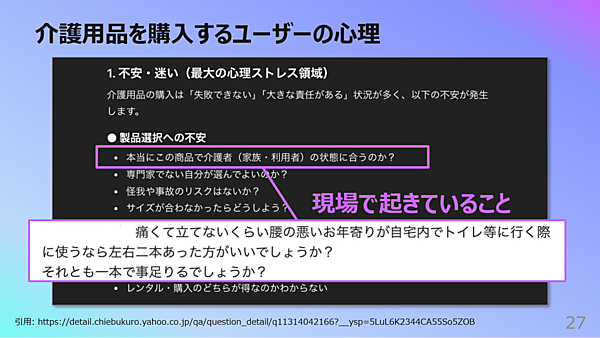

たとえばChatGPTの回答で製品選択の不安として「本当にこの商品で介護者(家族・利用者)の状態に合うのか?」という心理が挙げられている。しかし、それを解決するために「何を伝えればいい?」と自問しても、発想が広がらないのだ。

考えられなくはない気がしますが、やりづらいですね。なかなか発想が深まっていかない、広がっていかない。AIの出力は“論理的で正しい”のに、施策の起点になりにくいのです(羽山氏)

その理由を、羽山氏は「AIが優等生すぎるから」だとまとめる。

整っているんですよ。異論はないんです。でも人間ってすごく生々しいし、あるいは矛盾している。たとえば「ダイエットしてるけど、お腹いっぱいご飯食べたい」のように、矛盾した欲求が同居する。現場の生々しさが抜け落ちると、施策の発想を深める、あるいは広げるための摩擦が生まれないんです(羽山氏)

AIが提示するのは平均的で説明しやすい物語になりやすく、現場で効く解像度(迷い・苛立ち・事情・制約など)が薄い。これが「なぜかやりづらい」の正体だ。

ユーザーの心に届く施策を生む「現場の生々しさ」

では、どうやって優等生すぎない「現場の生々しさ」を取り戻すのか。羽山氏が推奨するのは、AIの出力を「実際のユーザーの声」と照らし合わせることだ。手軽な手段として、「Yahoo!知恵袋」「OKWAVE」などのQ&Aサイトを活用したデスクリサーチをよく行うという。

すべてのユーザーニーズがQ&Aサイトに的確に出ているか? もちろん、そんなことはありません。それでも、Q&Aサイトへ投稿された相談は、少なくともユーザーが実際に書いた“生の声”ではある(羽山氏)

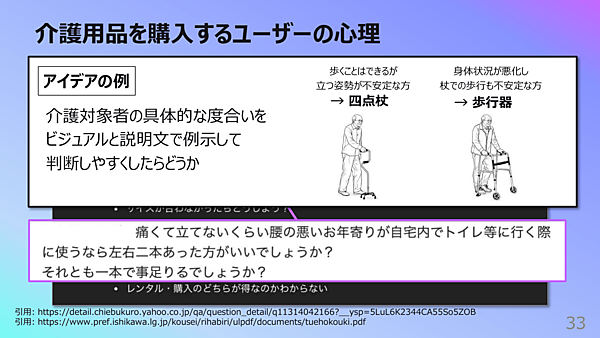

ここに、施策につながる現場の生々しさがあるという。事例として、四点杖(杖先が四点で自立する杖)に関する相談が挙げられた。

相談事例①

痛くて立てないくらい腰の悪いお年寄りが自宅内でトイレ等に行く際に使うなら左右二本あった方がいいでしょうか? それとも一本でこと足りるでしょうか?

このような切実な問いは、「この商品で介護者の状態に合うのか」というAIの抽象的な回答では知ることのできない現場の生々しさを私たちにもたらしてくれる。

二本杖と異なり、四点杖は結構重い。そもそも杖は自立できる人の歩行を補助するためのもので、立てないほど痛い人には別の介護器具が好ましい。このユーザーはそもそも四点杖以外の介護器具が存在することに気がついていない。切羽詰まった状況にいるのに、自分の視野の外に好ましい選択肢があることに気がつくすべがなく、自身に見えている狭い選択肢のなかで何とかやりくりしようとしている。ユーザーのこの生々しい困惑を受け止めて、はじめて適切な施策が設計できる(羽山氏)

2つ目の例は、認知症の親の介護に関する悩みだ。

相談事例②

掛け布団がほぼ毎晩のように汚れます。洗濯も大変だし、私も会社員なのでやりきれません。たとえば端に新聞紙でも?とか考えましたが、高コスパで簡易な方法があったら教えてください。

AIが書いた「メンテナンス性」「消耗品の交換頻度」という無機質な言葉が、ここでは「夜間の負担」「時間の制約」「安く済ませたい切実さ」として生々しく立ち上がる。

相談事例③

認知症の両親を介護しています。生活費も私が工面しています。作った食事をかなりの頻度で平気な顔して捨てられます。そのたびに「もういいやこいつら」という気持ちになります。しかし、親なので結局は面倒をみてしまい、また嫌な思いをさせられます。もう疲れました。親を想って頑張っている気持ちを踏みにじられるように感じます。これって自分がおかしいのでしょうか?

AIの回答にある「もっと自分で介護すべきなのでは」というシンプルな一行の中身は、両親に対しての「もういいやこいつら」「これって自分がおかしいのでしょうか?」という呪詛(じゅそ)と悲鳴なのだ。

AIの“心理リスト”を眺めているだけでは、この生々しさは出てこない。羽山氏は例を紹介したあと、「この深さまでユーザーの解像度が高くなって、はじめて具体的な施策が出てくるのです」と断言した。

推し活から読み解く、ユーザー心理の「体験のねじれ」

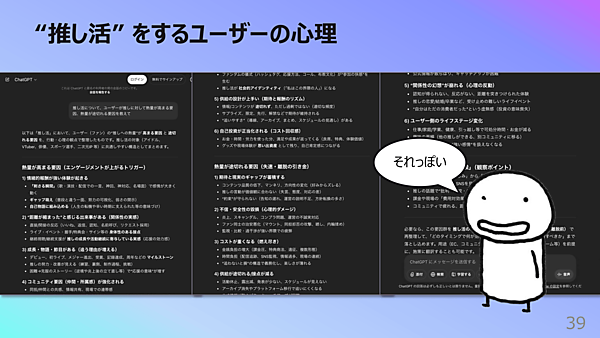

次に羽山氏が取り上げたテーマは、推し活だ。AIに推しへの「熱量が高まる要因・途切れる要因」を聞くと「距離が縮まったと感じる出来事」「コミュニティ要因」など、誰もが納得する優等生な回答が並ぶ。

しかし羽山氏は、これを実際のインタビューから得た「生の声」と対比させる。

たとえば熱狂が加速する決定打は、単なる距離の近さではなく「推しに認知された実感」であり、現場で「全国のファンとつながる」こと自体がモチベーションを支えていた。

逆に熱量が下がる局面も、「単に供給が止まる」だけではない。コロナ禍で現場から足が遠のいたファンには、「2年分の情報をキャッチアップできない引け目」や「空白を埋めるエネルギーがもうない」といった、複雑な「体験のねじれ」が生じていたという。

AIのそれっぽく整った回答からでは読み取りづらい、こうした複雑な感情の摩擦や矛盾、疲れまで含めて理解してはじめて、ユーザー心理は具体的な施策に落とし込める。羽山氏がAIのペルソナを「優等生すぎる」と評した真意がここにある。

うわべの理解を防ぐ「土の香りを残す」姿勢

羽山氏は、ユーザー理解の質を表す言葉として、KJ法の考案者である川喜田二郎氏の「土の香りを残せ」という表現を引用した。

ユーザーの肌ざわり、手ざわり、そのリアリティが得られるだけの解像度がないと、うわべの“それっぽい”理解にとどまってしまう。生々しさを一連の作業の中でキープし続ける姿勢が重要です(羽山氏)

AIペルソナが「佐藤美咲」ばかりになる謎

AIの出力を鵜呑みにする危うさの例として、羽山氏が挙げたのが「佐藤美咲問題」だ。AIにペルソナを作成させると、かなりの頻度で「佐藤美咲」という名前が出力されるという。「名前が偏って生成されるなら、他の項目も偏っているのではないか?」という不安が湧く。

羽山氏はGeminiの「Deep Research」を使って原因を調べる過程も紹介した。AIが検索を行うと、「2009年の富士通の技術論文が起点です」と、それっぽい説明が組み立てられた。しかし、これはAIによるハルシネーション(もっともらしい嘘)であり、ネット上の誰かが書いた“未検証の思い込み”を事実として採用してしまった結果だったのだ。

AIのハルシネーションを助長する人間の誤認

ここで羽山氏は、AIのバイアスやハルシネーション以上に「判断する人間側」の危うさを突く。

AIの出力は、あなたが書いたプロンプトで期待している結論を叶えるように生成されます。もしあなたが自分自身の無意識の仮説をプロンプトに含めてしまったら、AIはその結論を支持するための情報を探しにいってしまう。たとえば、ネット上の未検証の思い込みを材料に組み立ててしまう。つまり、AIのバイアスやハルシネーション以上に危ういのは、あなたの無意識の思い込みがプロンプトをつうじて注入され、あたかも事実であるかのように、それっぽく提示されてしまうのです(羽山氏)

結局のところ問われるのは、「それが本当に正しいのか否か」を判断できる受け手のリテラシーだ。ユーザー理解においても同様で、現場の生きた知識がなければ、AIの推論のどこが危ういのかを判断することはできない。

AIで実務を加速させた事例:自動化ではなく「能力拡張」

では、AIは実務で使えないのだろうか。羽山氏はそれを明確に否定する。

羽山氏は、株式会社はてなが提供する親和図法支援ツール「toitta(トイッタ)」を例に挙げた。普段なら何日もかかる親和図法(インタビューの書き起こしから切片化などの作業)が、わずか数時間で仕上がった経験を語る。

羽山氏によれば、AI活用のアプローチは大きく「作業の自動化(Automation)」と「人間の能力拡張(Augmentation)」の2つに整理される。前者が「AIが勝手に作業して結果を出してくれる」ものだとすれば、toittaで羽山氏が体感したのは後者の「AIを使いこなして人間の能力を拡張する」ものだった。

少なくとも現時点(2026年2月)において、AIの生成物のクオリティは商用レベルに至らない。羽山氏は画像生成を例に挙げ、プロのデザイナーに添削してもらうと「人体の構造がおかしい」など、細部の破綻が次々と浮かぶと指摘する。

画像だけでなく、文章でも動画でもプログラミングでも、今日時点では100%の精度は出ないので、プロが見て直していく必要があるのです(羽山氏)

重要なのは、自力で直せるかどうかだ。知識のない素人が出力結果を見ても、どこが間違っているのかを判断できない。羽山氏は現在のAIを手先の器用な“うまい素人”と表現し、素人がAIを使っていきなりプロになれるわけではないと語る。

ただし、世の中の成果物すべてが商業水準を要するわけではなく、プレゼン資料の挿絵のように「それっぽければよい」もので足りることも多い。用途に応じて許容できる品質を見極めることが、AI活用の現実解になる。

AIにすべてを任せるのではなく、プロがもっとプロになるために、人間(専門家)が最終的な分析や判断を行うことを前提に、手間のかかる初期作業の“下ごしらえ”を高速化してくれるツールとして機能させるべきである。

AI時代のUX設計は「土の香り」と「能力拡張」の両立で

最後に羽山氏は、AIを「知の高速道路」として捉える視点を提示した。「知の高速道路」とは、インターネットやAIなどの進化により、誰もが先人たちの知恵を圧倒的なスピードで学習できる環境を指す言葉だ。

企業でのAI活用が進むほど、かんたんな仕事はAIでできてしまうようになり、かつてなら若者の成長のきっかけになっていた下積み作業が失われる。また若手の側でもAIのアウトプットを「それっぽいからこれでいいや」と検証せずに使い、思考を止めてしまう道もある。

とはいえ、悲観すべきことばかりではない。藤井聡太竜王の例を引き、AIを「人類の叡智が凝縮されたもの」として徹底的に研究・吸収し、一気にプロフェッショナルへと成長を遂げる道もあるという。

AI時代のUX・マーケティング実務において問われるのは、AIの出力を鵜呑みにしない現場への解像度と、AIを自動化ではなく拡張として自分の知肉へと取り込んでいく姿勢だ。土の香りを残しながら、AIの力で自身の学習スピードを圧倒的に速める——その両立の重要性を力強く呼びかけ、羽山氏は講演を締めくくった。