その情報、本当に信じて大丈夫? 普段、気づかぬうちに偽情報に触れ、時にそれを拡散してしまっているかもしれない。企業の公式アカウントや従業員の発信が、思わぬリスクを招くことも——。

「Web担当者Forum ミーティング 2025 秋」の本セッションは、日本ファクトチェックセンターの古田大輔氏が登壇。偽情報・誤情報が拡散する現代において、企業は「情報の受発信」にどう向き合うべきか。ファクトチェックの現場とAI活用の知見を交えながら、企業が抱えるリスクとその対策について解説する。

情報の受発信に潜む企業リスクとは?

「僕らがいくらファクトチェックしても、追いつかないんですよ。偽情報のほうが多いから」

そう語るのは、日本ファクトチェックセンター(以下、「JFC」と記載)の古田大輔氏。政治家や著名人の発言の真偽を検証するJFCは、ファクトチェックだけでなく、メディアリテラシーの普及にも力を入れている。なぜなら、情報洪水の中で、個人が“見極める力”を持たなければ、企業も個人も守れないからだ。

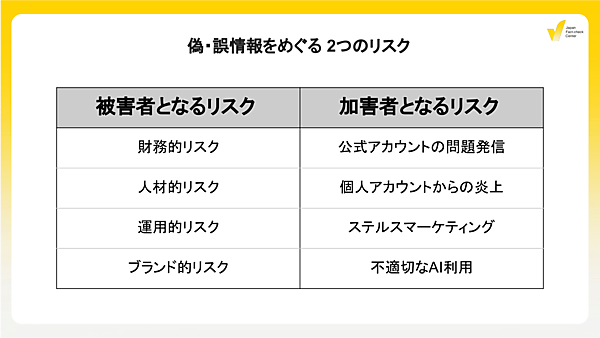

この2年間で延べ1万2000人に講演を行い、企業からの依頼も増えていると言う。企業が偽情報や誹謗中傷にさらされるリスクは、決して他人事ではない。古田氏は「企業は“受信”でも“発信”でもリスクを抱える」と語る。

たとえば、誤情報によって企業が被害者になるケース。財務的な損失、採用難、抗議の殺到、ブランド毀損——こうしたリスクは、企業の運営に直接影響を及ぼす。一方で、加害者になる可能性もある。公式アカウントの不用意な発言、従業員や経営者の個人アカウントの炎上、ステルスマーケティング、不適切なAI利用など、発信側のミスが企業の信用を揺るがす。

AIを使いこなすには、まず人間側にリテラシーが必要

AIがリスクを減らすこともあれば、増やすこともあるんです(古田氏)

世界180以上のファクトチェック団体が集まる「グローバルファクト」でも、AIの限界は共通認識だ。インドの技術者による講演では「AIには人間の監督と専門知識が不可欠」と強調された。AIを使いこなすには、まず人間側にリテラシーが必要なのだ。

AIにすべてを任せるのは、大事故につながりかねない。だからこそ、最初に人間を鍛える必要がある(古田氏)

企業のWeb担当者にとって、情報の受発信は日常業務の一部だ。だからこそ、リスクを正しく理解し、ファクトチェックのスキルとリテラシーを育てることが、これからの時代の必須になる。

偽情報は、見ているのに気づけない

皆さん、朝起きてからこの会場に来るまでの間に、誤情報や偽情報を見聞きしています。間違いなく(古田氏)

古田氏のこの言葉に、会場の参加者は息をのんだ。偽情報や誤情報は、特別な誰かが引っかかるものではなく、私たち全員が日常的に触れている。ただ、気づいていないだけ。それを裏付ける調査がある。

JFCでは、国際大学グローバル・コミュニケーション・センター(GLOCOM)と共同で、2024年に予備調査2万人、本調査5000人を対象とした大規模な調査を実施した。結果はすべて無料で公開されているので、興味があったらぜひチェックしてみてほしい。

調査では、2023年に実際に拡散された15の偽情報(政治・経済・医療・環境など)を提示し、以下を尋ねた。

- 「この情報、見たことがありますか?」

- 「これは正しいと思いますか?」

その結果が、衝撃的だった。

- 15の偽情報のうち、1つ以上、「見聞きしたことがある」と答えた人:37%

- その情報を「正しい」と答えた人:51.5%

しかも、提示された偽情報は「その分野に少し詳しければすぐに間違いとわかる」レベルのもの。たとえば「サウナで年間1万7000人が死亡している」といった荒唐無稽な内容だ。

偽情報を「見たことがある」と自覚している人はわずか14.5%。残りの8割以上は、偽情報を「正しい」「正しいかもしれない」と思いながら生活していると言う。

偽情報はなぜ生まれ、なぜ広がるのか?

古田氏は、偽情報を生み出す動機を次の3つに分類する。

偽情報の“作り手”の動機

- 故意犯:意図的に嘘を流し、政治的・経済的利益を得ようとする

- 確信犯:誤った信念に基づき、善意で偽情報を拡散する

(例)ワクチンを「毒」と信じる人が、厚労省の副反応データを誤解して拡散 - 愉快犯:注目を集めたい、面白がりたいという動機で嘘を流す

実は、偽情報や誤った情報を見聞きしたあと、それを広めてしまう人って、全体の約2割もいるんです。情報が正しいかどうかに関係なく、「これは事実だ」と思い込んで、無意識のうちにシェアしてしまうんです。そうやって、間違った情報がどんどん広がっていくんです(古田氏)

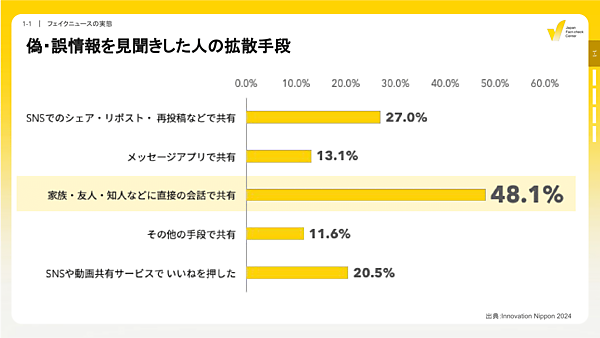

驚くことに、一番広がりやすいのは“クチコミ”だと指摘する。家族や友人との何気ない会話、職場での雑談、今日のようなイベント会場で久しぶりに会った人との「ねえ、あの話知ってる?」というやりとり。こういう日常の会話の中で、誤った情報が広がってしまう。

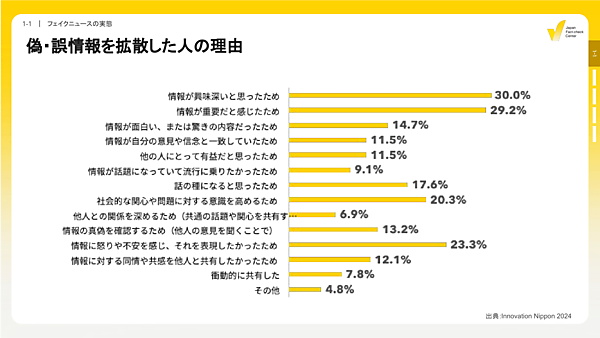

実際に偽情報を広めてしまった人に理由を聞いてみると、「間違っているとは思わなかった」「大事な情報だと思ったから伝えた」と答える。つまり、悪意があるわけではなく、むしろ“善意”で広めてしまっている。

偽情報の“広げ手”の心理

- 善意:「大事な情報だから、誰かに教えてあげたい」

- 正義感:「これは許せない、知らせなければ」

- 興味・驚き:「おもしろいからシェアしたい」

オフィスの雑談、ランチのひととき、LINEのやりとり。私たちは、裏取りもせずに情報を共有してしまう。だからこそ、誰もが“加害者”にも“被害者”にもなり得るのだ。

なぜ、私たちは騙されるのか?

人はなぜ、そんなに簡単に間違った情報を信じてしまうのか? その答えのひとつが、「バイアス」だと古田氏は語る。

バイアスとは、自分の経験や信念に基づいて、無意識に“合理的”な判断をしてしまうこと。たとえば、自分が信じたい情報、怒りや不安を感じる情報、正義感を刺激する情報。そうしたものに、人は自然と引き寄せられ、信じてしまう。しかも、それが間違っているかどうかを確かめる前に、誰かに伝えてしまう。

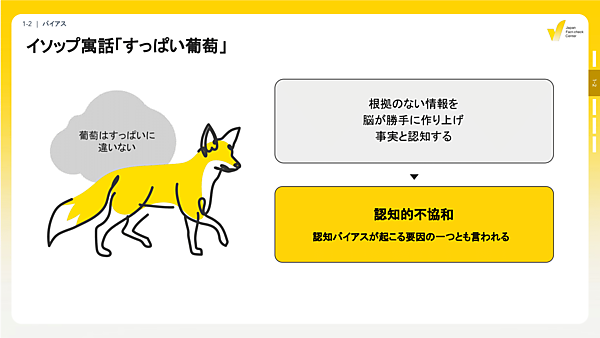

イソップ寓話「酸っぱいぶどう」に見るバイアスの正体

「酸っぱいぶどう」のあらすじは、こうだ。

ある日、お腹を空かせたキツネが、木の上に美味しそうなぶどうを見つけた。でも、いくらジャンプしても届かない。何度も挑戦したけれど、結局あきらめてこう言う。「あんなぶどう、どうせ酸っぱいに決まっているさ」。

この話は、「手に入らないものを悪く言って自分を納得させる」心理を描いている。不快感を和らげる情報を、脳が勝手に作り上げて、そちらを事実と認知しようとする。このことを専門用語で「認知的不協和」と言う。ほかにも、バイアスにはいろいろな種類がある。

主なバイアスの種類

- 自己奉仕バイアス:成功は自分のおかげ、失敗は他人のせい。自分の価値観を肯定するメディアに高評価を与える

- 確証バイアス:自分の考えを裏付ける情報だけを信じ、反対意見は無視

- 拡張バイアス:自分の価値観に合う情報を、より重要だと感じてしまう

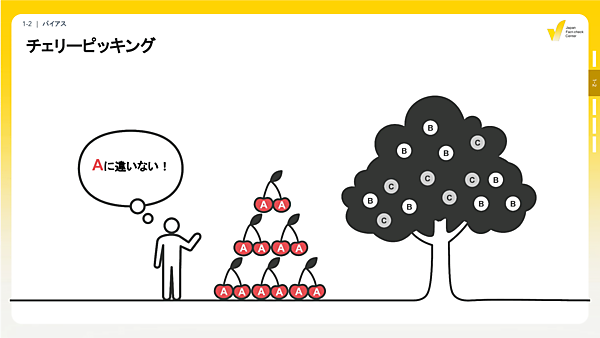

企業でありがちなのが「チェリーピッキング」。上司が求める情報だけを集めて、他の視点を排除してしまう。このようなバイアスは昔からあるのですが、情報の偏りが加速する背景には、「アルゴリズムの進化」があるのです(古田氏)

アルゴリズムが偏りを加速させる

古田氏はさらに続ける。

昔はアルゴリズムの力なんて大したことないと思っていました。でも、TikTokを見て考えが変わった。これ、とんでもない世界が来たわ。これもうフィルターバブルがめちゃくちゃ働く世界だぞと思ったのです(古田氏)

TikTokなどのショート動画が、ユーザーの好みを数十秒で学習し、似た情報を次々と届けてくる。YouTubeやInstagramも一斉にショート動画を始めたのは、アルゴリズムが学ぶ回数を増やすため。さらには、SNSのフォロー・フォロワーの関係で、この人いいなと思ってフォローする。そうすると、コメント欄も含めて同じような意見の人たちばかりが集まる。「この良さがわからない奴らはバカだ」みたいな会話になり、ものすごい偏りが増えていく。

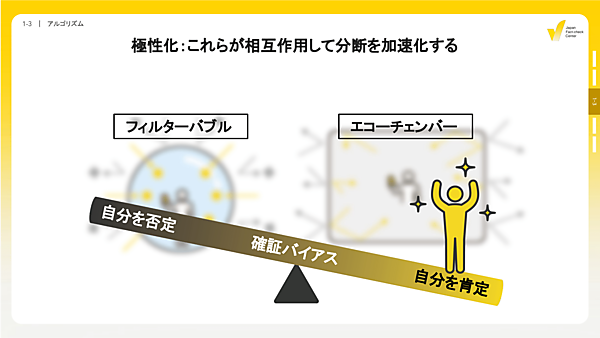

アルゴリズムの影響

- フィルターバブル:見たい情報だけが届き、他の視点が遮断される

エコーチェンバー(反響室):同じ意見の人ばかりが集まり、偏りが強化される

これらが相互作用して、分断を加速させる。

偏りを防ぐ鍵は「クリティカルシンキング」

それでは、どうすればこの偏りから抜け出せるのか。古田氏が強調したのが「クリティカルシンキング(批判的思考)」だ。

クリティカルシンキングとは?

- 批判的思考、本質的には“吟味する思考”

- 脳の「システム1(直感)」と「システム2(熟考)」を使い分ける

システム1:自動で動く直感的判断(例:信号が青→渡る)

システム2:意識して動かす思考(例:386×259を計算する)

ここで、古田氏は興味深い調査結果を紹介する。

- クリティカルシンキングの成績が高い人ほど、偽情報の拡散に慎重

- 一方で「自分はできている」と思っている人ほど、騙されやすい傾向

これは「ダニング=クルーガー効果」と呼ばれるバイアスの一種で、「自信満々な人ほど、実は騙されやすい。しかも周囲が注意しづらい」傾向があると言う。

政治家、医師、経営者、こういった専門分野で実績のある人ほど、自分の専門外でも“わかっているつもり”になりがちだ。だからこそ、誰もが「自分も偏っている」「自分も騙されやすい」という前提を持つことが重要だと古田氏は語る。

AI活用の落とし穴:まず知るべき2つの弱点と対策

ここからは、AIを使うときに私たちは何に気をつけたらよいか、という話に入る。AIは便利だが完璧ではない、つまりAIの弱点を知っておく必要があるとして、AIが抱える2つの弱点を古田氏は挙げた。

- バイアス(偏り)

AIは人間が作ったデータを学習しているため、ジェンダーや人種などの偏りを含む

(例)医者の画像→白人男性、看護師の画像→アジア系女性 - ハルシネーション(幻覚)

AIは“それっぽい”答えを生成するが、事実と異なることがある

(例)URLを勝手に“推測”して捏造する

(例)オーストラリア政府に提出されたAIレポートが誤りだらけで返金騒動に

AIを信用しすぎない──AAAフレームワークで確認

AIが賢くなったからといって、人間のチェックは欠かせない。どのようにチェックをすればよいのか。AIの出力結果をチェックする際に参考になるのがAAAフレームワークだ。

AAAフレームワーク

生成AIの回答を、以下3つの「A」で構成される視点でチェックをする。

- Accurate(正確性)

□ 誤りが含まれていないか。

□ 出典は実在するか。URLは捏造ではないか。

□ 信頼できる根拠に基づいているか。

□ 論理的な矛盾や推測や憶測に基づいた回答ではないか。 - Appropriate(適切性)

□ 法的・倫理的に適切か。

□ 社会的な習慣からみて適切か。 Aligned(整合性)

□ 回答に求めていた方向性と一致しているか。

□ これまでの発信との整合性があるか。

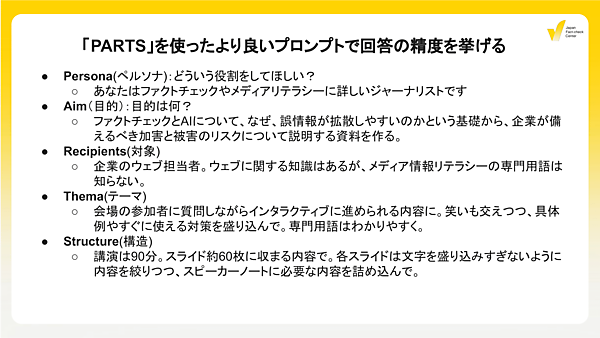

精度の高い回答を引き出す技術──PARTSフレームワーク

また、プロンプト(指示文)の質を高めて、より精度の高い回答を引き出すことも有効だ。そこで役立つのがPARTS(パーツ)というフレームワークだ。

PARTSフレームワーク

- P(Persona):AIにどんな役割を担わせるか

(例)ファクトチェックに詳しいジャーナリストとして回答して - A(Aim):目的は何か

(例)企業の加害・被害リスクを説明する資料を作成して - R(Recipient):情報の受け手は誰か

(例)Web担当者。専門用語は知らない前提で - T(Theme):語り口や構成

(例)笑いも交えつつ、具体例と対策を盛り込んで - S(Structure):構造や分量

(例)60枚のスライドに収まるように、スピーカーノートに補足を記載

ただしですね。繰り返しになりますが、精度が高まったから人間がチェックしなくていいなんてことはありません。どんなによいプロンプトを作ろうが、AIの性能が良くなろうが、間違いが0%になることはないので、必ず人間が最終チェックすることが大事です(古田氏)

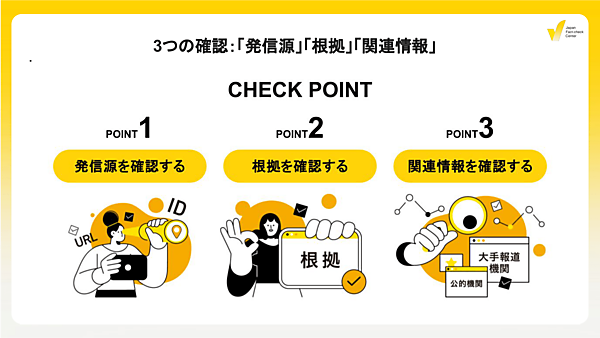

情報を見極めるための「3つの確認ポイント」

最後に、古田氏は「個人としてできる対策」として3つの確認ポイントを解説した。

情報を信じる前に、必ず確認すべき3点

- 発信源を確認する

誰が言っているのか。その人はその情報を知りうる立場か。

(例)能登半島地震の偽投稿。アカウントを見れば一目で怪しいとわかる - 根拠を確認する

その情報に裏付けはあるか。根拠とされているものは本当に根拠になりうるか。

(例)字幕付き動画の内容が、実際の音声と全く違うケースも多い - 関連情報を確認する

他の信頼できる機関(消防・警察・自治体・報道機関など)はどう発信しているか。その情報を知りうる人や組織に関する報道はないか。

善意でシェアする前に、3分だけ調べてください。それだけで偽情報の拡散は防げます(古田氏)

なお、JFCのWebサイトでは、「理論編・実践編 各10本」の無料コンテンツを公開している。ここでは、さらに高度な検索テクニックやディープフェイクの見分け方など、実践的なノウハウも紹介している。

AI時代の情報発信に必要なのは「人間のリテラシー」。古田氏の講演は、Web担当者にとって「情報を扱う責任」と「AIを使いこなす力」の両方と向き合うきっかけになるものだった。