インハウスSEOで意識していること

久々の更新は珍しく、インハウスSEOについて書いてみたいと思います。

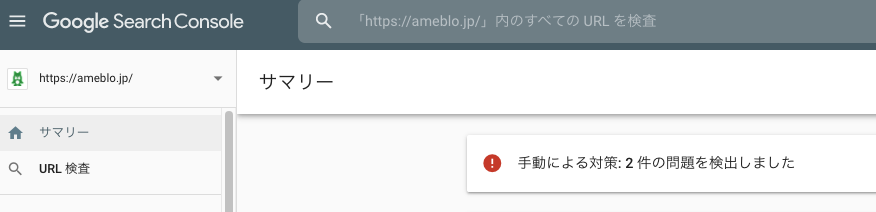

個人的にはアメブロやABEMAをはじめ本当に数多くのインハウスSEOを経験させてもらえました。

そのどれもが決して褒められた成果を出せず、SEOの成果が出せなかったからクローズさせてしまったサービスは10や20ではおさまらないと思います。

SEOという領域に全責任を持ち、サービス全体にも一定以上の責任を負う状態でクローズさせてしまった数としては間違いなく弊社で一番多いと思いますし、下手したら日本でも一番多いかもしれません。

そんな失敗だらけの私がインハウスにおいて大切だと思うことをいくつか記してみたいと思います。

これは、これから私と一緒にインハウスのSEOチームで活躍してくれる後輩たちへのメッセージでもありますので対象者は必ず読んでください笑

インハウスのSEOでは、SEOの知識や技術以上にプロデューサーやディレクターやエンジニアやデザイナーなどいろんな職種の人を巻き込んで、施策をすすめていく必要があります。

リソースを割いてもらうという意味では事業責任者とか役員とかの協力が必要なケースも多々あると思います。

特に弊社のメディアのインハウスSEOチームは多くても3名程度で動き、その先は各事業のリソースを使って進めていくので人を巻き込むということができないとただ座っているだけの人になります。

人を巻き込んでSEOを遂行していくには何よりもその事業やサービスの人との信頼関係を構築していかなければなりません。

私自身はとにかくここが苦手でして、それを先輩風と恐怖政治と酒で進めた過去があることは当時の被害者の方にここで謝罪させていただきます。。その節は誠に申し訳ありませんでした。

もちろんそんな無理矢理なやり方では、とんでもない効果でも出ない限りどこかで限界がきます。

そんな失敗を何度もして、インハウスSEOをやるうえで、特にインハウスSEOをしていくうえで信頼を得てチームを巻き込むために意識したほうが良いと思うことが自分の中で定まってきたので、いくつかご紹介します。

1.情報の発信をする

これは社内外に情報の発信をしていく必要があると思います。

よく現場で言われたのは「このブログにこう書いてあるからあなたの言うことは違うのではないか?」ということです。

私はあまり言われたことはないですが、メンバーはよく言われていました。

海外SEO情報ブログやウェブ担やSEO JapanやJADEさんのブログならまだしも、私が一度も見たことがないようなブログやいつの時代かわからない記事のURLが提示されたことが多々ありました。

インハウスをやって思ったことは「代理店事業でSEOサービス提供してたときは、なぜお客さんは改善提案を聞い入れてくれていたのだろう・・・」でした。

それは、“外の意見”というのは中の意見よりも権威性を感じやすいからではないか?と思うようになりました。

身近な専門家よりも遠くの専門家のほうが権威を感じやすいのではないかと思います。

そのため、社内だけでなく社外にも情報発信をし続けて最低限の権威性をつけておくとスムーズに施策を進められるように思います。

個人的には"他のブログにこう書いてある”と言われた、このブログに"提示している施策をやるべきだ!"って書いてやろうと何回かは思いました(笑

ちなみに最近はTwitterに「これはやったほうがいいかな」みたいなつぶやきをして、社内に話すと「Twitterに書いてあったやつですね」って言ってくれるようになっていて楽です。

2.施策の背景と展望を説明し見える化する

結構やりがちなのが、「このリンクをこうしてください」とか「このHTMLはこう変えてください」みたいにミクロな指示だけをお願いしてしまうことです。

当然エンジニアさんもデザイナーさんもみなさん作業屋さんではありません。その道もプロです。

プロのリソースは理由もなく借りられません。

全体的なSEOという絵の中のどの部分なのか?そして、なぜこの施策が必要なのか?なぜ効果が出そうなのか?を必ず説明する必要があると思います。

例えば、

「サイト内リンクを増やすと、クローラーがURLを発見する可能性が高まるので、こういう上位表示される可能性が高いページにはサイト内リンクを増やしたいのです。だから、こことこことここにリンク追加してほしいです」

みたいな感じです。

「こことこことここにリンク追加してほしいです」

とは天と地の差があると思います。

そして、その施策をやるとどのくらい最大で効果が見えるか数値化できると良いと思います。

コンテンツ追加なら、このコンテンツで半年後にどのくらい検索流入確保できる”可能性”があるか?それを示すだけでも変わってくると思います。

リソースをもらうというのはそういうことだと思います。SEOに限らずどんなアクションでも100%成果出ると保証できるなんてものがないことはみんなわかっているので、可能性で良いと思います。

自分は最小効果と最大効果予測を出していました。

最小 -1,000トラフィック/day 最大 +10,000トラフィック/day とか、時には"マイナスになるかもしれないけど賭けをしたい”みたいなお願いも結構やってきました。まあ、これはそういうのを受け入れてくれる文化が弊社にあったことがありがたかったですが。。

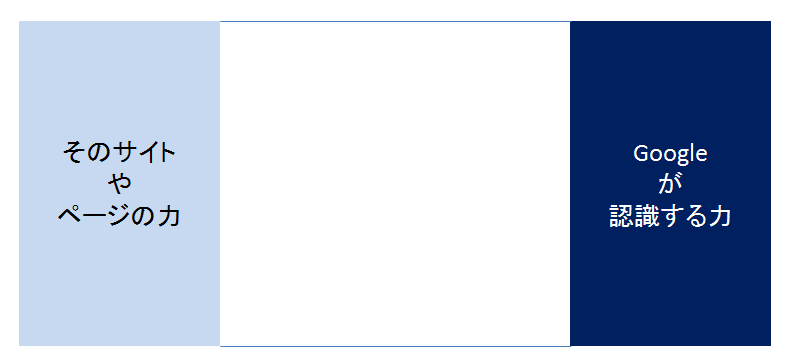

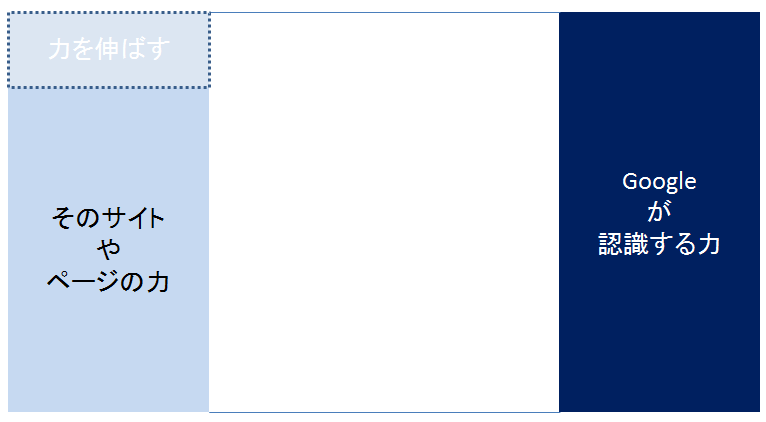

3.根拠を示す

この根拠とは「このブログがこう言っている」ではなく、

・データ的にこうなっている

・SEOが強い競合サイトがこれをやっている

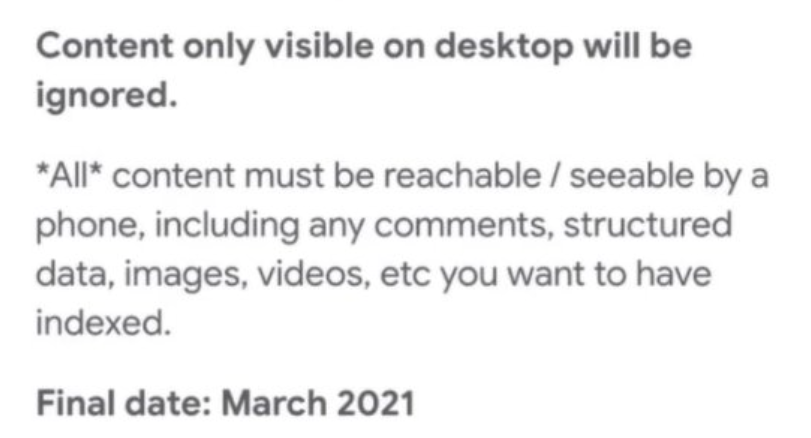

・Googleが発言や発表をしている

です。

海外のカンファレンスもバンバン行かせて頂いていたので、三番目があるのはありがたかったです。

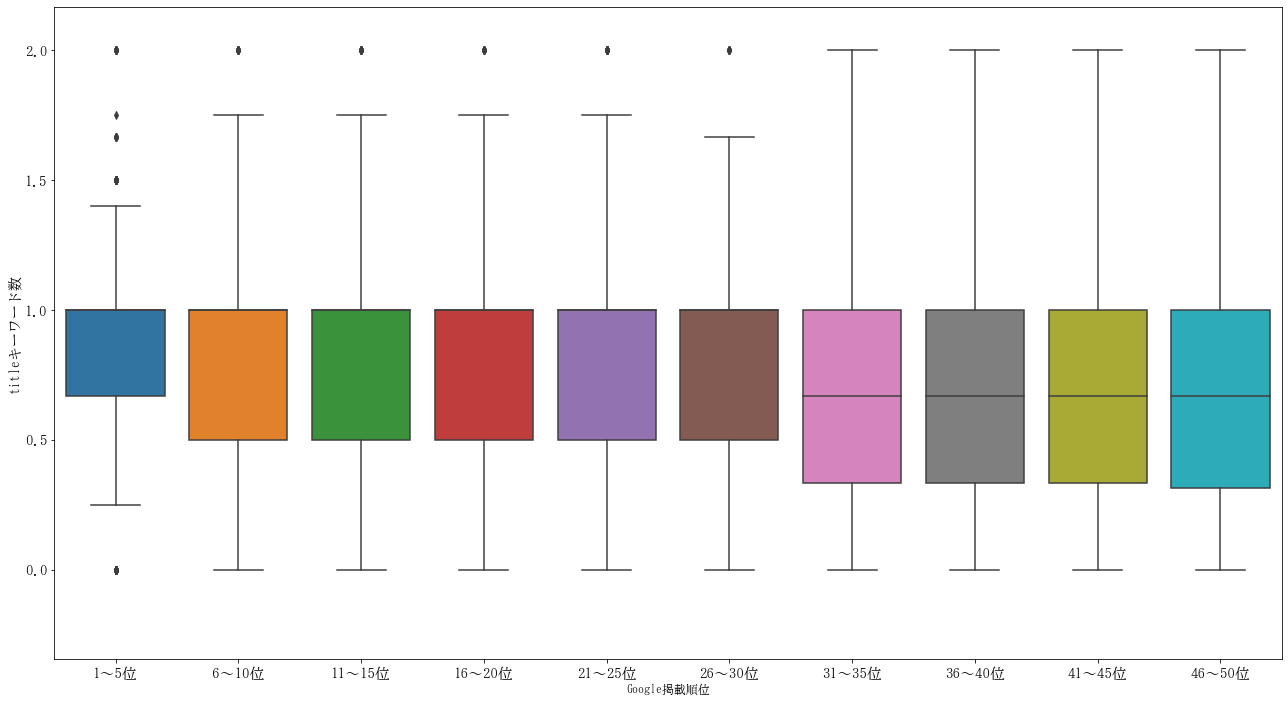

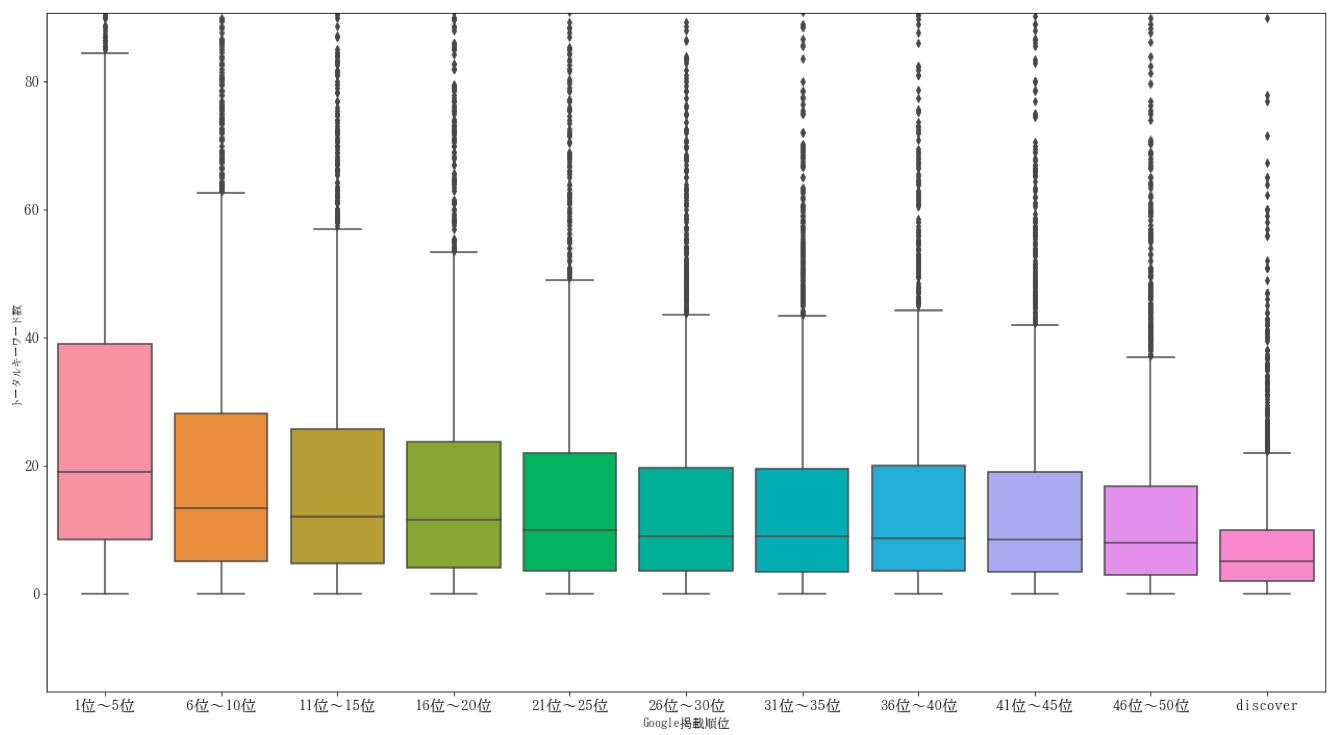

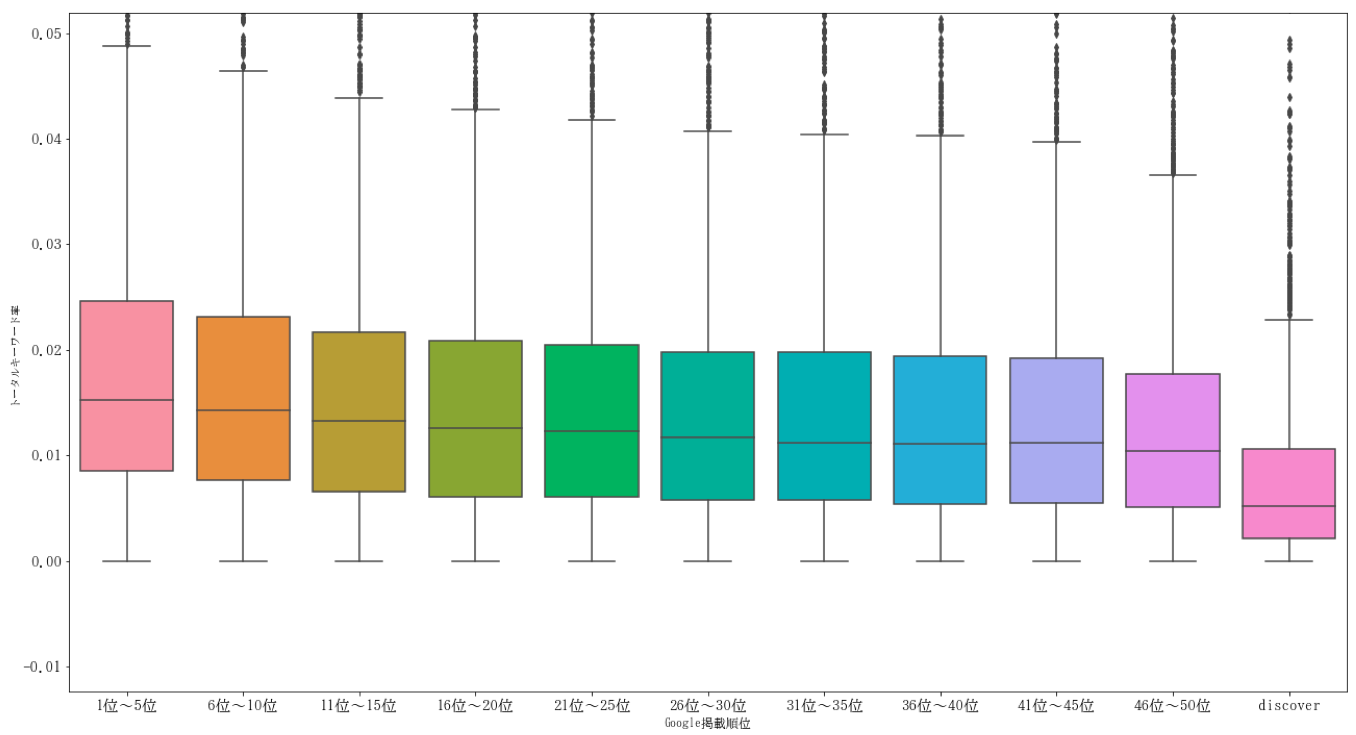

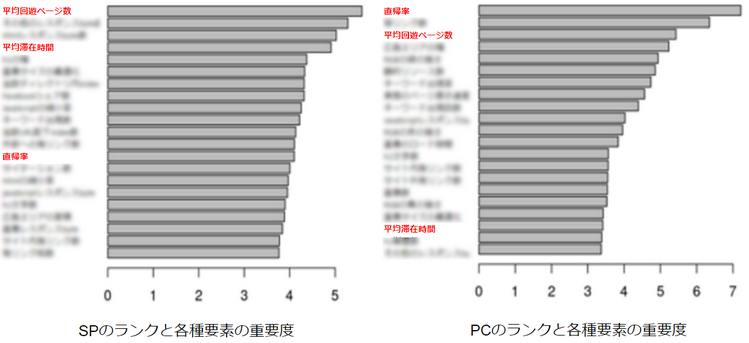

一番目は、セミナーで出すようなデータを出してお願いするような形をとっています。

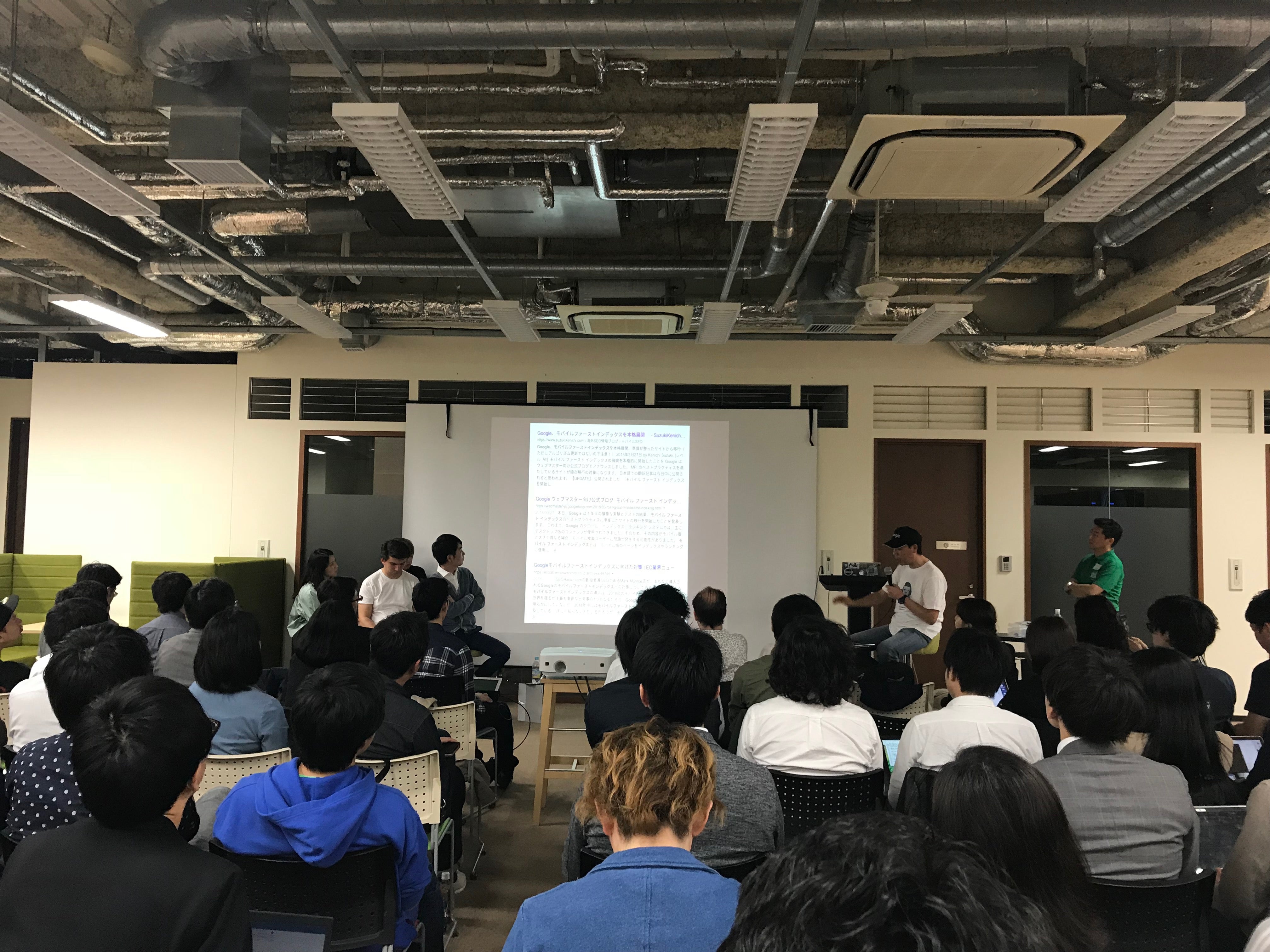

(2019年のPUBCONでのGoogle、Gary Illyes氏のセッション。セッション中に突然「Kimura-san」って名前呼ばれたのは良い思い出です)

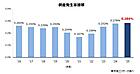

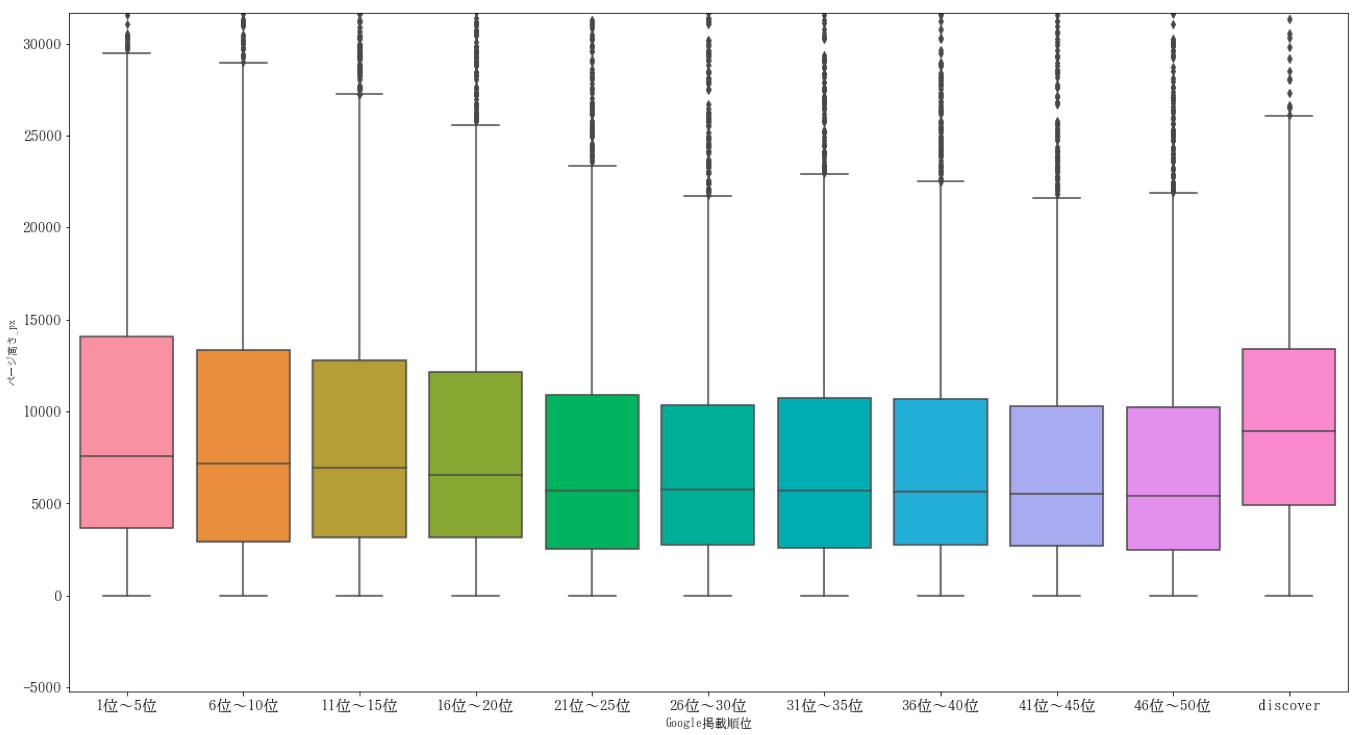

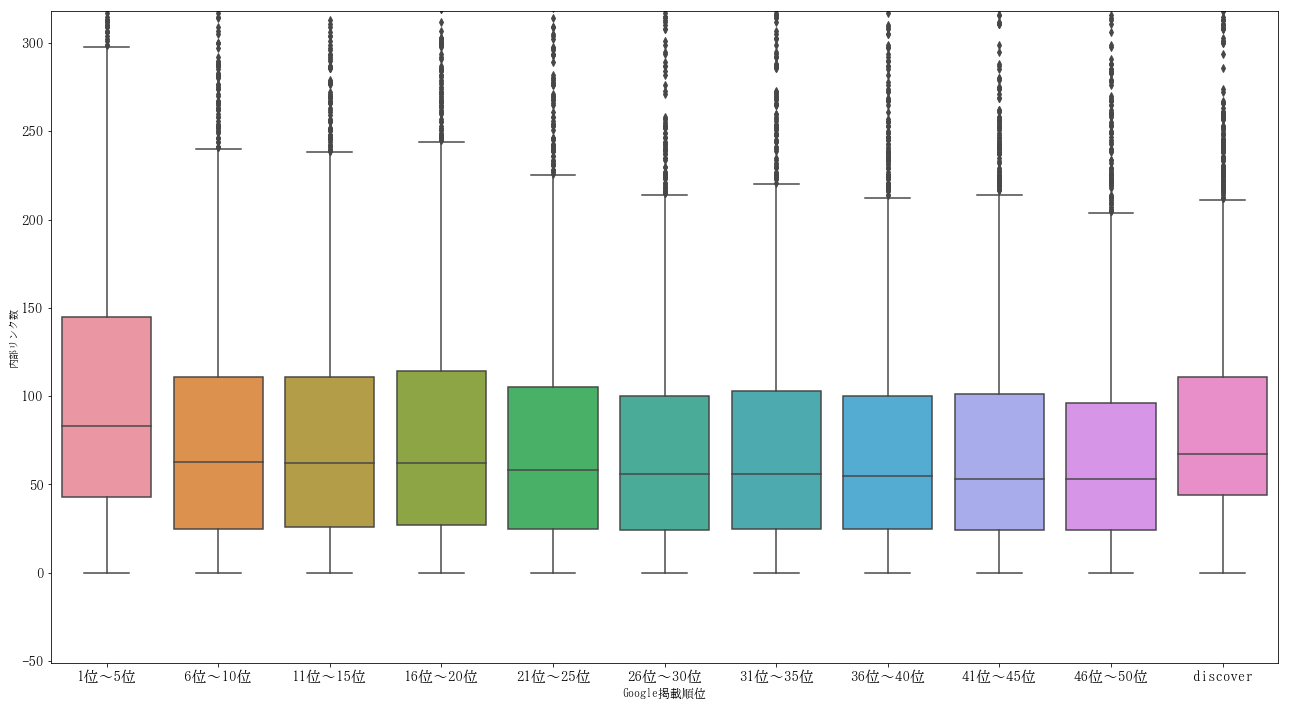

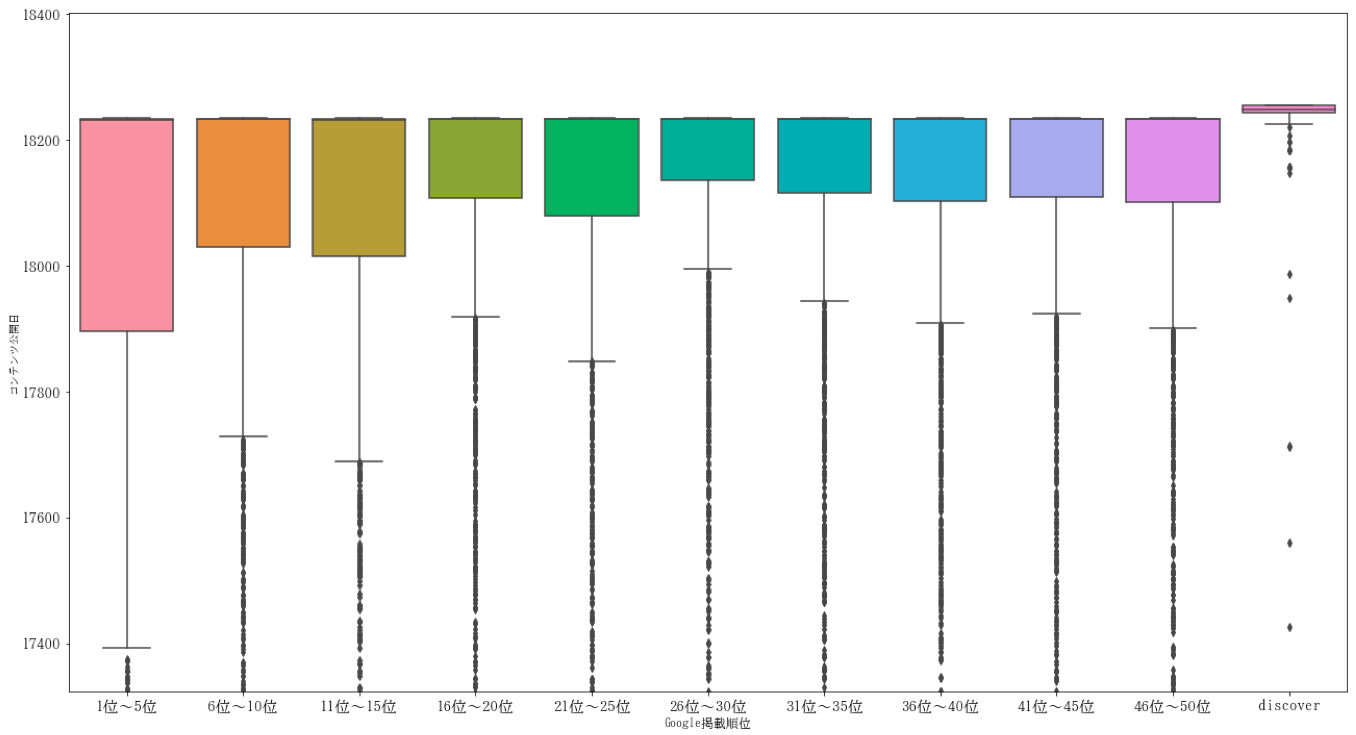

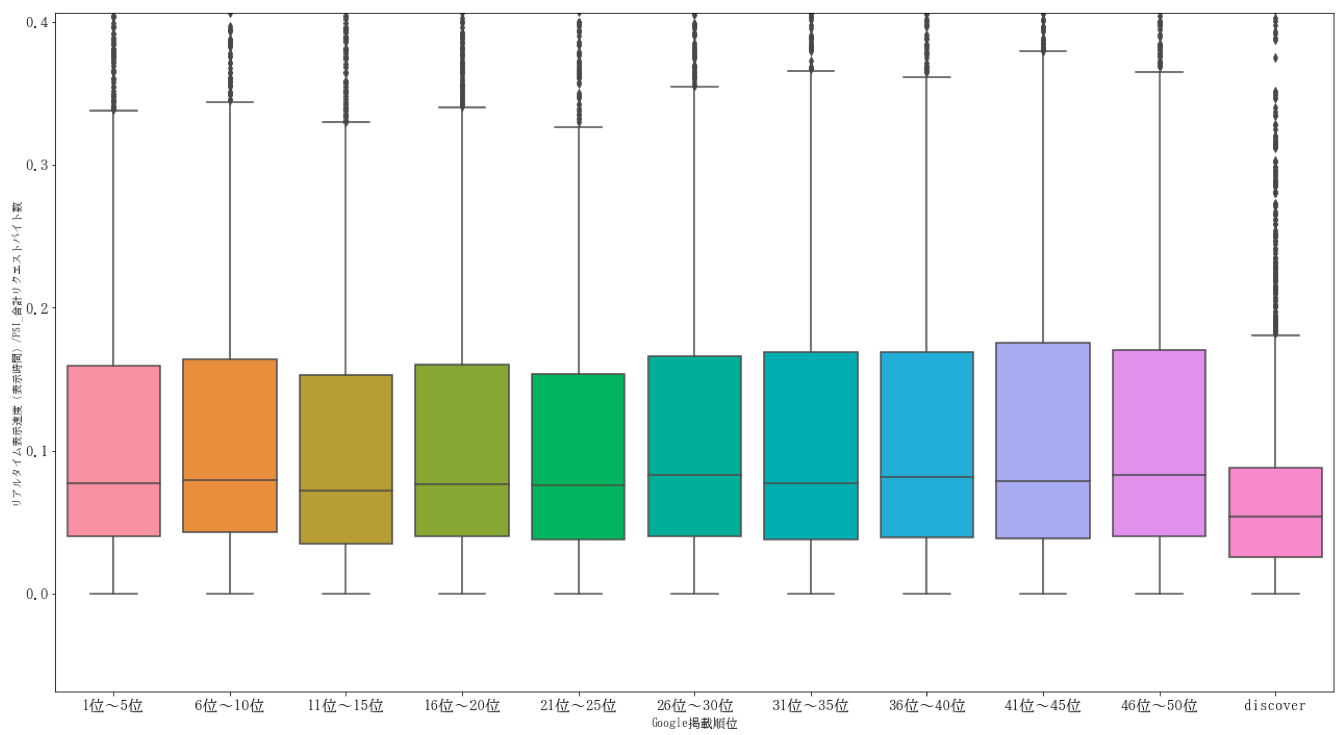

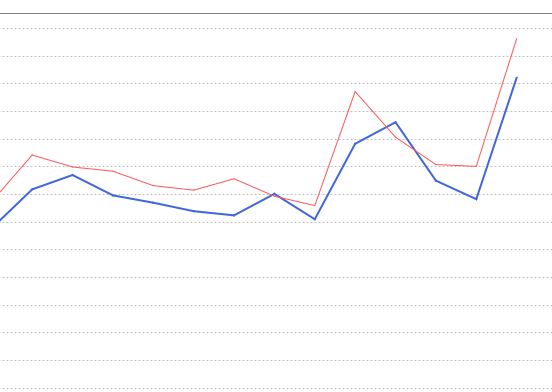

(文字数が多いほうが上位になる傾向が強いので、クロール優先度を高めるアルゴリズムを作るときに、"文字数という要素"を入れたいという話をするときなどに使う)

4.相手の手数を減らす

関係性が構築されるまでは相手の工数がなるべく少なくなるようなことを心がけると良いと思います。

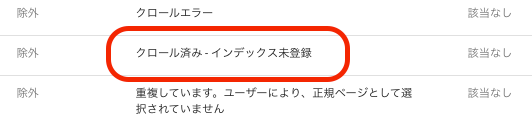

よく弊社はSEOの施策を導入するときに小規模なテストを行うのですが、その際にはなるべく”開発”が伴わないように心がけています。

さすがにアメブロなどは小規模テストでも1-2人日の開発が伴ってしまうことが多いですが、それ以外のサービスでは、例えば構造化データを入れて欲しい場合には、実際にJSON-LDを書いて渡す、クローラーをブロックしたいときは、「/hogehoge/以下をdisallowしてください」ではなくて、robots.txtに「Disallow: /hogehoge/*」を追加してください。とか、robots.txtファイルを渡してアップロードしてもらうほうが、スムーズなことが多いと思います。

もちろんその際も背景、理由・効果の予測は伝える必要があります。

関係性がちゃんとできたら、むしろ専門家におまかせにシフトしたほうが安全だと思います。

ちなみに、アメブロの依頼は現在では「このへんのURLブロックしといてー」レベルになっています。。すいません。。

5.小さい成功を積み重ねる

施策の順番は大きな効果が出るものからやりがちですが、大きな効果が出そうなものは効果がゼロかデカイかみたいなのが多々あると思います。

はじめからこれをやって成果が出ないと、そのあと施策を進めづらくなる可能性があります。

はじめてSEOを行うサービスは確実に成果が出そうなところから手をつけるほうがその後がやりやすくなることは言うまでもありません。

人が良いだけでは信頼されません。成果が出なければ組織で信頼を得ることは難しいのはなんでも同じだと思います。

6.成功の手柄は協力者

インハウスに異動して、とにかくここはすごく意識していました。

異動したてのときは、とにかくSEOが全然されていないサービスだらけだったのでダメダメなところを修正するだけで成果は出ていきました。

そのときは上司や事業責任者に「この人、このチームの動きが素晴らしかったから成果が出た」ということをとにかく伝えつづけました。

飲みの場でもいろんな人に、「この人のおかげで数字上がったわー。すごいわー。」と話していました。とある飲み会では、記憶が飛んだあとも、某チームを褒めまくっていてうざかったようですが、そのくらいに自分に染み付いていました。(もちろん心の底から感謝していましたし)

なお、自分のチームのメンバー褒められないという致命的な欠点が自分にはありまして、そこは本当にいままでのメンバーの皆さんには申し訳なく思うとともに、これから修正していきたいと思います。(単純に照れ臭いんです・・・)

あと、もちろん本人へのお礼の言葉は必須です。

7.検証と報告

やりっぱなしにならないこともインハウスSEOとして信頼を得るには非常に重要だと思います。

この施策をした結果こうなりました。というのは報告すべきです。

良い報告はもちろんですが、悪い報告もです。

施策を一緒にやってくれた人は多かれ少なかれその結果を気にしています。

仮に成果が出なくても、なぜ出なかったのかの仮説と、これを無駄にしない次のステップや展望を提示する必要はあると思います。

ちなみに弊社では、アメブロのSEOのオペレーションをやってくれている沖縄チームから何度も何度も成果がどうなのか?を聞かれました。

8.相談事項には必ず答えを出す

相談してもらえるようになれば、それはある程度信頼を得た証拠です。喜んで回答すべきです。

が、もちろん分からないこともあります。SEOや検索まわりで分からないことを「分からない」で返すことは絶対にしてはいけないと思います。

調べられるだけ調べて回答を出すべきです。

もちろん「Aという可能性とBという可能性がある」みたいなことはありますが、ゼロ回答は避けるべきです。

ゼロ回答をすると、もう質問や相談をしてくれなくなることは多々あると思います。

この1-8を繰り返して信頼の年輪を増やしていくことがインハウスのSEO担当者には重要なことになると思います。

SEOは不確定なことだというのはチームでやっていればいつか理解してくれると思います。

そうなれば「一回施策がうまくいかなかったら信頼を全部失う」みたいなのはないと思います。

とにかく日々信頼貯金をしていくことが大切かなと思います。

今一緒に仕事している人からしたら「いやいや、あんたそんなことできていないよ」って言うのはあるかもしれませんが、今回は自戒をこめてということでご容赦ください。

番外編.人と人として仲良くなる

最後はこれですね。信頼とかではなく、ただ仲良くなる。

アメブロのSEOはいつも、アメブロのフロントのリードエンジニアの@herablogと一緒にやることが多いです。

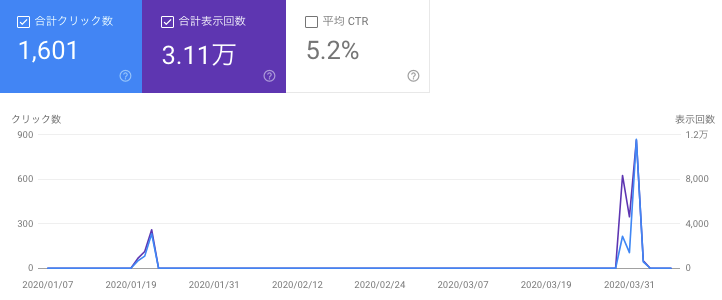

小規模にいろいろと面白い実験をしたりしています。実は、この記事もその実験のためだったりします。

実験できる状況を2ヶ月くらい放置し続けましたが、彼がときどきしてくるTwitterのファボに無言のプレッシャーを感じてこの記事を書きました(笑

そのくらい人と人との関係ができるとスムーズにことが進むのは確かですが、その前には上記1-8を意識すると良いのかなと個人的に思っています。

なお、彼とは何度もマウンテンビューに出張に言っていますが、毎回ホテルの私の部屋で飲み明かし、翌朝「木村さん、昨夜話したこと(どうやら結構大事な組織課題っぽい話のよう・・・)覚えてます?」って言われて「うーん、なんとなく」って二日酔いの頭をかかえて答えてましたが全部嘘です。一度も覚えていません。すいません!

仕事の大事な話はシラフのときにしましょう!これも大事!