Answer engine optimization:最適化すべき6つのAIモデル

この記事は、2025年 3月 25日に Search Engine Land で公開された Bruce Clay氏の「Answer engine optimization: 6 AI models you should optimize for」翻訳したものです。

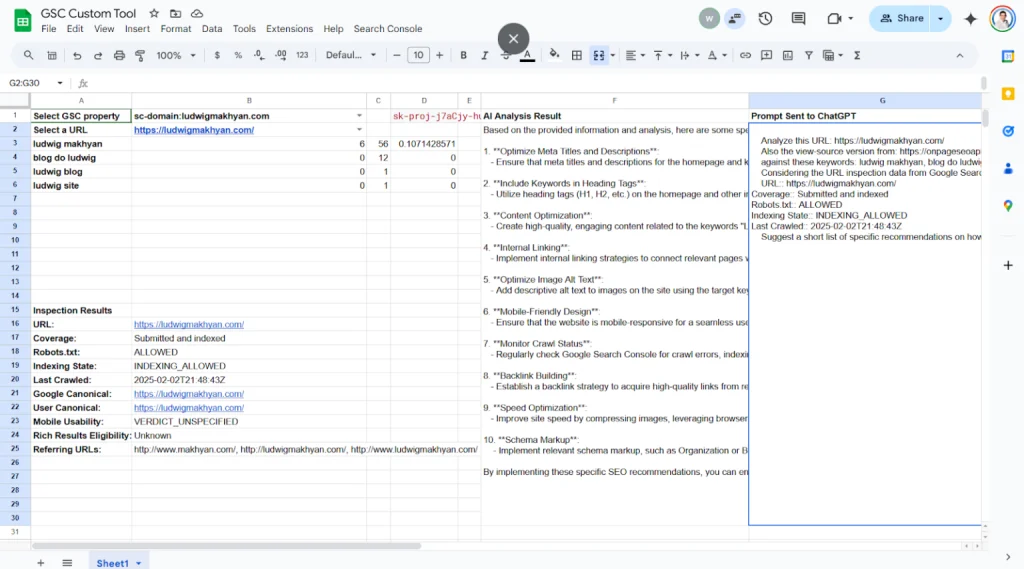

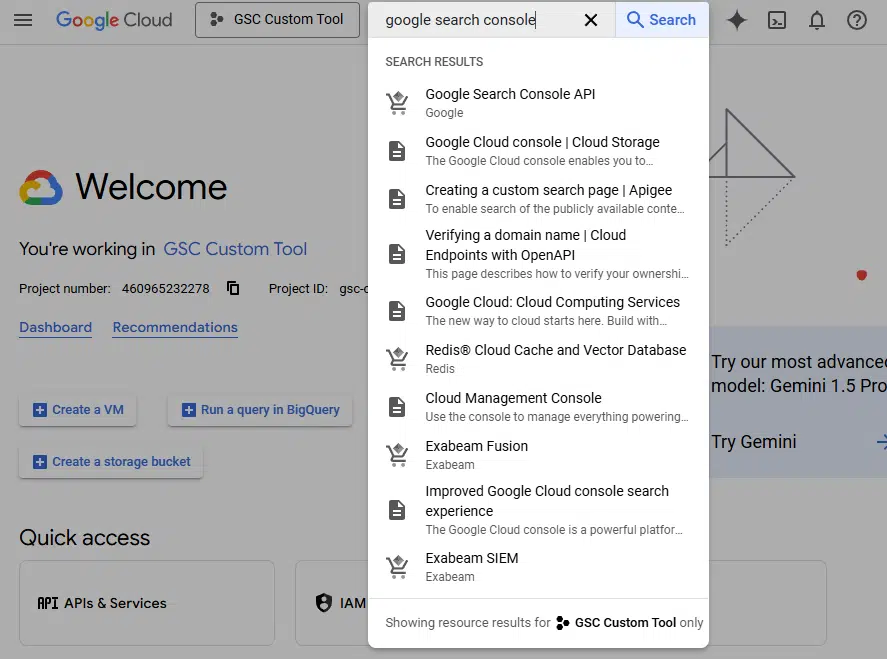

この記事で分かるAI検索6モデルの特徴・仕組み

| AIモデル名 | 特徴 | 仕組み(見解) |

|---|---|---|

| Google AI Overview | 検索上部にAI要約を表示し、検索体験を変革 | Google検索上位10〜20位の情報をもとに、Geminiが回答を生成している可能性が高い |

| Google AI Mode | 検索画面全体をAI応答中心に切り替える新機能 | クエリ・ファンアウト技術で複数ソースを並列検索・統合し、詳細な応答を提示 |

| Google Gemini | Google検索やAI製品群の中核を担う大規模モデル | Google検索結果やAP通信など外部ソース、ユーザー履歴をもとにパーソナライズされた回答を生成 |

| Bing Copilot | Bingに統合された対話型AI検索 | GPT-4ベースのPrometheusモデル+リアルタイムのBing検索結果を統合して回答を生成 |

| ChatGPT検索 | ChatGPTにリアルタイム検索機能を組み込んだ新体験 | Bing検索+提携コンテンツを活用し、GPT-4oで文脈を加味した応答を生成 |

| Perplexity AI | 出典を明記した簡潔な回答に特化したAI検索 | 独自クローラーでWeb全体を収集し、信頼ソースを優先して即時要約・回答を提示 |

Google AI OverviewやChatGPT検索など、注目すべき6つのAI検索について、それぞれがどのようにコンテンツを取得しているのか、そしてそれがSEOにどのような影響を及ぼすのかを探ります。

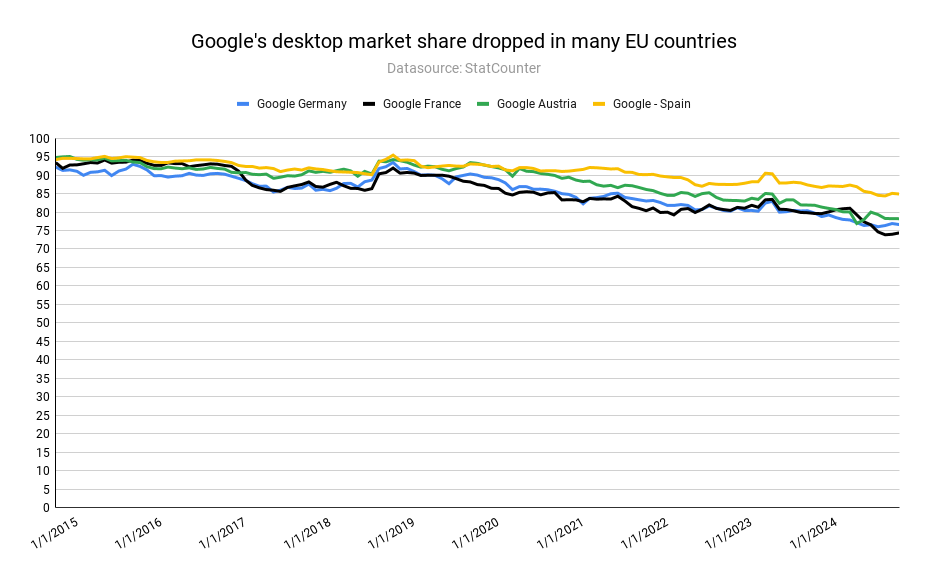

AIを活用した検索技術は、私たちの情報の探し方を根本から変えつつあります。長年にわたって、GoogleやMicrosoft Bingでの検索順位は、検索における可視性の基盤となってきました。

しかし、AIを活用した検索が普及していくなかで、順位の優先度は変化していくのでしょうか?

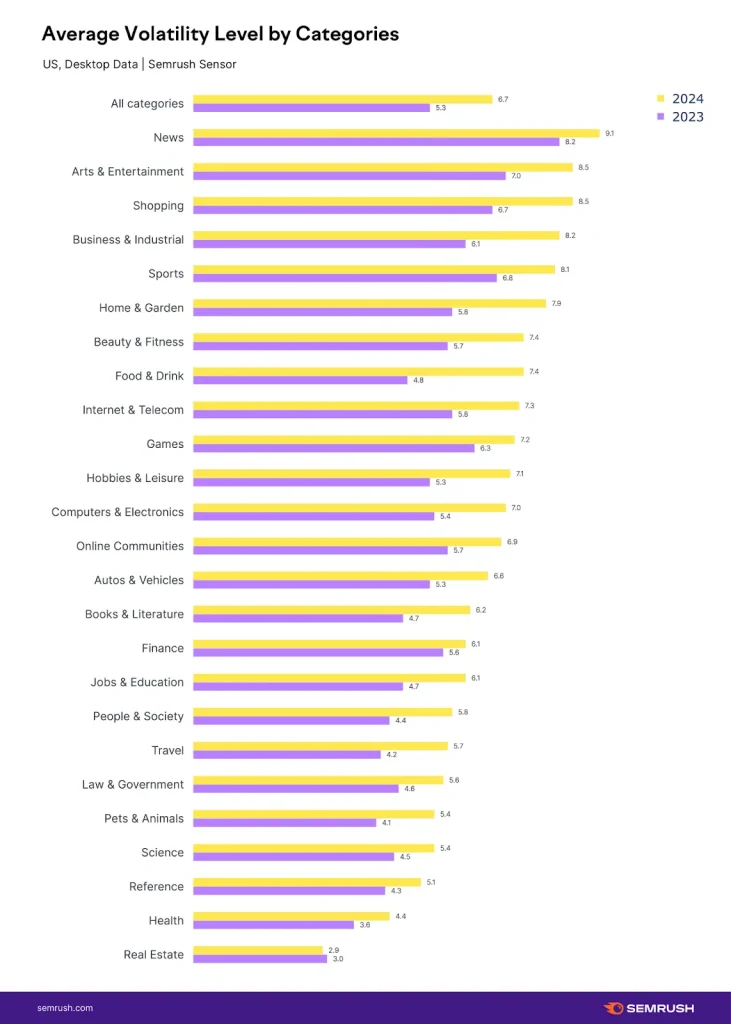

検索エンジンが関連性を重視、評価していたSEOの初期時代とは違い、私たちは今、AIとSEOが混在した不安定な時代にいると思います。

どのAI回答エンジンが勝者となるかは、今後の展開を見守るしかありません。SEOが依然として重要であることに変わりはありませんが、AIは確実に、その「ルール」を書き換えようとしています。

この記事では、以下の内容を詳しく解説します。

- 注目すべき6つのAI検索プレイヤーと、それぞれのコンテンツ取得の方法

- ユーザーの検索行動がどこへ向かっているかを示す市場シェアと利用傾向

- AI回答エンジンが、いまだに従来の検索エンジンに依存している理由

- 企業が今すぐ始めるべき、AI活用型検索に向けた最適化アクション

AIモデルとリアルタイム検索

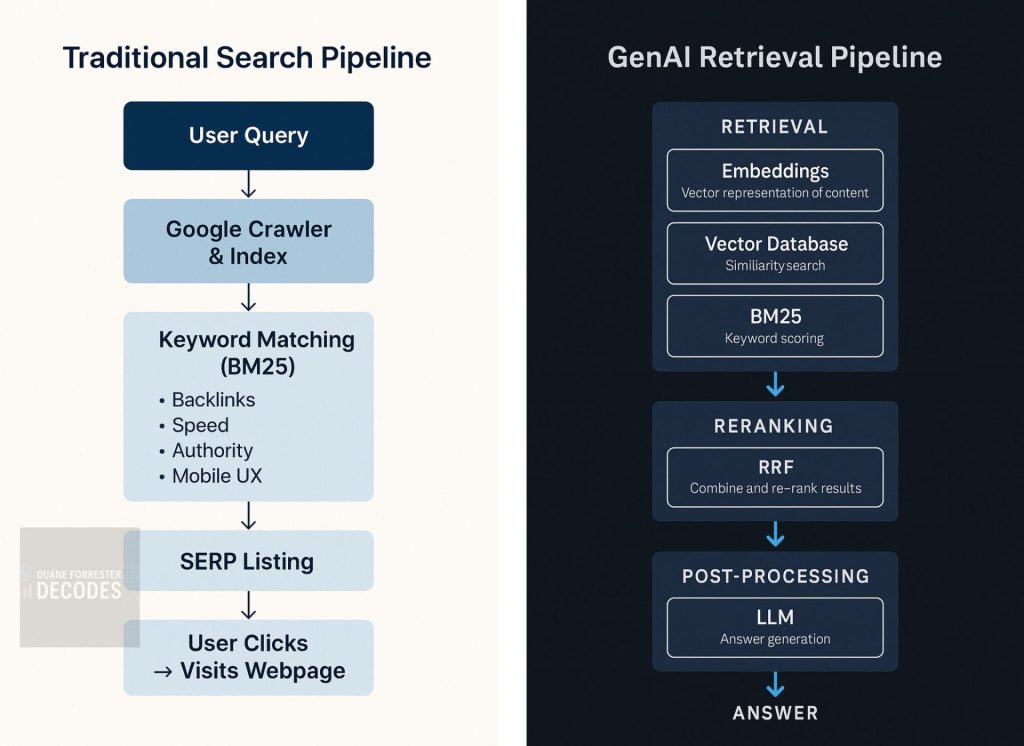

本題に入る前に、AIプラットフォームがどのように動作しているかを簡単に見ておきましょう。AIモデルは、それぞれ特定の時点までに収集されたデータをもとに学習されています。

たとえば、GoogleのGemini 2.0 Proは、2024年8月までの知識で学習されており、一方、OpenAIのGPT-4oは2024年6月まで延長したデータでトレーニングされています。こうした情報は日々更新される可能性があります。

したがって、最近の出来事やトレンドに関する質問では、モデル内部の情報だけでは足りません。AIはリアルタイムにウェブからデータを取得し直し、その場で要約を生成します。

つまり、AIがどれだけ正確かつ最新の情報を提示できるかは、ウェブから新しいデータを取得し、それを適切に処理する能力にかかっているのです。ここが非常に重要なポイントです。

また注目すべき点として、AI検索エンジンが独自のWebインデックスを構築できるようになってきていることが挙げられます。

たとえば、Perplexity AIの「PerplexityBot」は、GoogleやBingのインデックスに依存せず、独自にウェブをクロールしてデータベースを作成しています。それでもなお、多くのAI検索エンジンは、従来型検索エンジンの検索結果を活用しており、実際にそれに依存しているのが現状です。

ウェブサイトの管理者が、これらのクローラーによるコンテンツ取得を制限したい場合は、robots.txtの設定によってアクセス管理を行うことができます。

それではここから、AI検索エンジンが現代のSEOにどう関わってくるのかについて、さまざまな角度から見ていきましょう。

Google:AI Overview

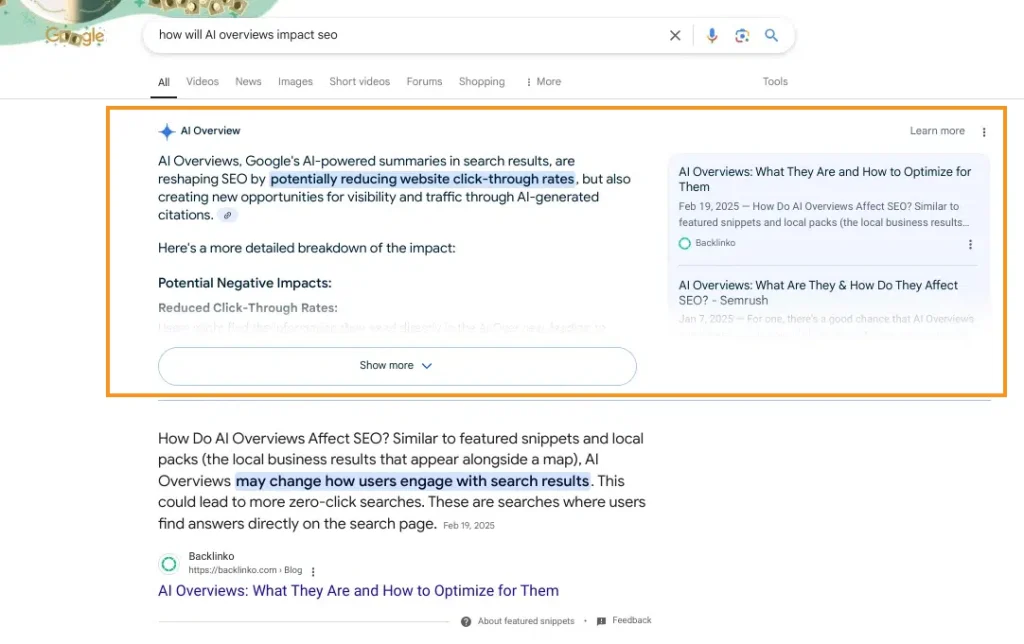

AI Overviewは、Google検索に大きな変化をもたらしました。

GoogleのGemini AIモデルを活用して生成されるこのAI回答は、複数の情報源からデータを取得し、迅速かつ包括的な回答を提供するよう設計されています。

SEOの専門家にとって、これはチャンスであると同時に、新たな課題も意味します。

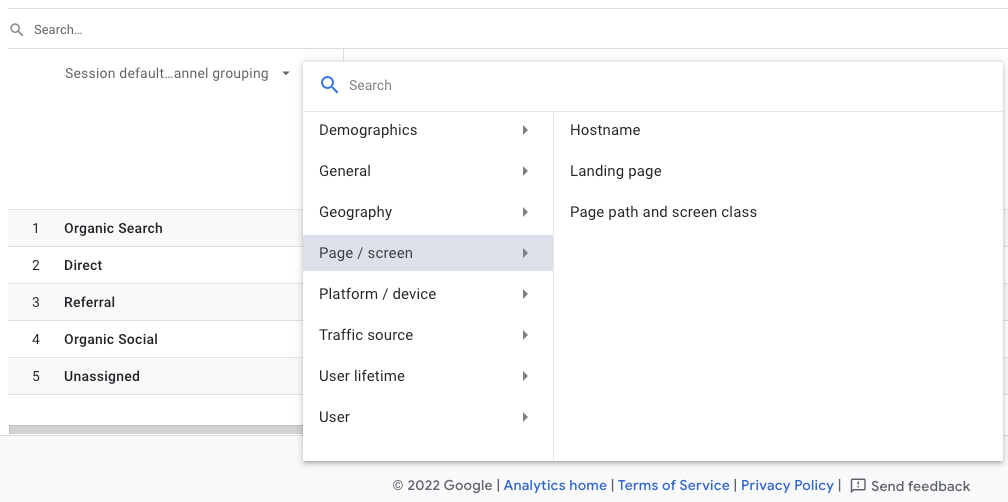

AI OverviewはGoogleの検索インデックスをもとに表示内容を決定しますが、同時にユーザーが検索結果をどう扱うかという行動そのものにも変化を与えています。

AI Overviewの仕組み

GoogleのGemini 2.0 AIモデルは、特定の検索クエリに対する概要を即座に生成するためにAI Overviewを支えています。

このAIが生成した回答は、Googleの検索結果ページの最上部、しばしば従来のオーガニック検索結果よりも前に表示されます。

市場シェアと導入状況

Googleは依然として検索市場を圧倒しており、米国内のシェアは約87.28%を占めています。

1日あたり数十億件にのぼる検索の中で、AI Overviewはオーガニック検索のトラフィックやユーザー行動に大きな影響を及ぼし始めています。

SEOにとっての意味

Googleでの上位表示は今も変わらず重要です。というのも、AI Overviewは基本的に検索結果から情報を取得しているからです。

Rich Sanger氏とAuthoritasの調査によると、AI Overviewに引用される情報の46%は、オーガニック検索結果の上位10件からのものでした。

私自身のSEO代理店での経験では、AI Overviewに取り上げられるには検索順位で上位20位以内に入っている必要があるという印象があります。ただし例外もあり、AI Overviewで引用されているサイトの中には、そもそもランキング上には現れないようなものも存在します。

AI Overviewに取り上げられると、引用元へのクリックが増える傾向があり、特に取引意図のあるクエリではその傾向が顕著です。こちら(Adi Srikanth氏のAIOがWebトラフィックに与える影響を探る)の調査では、トランザクショナルクエリ(何かをしたいという取引型のクエリ)においてAI Overviewに引用されたページのクリック数は、引用されなかったページの約3.2倍に達していました。情報検索クエリの場合でも、約1.5倍の差が見られました。

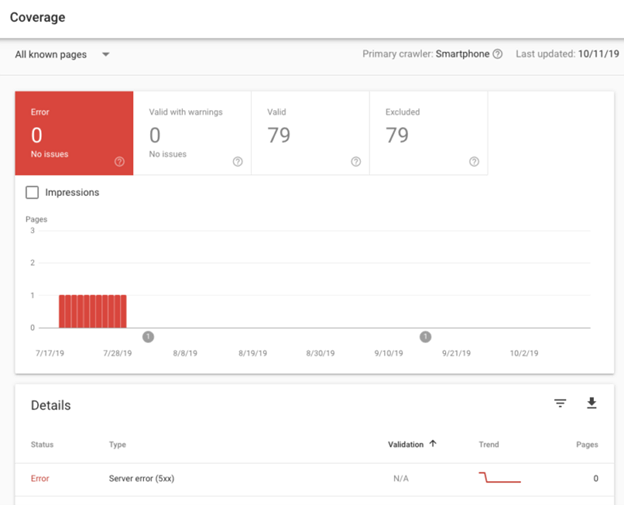

一方で、コンテンツがGoogleで上位表示されていなければ、AI Overviewに表示される可能性は極めて低いため、従来以上に堅実なSEO対策が求められます。成功のための具体的な方法については諸説ありますが、私としては、テクニカルSEO、ページ内最適化、そして優れたコンテンツ制作をバランスよく組み合わせた堅実なSEO施策を、ブレずに継続することを強く推奨します。

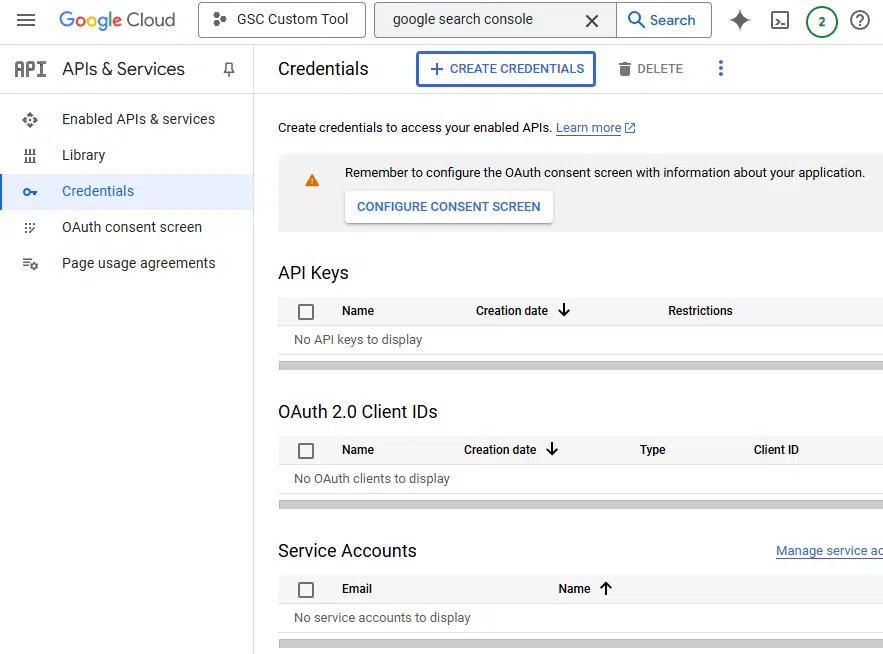

なお、ウェブサイト管理者は、自分のサイトの情報が AI 生成回答に利用されるかどうかを制御できます。

たとえば「Google-Extended」をrobots.txtでブロックするように記述できますが、これを行うことでGoogleがGeminiなどのAIモデルがあなたのサイトを学習や回答生成に使うことを禁止できます。この設定をしてもGoogleの検索ランキングには影響しませんが、Geminiが生成するAI回答であなたのコンテンツが使われることはなくなります。

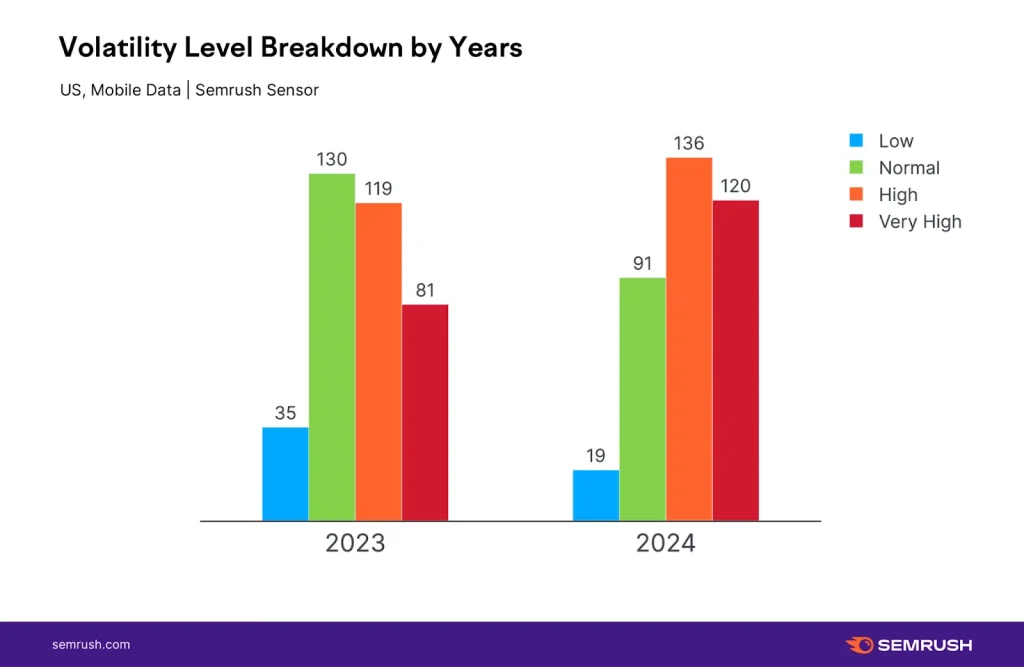

注意点:AI Overviewへの掲載状況は、従来のオーガニック検索よりも変動しやすい傾向があるという調査結果も出ています。

まとめ:AI Overviewは、従来の検索結果を完全に置き換えるものではありませんが、ユーザーが検索結果をどのように利用するかに大きな変化をもたらしています。

現時点では、SEOの基本方針は変わりません。Google検索に最適化されたコンテンツは、AI Overviewにも取り上げられやすくなるという点を押さえておくと良いでしょう。

Google:AIモード(AI Mode)

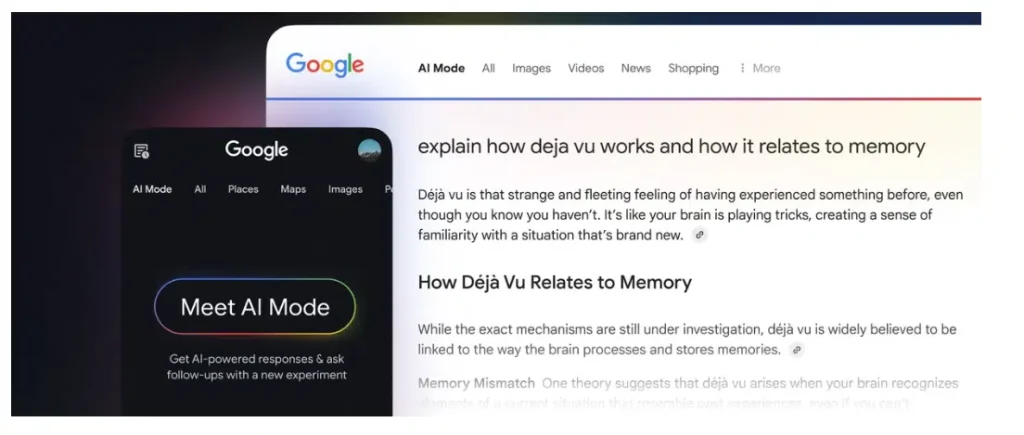

2025年3月、Googleは、よりAIを活用した検索体験を提供するための新たなオプション機能として「AIモード(AI Mode)」を発表しました。

このAIモードは、標準のGoogle検索における「AI Overview」とは異なり、検索画面全体をAIが生成した応答中心のインターフェースに切り替えるというものです。

つまり、オーガニック検索結果の横にAIの回答が表示される従来型とは異なり、ユーザーはAIによる説明を中心とした検索体験へと移行できるのです。

AIモードの仕組み

AIモードは、より詳細かつ会話的で、視覚的にも強化された回答を提供する、Google検索における新たなオプション機能です。Bingの「Copilotトグル」に似た構造で、従来の検索結果に代わって、AIが生成した応答を中心に据えた検索体験へと切り替えることができます。

GoogleはこのAIモードについて、「高度な生成AIモデルと、Googleが誇る情報システムを統合したものであり、検索体験の中に直接組み込まれています。高品質なウェブコンテンツへのアクセスに加えて、ナレッジグラフや実世界のファクト、数十億点におよぶ商品データなど、リアルタイムな情報源も活用しています。さらに『クエリ・ファンアウト』(query fan-out)技術を使い、関連する複数のサブトピックとデータソースにわたって同時に検索を実行し、それらの結果を統合してわかりやすく整理された回答を提示します」と説明しています(上記の発表リンク)。

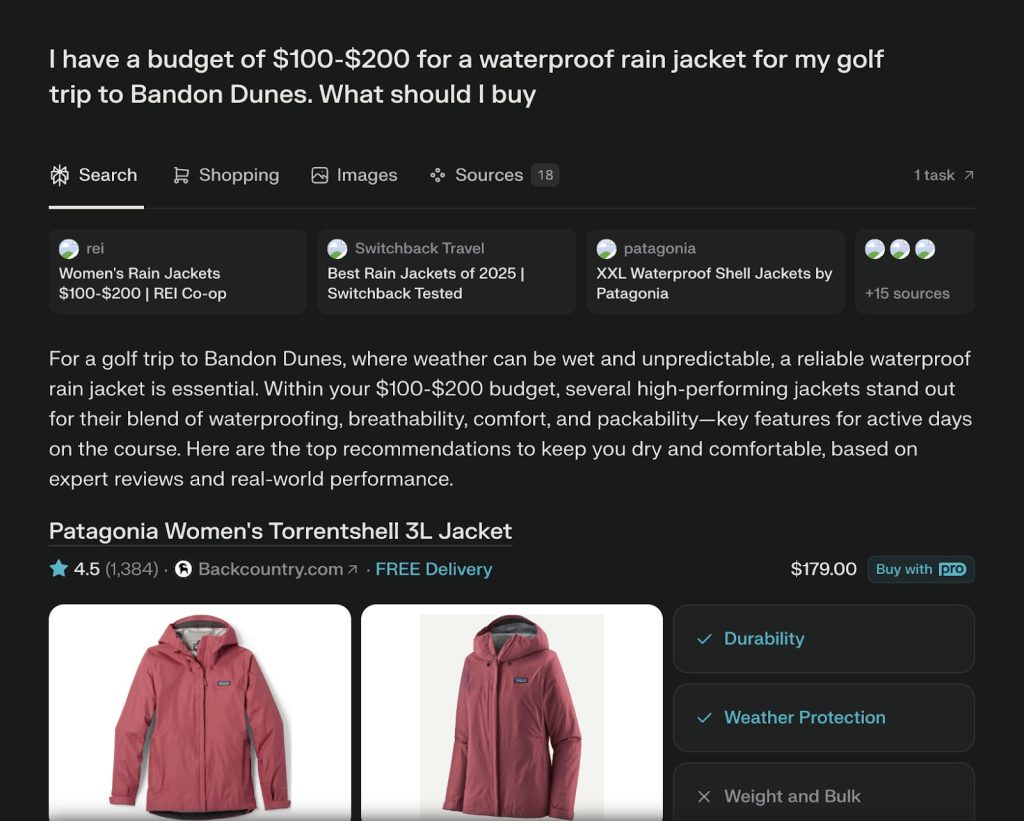

Search Engine Land によれば、Googleは「AIモードもAI Overview同様、ユーザーが関連情報やアクションにつながるコンテンツを見つけやすくするため、応答の中に関連リンクを表示します。どのタイミングでリンクを挿入するかについては、AIモデルが学習を重ねています」と述べています。たとえば、ユーザーがチケット予約などの具体的なアクションを起こす可能性がある場合には、リンクが積極的に表示されます。また、ハウツー系の検索では、画像や動画など視覚的な情報を優先的に提示する判断も行います。

SEOへの影響とは

GoogleはAIモードについて、「我々の根本にある品質・ランキングシステムに基づいており、モデルの推論能力を活用した新たなアプローチにより、回答の正確性を高めています。可能な限りAIによる回答を提示したいと考えていますが、有用性や品質に十分な自信が持てない場合は、従来のウェブ検索結果を提示します」と説明しています。

現在、AIモードはテスト段階にあり、AI Overviewのようにクリック率(CTR)にどのような影響を与えるかについては、まだ明らかになっていません。

まとめ:検索の進化とSEOの基本

AIモードの登場は、検索体験がAI主導型へと本格的に移行しつつある兆候です。とはいえ、少なくとも現時点では、従来の検索における上位表示が依然として非常に重要であると考えられます。

さらに深掘り│GoogleのAIモード:SEO担当者・マーケターが知っておくべき要点

Google: Gemini

Google’s AI Mode: Here’s what matters for SEOs and marketers

Geminiは、ChatGPTや他の生成AIツールに対するGoogleの競合プロダクトです。独立したチャットボットとして提供されるだけでなく、Google検索におけるAIオーバービューの基盤としても機能しています。

Googleは今後数か月をかけて、スマートフォンからスマートホームガジェットに至るまで、あらゆるアシスタント対応デバイスにGeminiを展開し、デフォルトのAIアシスタントとして統一していく方針です。

この動きは、検索とユーザーインタラクションの中核にAIを据えるという、Googleの長期的な戦略を象徴するものです。

Geminiの仕組み

Geminiは、Google検索結果と、AP通信などのサードパーティのコンテンツパートナーから情報を取得し、それらを統合して回答を生成します。検索ランキング情報もそのまま応答に組み込まれるため、ユーザーは単なる生成回答以上に、検索精度の高い情報に触れられる仕組みです。

また、Geminiはユーザーの検索履歴、YouTubeの視聴履歴、アプリの使用状況などをもとに応答をパーソナライズすることが可能です。これにより、従来の「クエリに対して一律の回答を返す検索体験」から、「ユーザー個別の関心や行動履歴に最適化された応答」へと進化しています。

市場シェアと利用実績

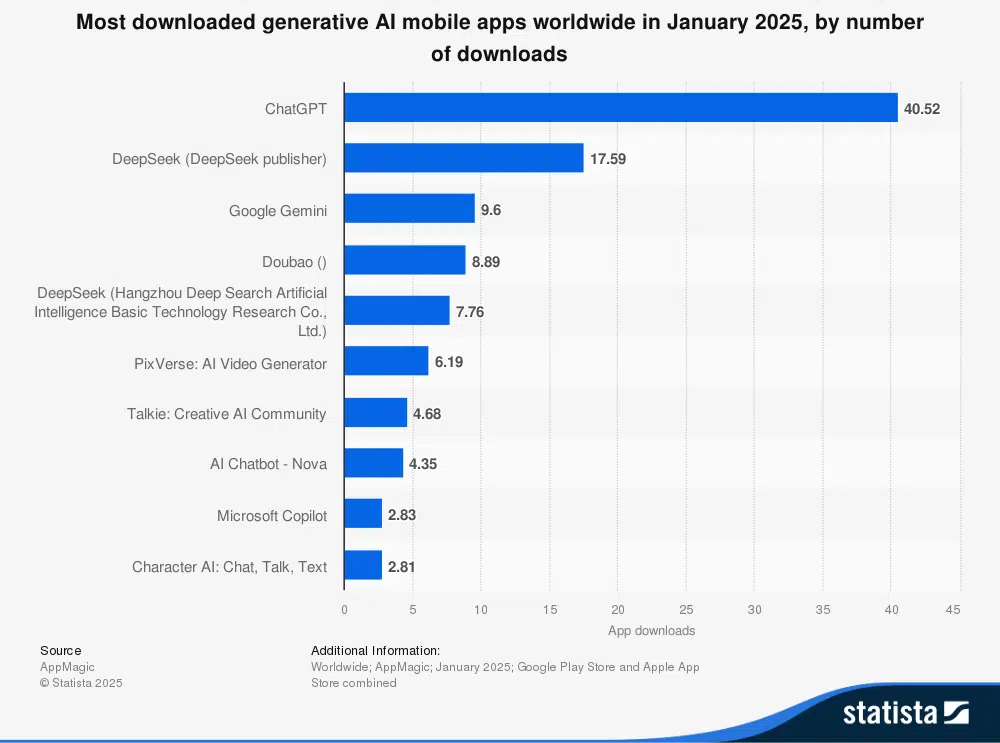

Statistaの調査によると、Geminiは2025年1月時点で約900万件のダウンロードを記録し、世界で3番目に多くダウンロードされたAIアプリとなっています。

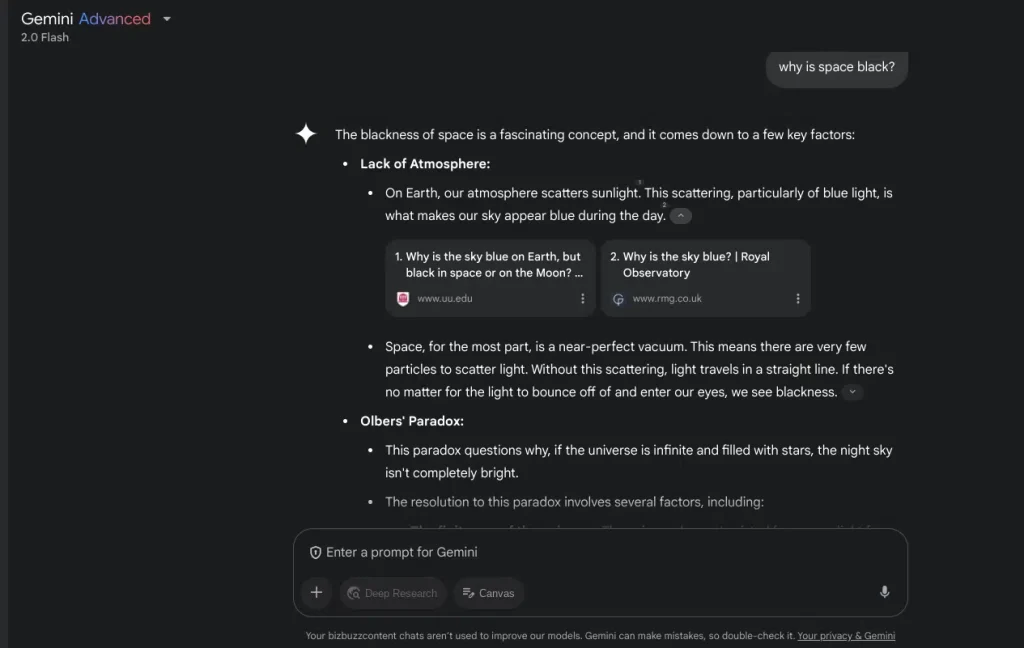

またSimilarwebのデータによれば、主なユーザー層は25〜34歳が約30%と最多で、続いて18〜24歳が約21%となっており、Z世代〜ミレニアル世代が中心であることが分かります。

SEOにとってこれが意味すること

Google検索でのランキングは今なお重要ですが、それだけではありません。GeminiはGoogleの検索インデックスだけでなく、コンテンツパートナーシップからのデータも活用しています。

そのため、自然言語のクエリに最適化されたコンテンツ、コンテキストを補完するための構造化データ、「教えること」を主眼とした教育的コンテンツの重要性が高まっています。

また、Geminiはユーザーの履歴に基づいて回答をパーソナライズするため、同じ質問であってもユーザーごとに表示内容が異なる可能性があります。たとえば、あるユーザーが特定ブランドのYouTubeチャンネルを頻繁に視聴している場合、Geminiはそのブランドのコンテンツを引用したり、関連づけたりする傾向が強くなります。

さらに、Geminiは常に直接リンクを提示するわけではないため、クリック率(CTR)は不確実です。ある調査によると、参照トラフィックの量において、GeminiはChatGPTやPerplexityに次いで第3位とされています。

まとめ:

Geminiでの可視性を高めるには、Google検索で上位を獲得できる質の高いサイトを運営するという基本は変わりません。ただし、GeminiのAIによるパーソナライゼーションと会話型検索の進化が加わることで、対策にはより高い複雑性が求められます。

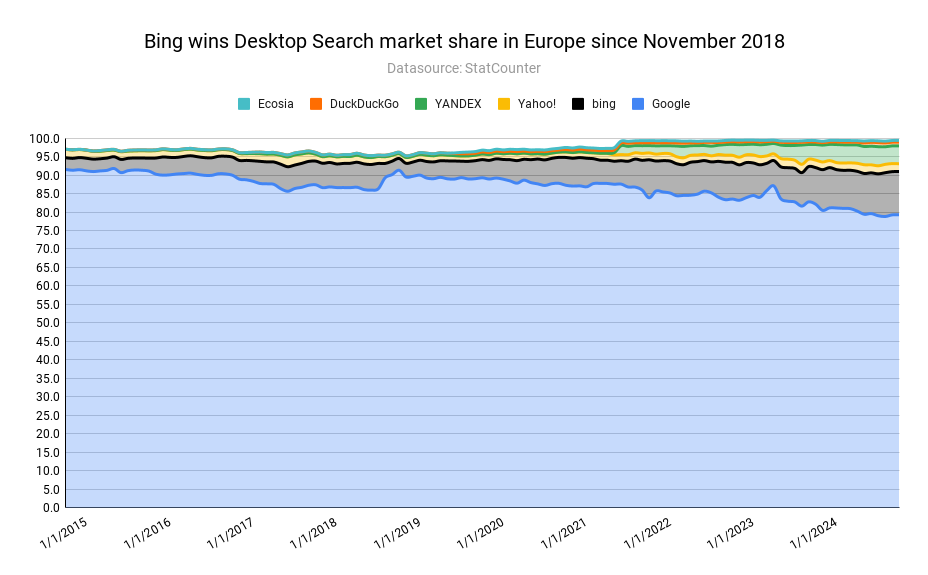

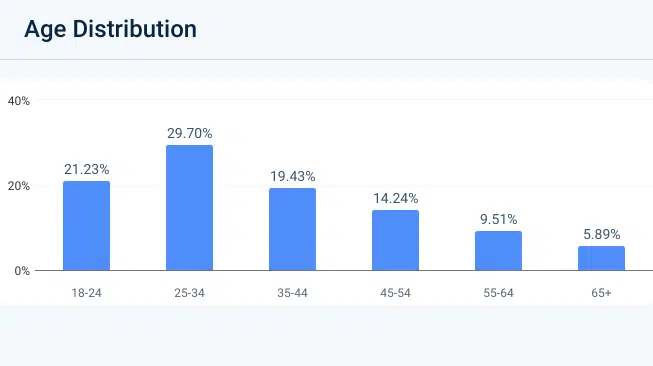

マイクロソフト:Bing Copilot

Bingは、検索結果にAIを直接統合した最初の大手検索エンジンであり、2023年2月に「Bing Copilot」(旧称:Bing Chat)をリリースしました。Microsoftは2019年からOpenAIに多額の投資を行っており、その成果として、AI検索においてGoogleよりも先行した形になります。この展開は、今後の検索エンジン市場における勢力図に影響を与える可能性があります。

Bing Copilotの仕組み

MicrosoftのPrometheusモデル(OpenAIのGPT-4を基に構築)を使用しています。

リアルタイムのBing検索結果と外部データソースに基づいてAIサマリーを生成します。

AIによる回答は、従来のウェブページ一覧よりも上位に表示されることがあります。

「ディープサーチ」をクリックすると、より詳細なAI回答が得られ、これにはウェブ上の情報源へのリンクも含まれます。

また、BingにはCopilotトグルがあり、よりインタラクティブで高度なAI検索モードを選択できます。

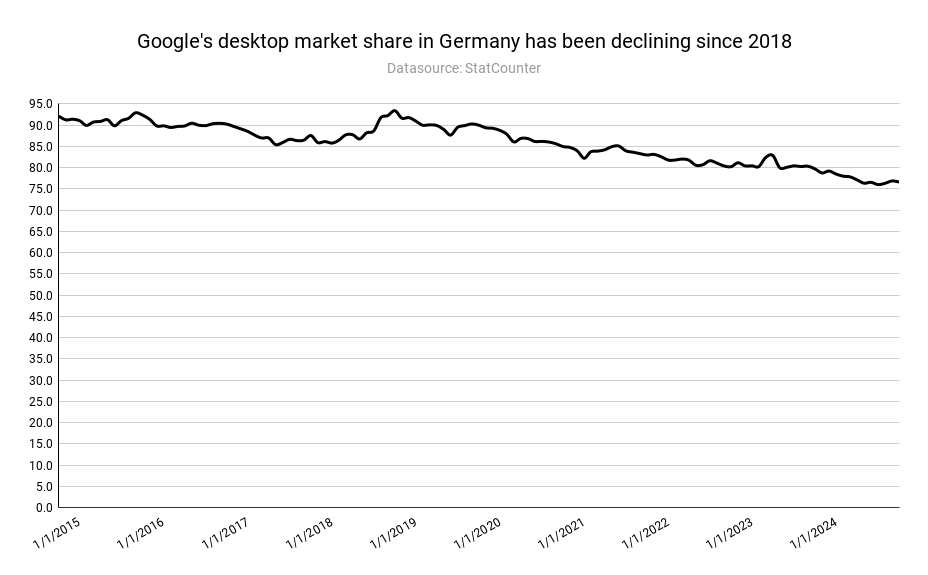

市場シェアと採用状況

Bingは米国の検索市場の約 7.48% を占めています。

Googleと比べると規模は小さいものの、AIを活用した検索を早期に導入したことや、他の AI プラットフォームがBingの結果に依存していることから、Bingの市場シェアは今後さらに拡大する可能性があります。

SEOにとってこれが意味すること

GoogleのAI Overviewとは異なり、Bing Copilotは必ずしも検索上位のコンテンツだけを参照するわけではありません。とはいえ、上位表示されているページの方が引用されやすい傾向は明確に存在します。

Rich Sanger氏の調査によると、Bing Copilotに引用されるURLの70%以上が、Bing検索の上位20位以内に入っているとされます。

AI検索機能の普及に伴い、Bing経由でのトラフィック獲得チャンスは確実に拡大しています。

まとめ:

これまではGoogle対策がSEOの中心でしたが、BingのAI化と他社ツールへの影響力の高さを踏まえると、Bingはもはや「ついでの対策対象」ではなくなりつつあります。今後は、Bingのアルゴリズム特性を理解し、Googleとは異なる視点でSEO戦略を設計することが求められるでしょう。

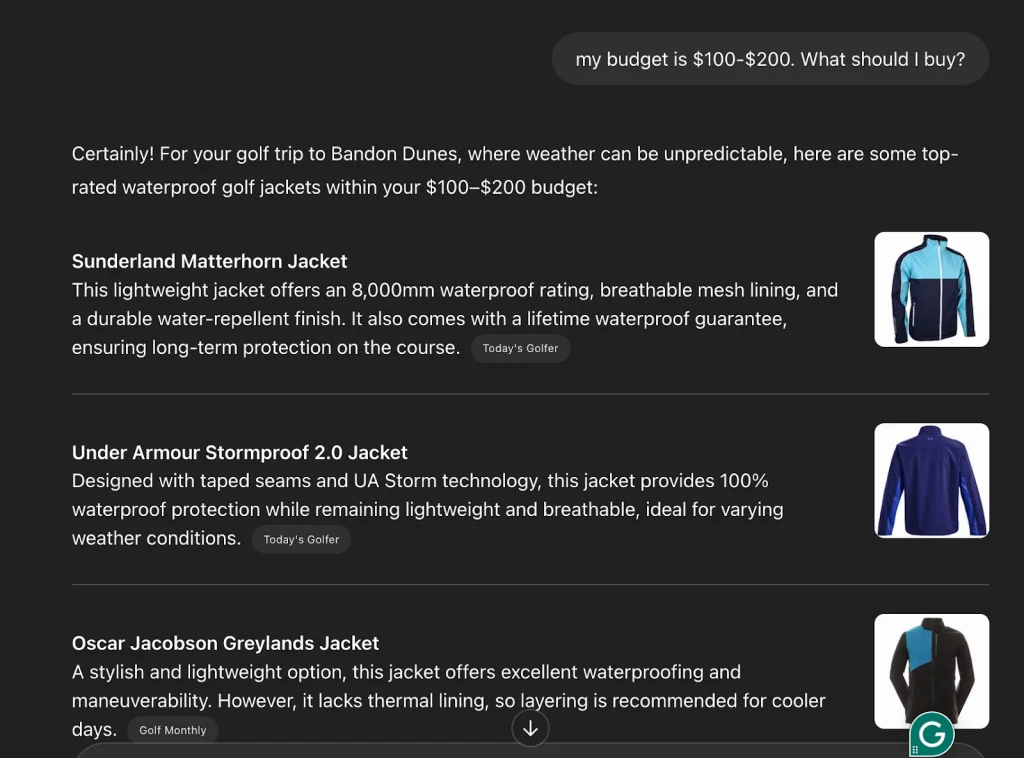

OpenAI:ChatGPT検索

ChatGPT検索は、AIを活用したリアルタイムWeb検索機能をChatGPTに統合することで、従来の検索体験を強化しようとするOpenAIの取り組みです。

この機能は当初、「SearchGPT」プロトタイプとして2024年半ばにリリースされ、後にChatGPTに統合されました。これにより、ユーザーは事前学習された知識だけでなく、ライブ検索機能を利用できるようになりました。

2024年10月までに、OpenAIはSearchGPTをChatGPTに完全に統合し、リアルタイムのWeb検索を実行できるようにしました。これにより、ユーザーのクエリに対して、より新しい情報源に基づいた回答を提供できるようになったのです。

この統合により、ChatGPT検索は従来の検索エンジンの直接的な競合としての位置づけを強め、GoogleやBingといったプラットフォームに代わる、AIを活用した新たな検索手段をユーザーに提供できるようになりました。

しかし問題は、依然として既存の検索エンジンの結果に依存しているという点です。

ChatGPT検索の仕組み

ChatGPT検索には、GPT-4oの微調整バージョンが搭載されています。このモデルは、合成データ生成技術を用いて事後学習が行われており、その一環としてOpenAIの「o1-previewモデル」からの出力の抽出が含まれています。つまり、すべての応答がWebから直接取得されているわけではなく、一部の回答はAIによって合成されたものとなっています。

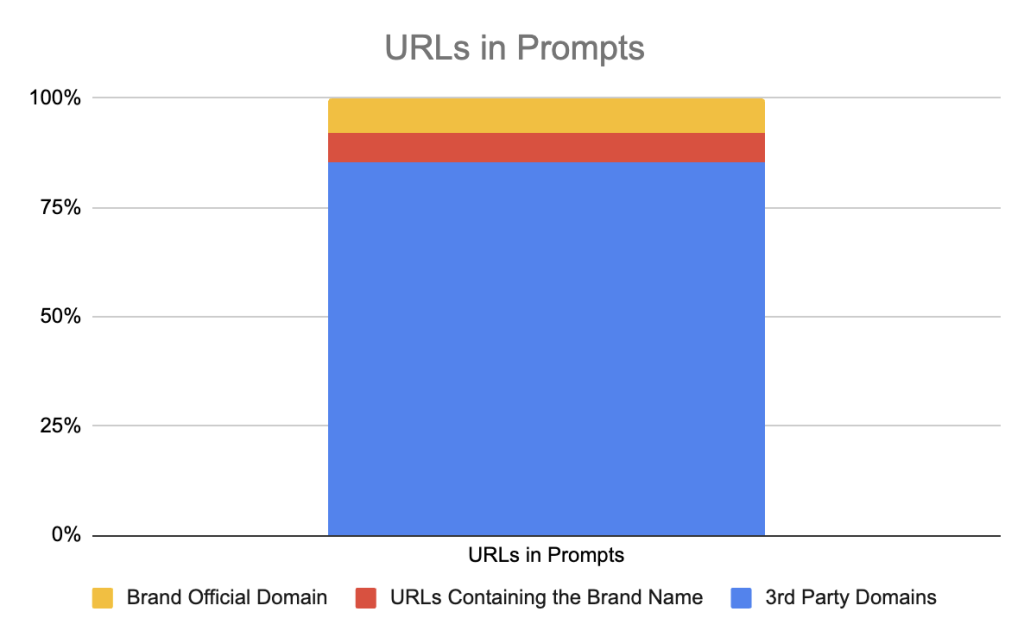

SearchGPTは、Bingなどのサードパーティ検索プロバイダーだけでなく、独自の情報を提供するコンテンツパートナーシップからもデータを取得しています。これにより、複数の情報源を活用した回答が生成される仕組みとなっています。

市場シェアと導入状況

ChatGPTは、現在最も広く利用されているテキスト生成AIツールです。Statistaのデータによると、2023年には、ChatGPTが世界の生成AIユーザーシェアの約20%を占めていました。

TechCrunchの報道によると、ChatGPTの週間アクティブユーザー数はわずか6か月で2倍に増加し、現在では4億人以上のユーザーがその検索機能を利用しているとされています。

SEOにとってこれが何を意味するか

SearchGPTは、Bingのインデックスに依存しているため、WebコンテンツがBingにおいてインデックスされ、上位表示されるように最適化することが今後のSEO戦略において重要です。Bingにインデックスされていないコンテンツは、SearchGPTの応答として取り上げられる可能性が低くなります。

SEO業界では、SearchGPTがBing内で信頼性の高い上位ランクの情報源を優先する一方で、Bingの上位ランク外の情報源も取り入れているといった見解が広まっています。

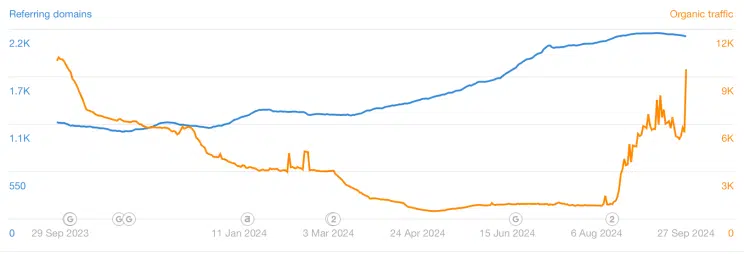

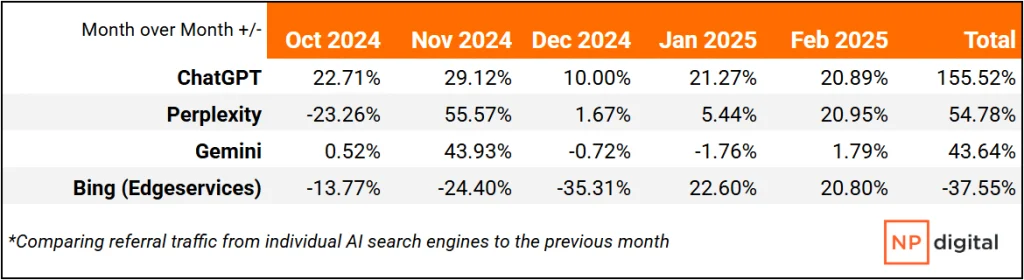

SearchGPTによる回答には、クリック可能な情報ソースが含まれることもあり、これがWebサイトへのトラフィックを生み出す可能性があります。実際に、中小企業391社のウェブサイトを対象に行われたトラフィック分析によると、ChatGPTによる参照トラフィックは2024年9月から2025年2月にかけて123%増加しており、この期間中、AI駆動型検索エンジンの中で最も多くの参照トラフィックを生み出したプラットフォームとなりました。さらに、ChatGPTは教育系やテクノロジー系のWebサイトに対するトラフィック誘導の増加にも貢献しており、2024年11月までには、3万を超えるユニークドメインが参照トラフィックを受け取ると見込まれています。

ChatGPTの会話形式による情報提供は、ユーザーの検索行動や情報の受け取り方を大きく変えつつあります。今後も「役立つコンテンツ」を重視することで、Webサイトの競争力は確実に高まるでしょう。

一方で、SEO初期と同様に、ChatGPTを利用した検索も操作に対して脆弱であることがテストによって明らかになっています。そのため、誤解を招くような結果や、偏った情報が表示されるリスクもある点には注意が必要です。

まとめ:ChatGPTは、検索エンジンの未来にとって最大の脅威となり得る存在です。ただし、SearchGPTがBingに依存している以上、AIが生成する検索結果でも上位に表示される可能性を高めるためには、Bingでの最適化を優先することが不可欠です。

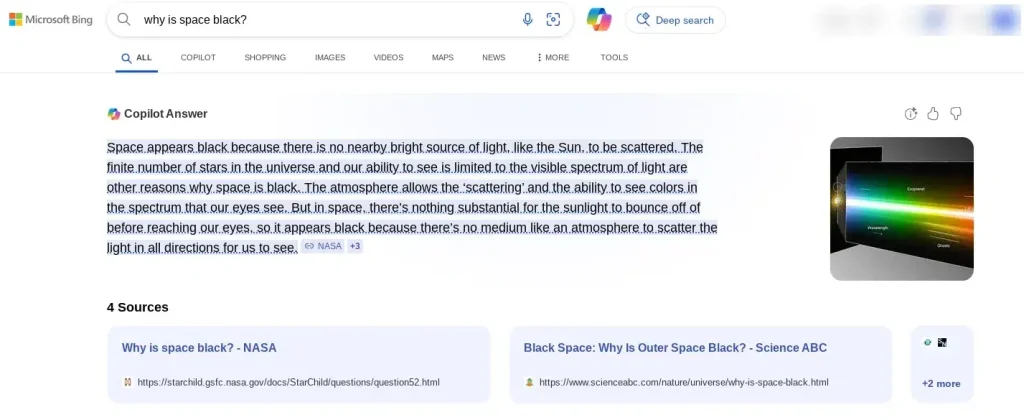

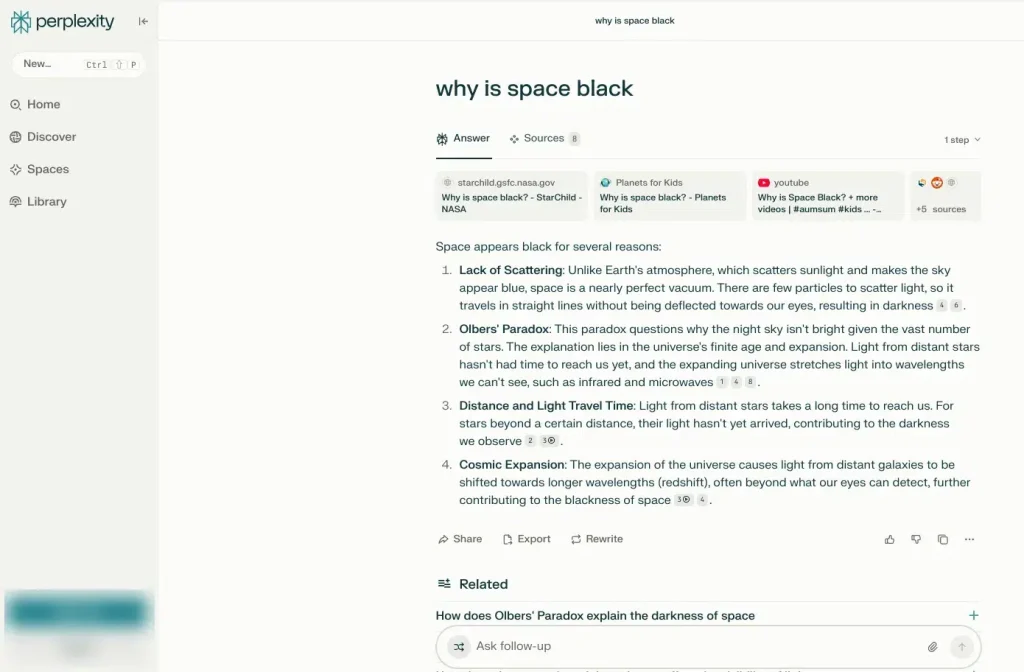

Perplexity AI

Perplexity AIは、大規模言語モデルとリアルタイムのWebデータを組み合わせ、出典付きで簡潔な AI 回答を提供する独立系のAI検索エンジンです。

その最大の特長は、「引用(ソース)」にあります。

Perplexityの創設者Aravind Srinivas氏は、Lex Fridman氏とのインタビューで次のように述べています。

初めて論文を書いた際、共著の先輩から「論文内の主張はすべて引用で裏付けるべきだ」と教わりました。それは、他の査読済み論文か、自分の実験データに基づくものでなければならないという意味です。引用がない主張は、単なる意見に過ぎないのです。

「これは単純な原則ですが、“正しいことしか言えなくなる”という点で非常に本質的です。」

私たちはこの原則を踏まえ、「チャットボットを正確にする最善の方法は、インターネット上で確認でき、かつ複数の情報源から裏付けがとれる情報しか言えないようにすることだ」と考えました。

2022年後半にサービスを開始し、現在ではGoogleなどの従来型検索エンジンの代替、あるいは競合として注目を集めています。

Perplexity AIの仕組み

Perplexityは、独自の検索インフラを構築しており、Web全体をクロールしてリアルタイムに情報をインデックス化。ユーザーの検索クエリに対して、AIが即時に回答を生成します。

Googleのように全Webページを網羅するのではなく、ユーザー行動に基づき「検索頻度が高く、信頼性の高い」情報を優先的にインデックス化。これにより効率性と正確性を両立しています。

全ての回答にはソースへのリンクが付いており、出典を明記しない従来のチャットボットとは一線を画しています。

市場シェアと普及状況

2024年初頭時点で、Perplexityは月間アクティブユーザー数が1,500万人に達したと報告されています。

市場全体ではまだ規模は小さいものの、AI検索市場の約6%を占めるまでに成長しています。

また、ジェフ・ベゾスやNVIDIAなどの著名な投資家の支援を受け、評価額はわずか1年足らずで5億ドルから90億ドルへと急騰しました。

SEOにとってこれが何を意味するか

Perplexityが重視しているのは、「Web上の信頼できる情報源」です。つまり、自社サイトが権威性のあるWebメディアとして認識されることが、可視性を確保するうえで不可欠です。

ある調査では、Perplexityが参照している情報の約60%が、Google検索の上位10件と一致していることが明らかになりました。

また、Perplexityには好んで参照する「信頼ソース群」が存在する可能性も示唆されています。

GoogleやBingと異なり、Perplexity独自のランキングロジックがあるため、最適化のアプローチも異なります。

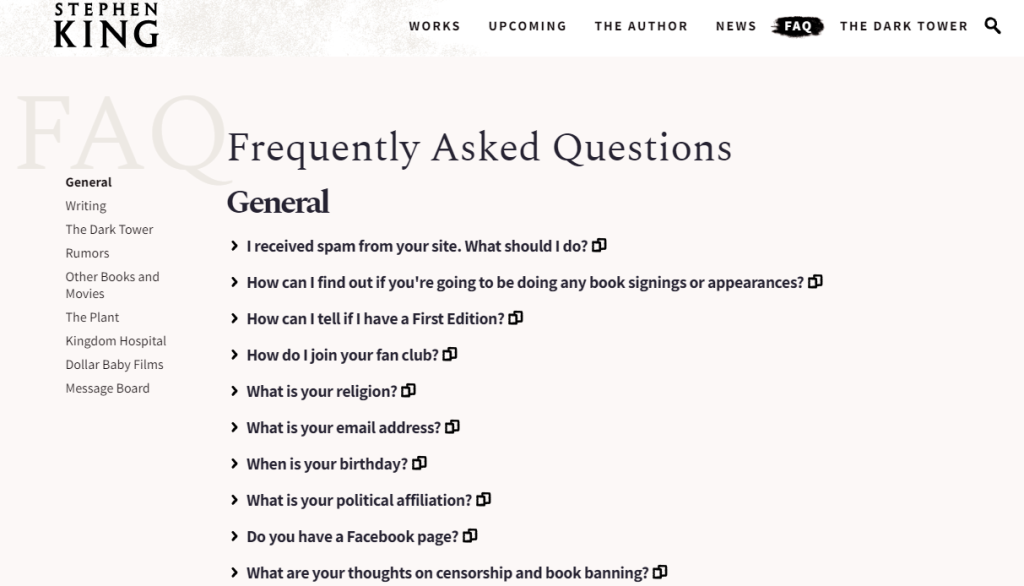

明確な見出し、セクションの整理、FAQの挿入など、構造化されたコンテンツが有利に働くとされています。

ただし、参照元リンクは設置されているものの、そこからのトラフィックは現時点では限定的です。

まとめ:Perplexityは、AI検索の勢いを背景に、主要検索エンジンからユーザーを奪うポテンシャルを持った有力な存在です。一方で、Perplexityも他のAI検索エンジン同様に「Web上の既存情報に依存」しており、AI向けに最適化された高品質なコンテンツを持つことが、引き続きSEOにおける競争優位となります。

AI検索とSEOの未来展望

AIの台頭により、検索エンジンの利用総量が大きく減少するという予測もあります。たとえば、Gartnerは「2026年までに従来の検索の利用は25%減少する」としています。しかしそれでも、「信頼性が高く最適化されたコンテンツを持つWebサイト」の重要性は揺るぎません。

どのAI検索エンジンが覇権を握るかは、まだ見えません。GoogleのAI OverviewsやPerplexityを巡る法的訴訟が進行中であり、今後の司法判断がプラットフォームの運用に大きく影響する可能性があります。

では、今すぐにそのAI検索を最適化すべきでしょうか?

まずは、自社の業界やターゲットに合ったAI検索エンジンの利用状況を調査し、参照トラフィックが見込めるかを検討しましょう。

すでにSEO施策を行っている場合は、PerplexityなどAI検索向けに追加の最適化を行う価値があるか、トラフィックを継続的に観測して判断するのがよいでしょう。

当然ながら、Googleは依然として主要な検索エンジンであり、最適化の優先度は高いままです。

ただし、状況は一様ではありません。GoogleのAI Overviewによりクリック数が増加したと報告するサイトもあれば、大幅なCTR低下を経験しているケースもあります。

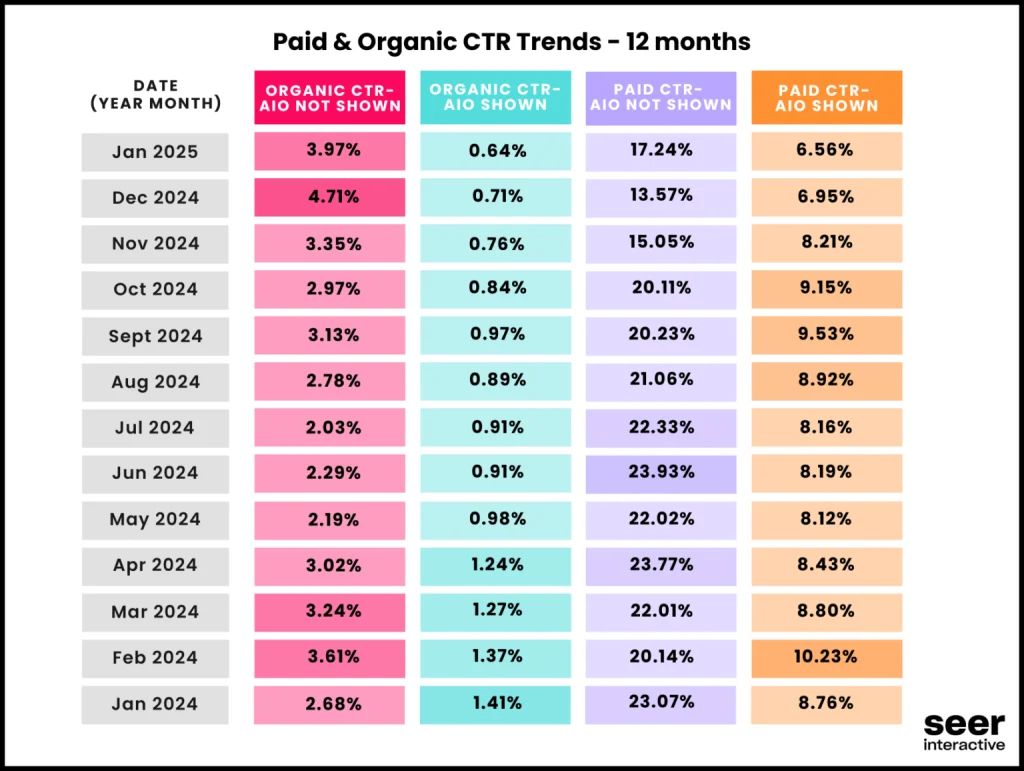

実際、ある調査では「GoogleのAI Overviewが表示されたクエリでのCTRは、前年の1.41%から0.64%に低下」したというデータもあります。

また、ChatGPTやPerplexityのようなAI検索では、従来型検索に比べてニュースサイトやブログへの参照トラフィックが96%も少ないという報告もあります。

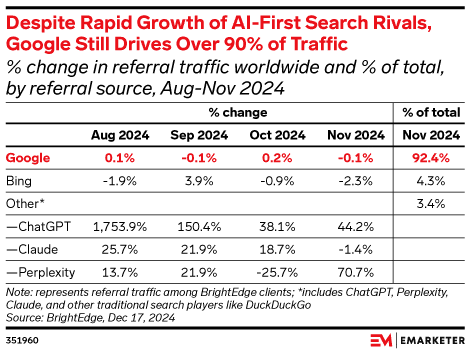

Emarketerのデータも、これを裏付ける結果を示しています。

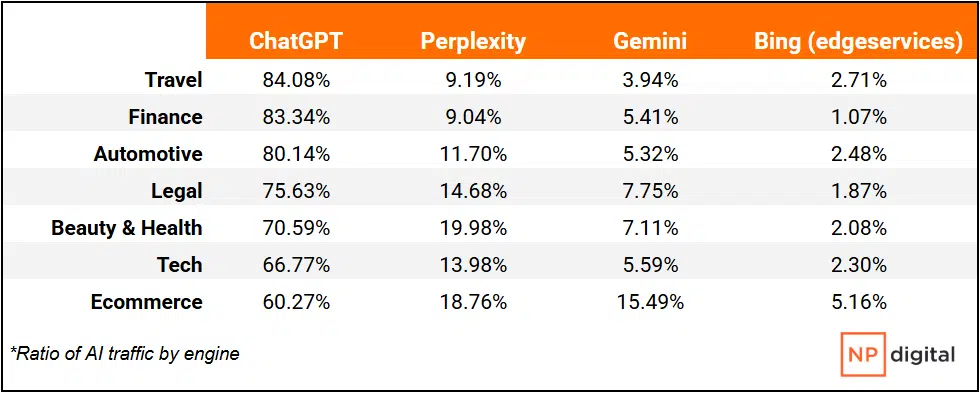

いくつかのデータでは、AI検索エンジンからの参照トラフィックに一定の「序列」が存在することが示唆されています。

たとえば、ChatGPTは総合的な参照トラフィックで他を上回る一方、業界や分野によってはその傾向が異なります。

こうした変化が続く中でも、SEOの基本は変わらないと安心してよいでしょう。

確かにアプローチや手法は変わるかもしれませんが、土台は同じです。ユーザーを第一に考え、ターゲット層が利用するプラットフォームに最適化された優れたウェブサイトを作り、検索での可視性を保つために変化に柔軟に対応し続けることが重要です。

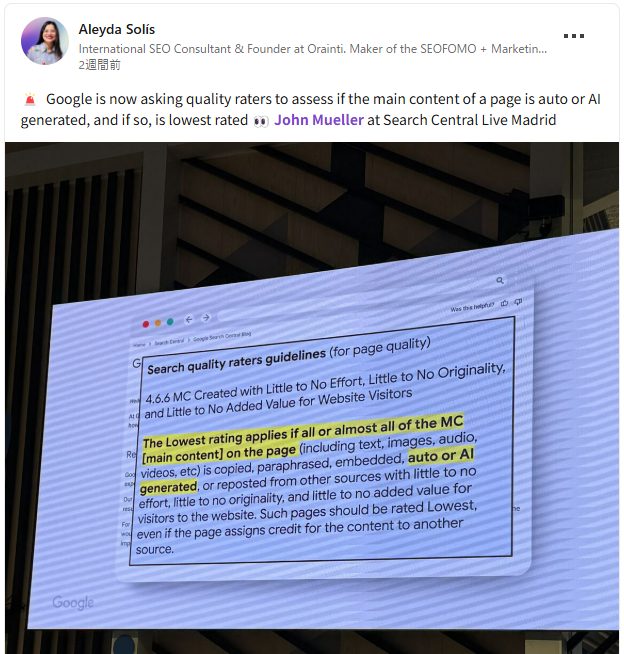

SEO Japan編集部より:Google一極のSEOではAI時代を捉え切れません。鍵は「構造化+良質コンテンツ」。まず Google 評価を固めつつ、Bing や Perplexity でも拾われる情報設計に再構築しましょう。検索変化の背景はこちらの記事で、AI Modeの対応は当社遠藤のブログ記事、低評価コンテンツ基準の解説もぜひご参照ください。

Google AI OverviewやChatGPT検索など生成AIのよくある質問

Google AI Overviewや生成AIの回答は何のデータを基に抽出されていますか?

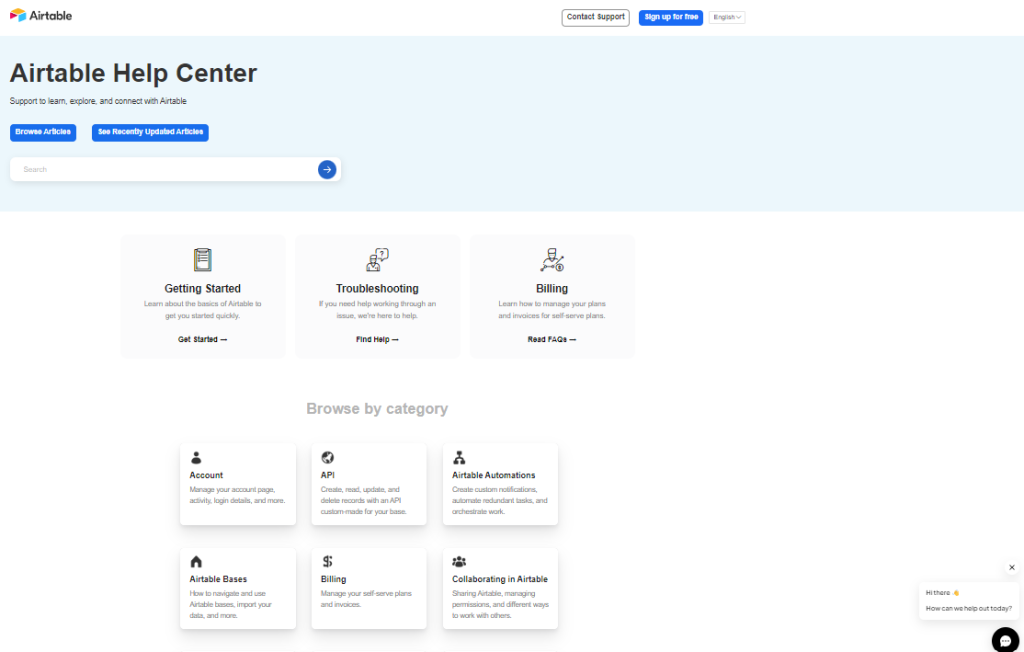

Google AI OverviewやChatGPT検索などの生成AIは、検索インデックスやWeb上の信頼できる情報を基に回答を生成します。特にGoogle AI Overviewは検索上位20位以内のページを中心に、Perplexityは独自クローラーで収集した信頼ソースを優先しているとされています。

AI検索に向け企業が取り組むべきことはなんですか?

まずはGoogleやBingでの上位表示を前提としたSEOを継続しつつ、構造化データやFAQ設置などAIに引用されやすいコンテンツ作成が重要です。Perplexityなど独自ロジックのAIもあるため、信頼性・明確性のある情報設計が求められます。